Zurada, Józef

Dirección: Facultad de Administración Pública y Comercial, Universidad de Louisville, Louisville, KY 40292

País: Estados Unidos

Teléfono: +1 502-852-4681

Fax: +1 502-852-7557

E-mail: jmzura01@ulkyvm.louisville.edu

Puesto(s) anterior(es): Consultor

EDUCACION: Doctorado, 1995, Universidad de Louisville, EE. UU.

Áreas de interés: seguridad de los robots; la interacción persona-ordenador; aplicación de redes neuronales; arquitectura informática y sistemas operativos; factores humanos en la fabricacion

Software y Computadoras: Sistemas Automatizados Híbridos

Un sistema automatizado híbrido (HAS) tiene como objetivo integrar las capacidades de las máquinas artificialmente inteligentes (basadas en tecnología informática) con las capacidades de las personas que interactúan con estas máquinas en el curso de sus actividades laborales. Las principales preocupaciones de la utilización de HAS se relacionan con la forma en que se deben diseñar los subsistemas humano y de máquina para hacer el mejor uso del conocimiento y las habilidades de ambas partes del sistema híbrido, y cómo los operadores humanos y los componentes de la máquina deben interactuar entre sí. para asegurar que sus funciones se complementen entre sí. Muchos sistemas automatizados híbridos han evolucionado como productos de aplicaciones de metodologías modernas basadas en información y control para automatizar e integrar diferentes funciones de sistemas tecnológicos a menudo complejos. HAS se identificó originalmente con la introducción de sistemas basados en computadora utilizados en el diseño y operación de sistemas de control en tiempo real para reactores de energía nuclear, para plantas de procesamiento químico y para tecnología de fabricación de partes discretas. HAS ahora también se puede encontrar en muchas industrias de servicios, como el control del tráfico aéreo y los procedimientos de navegación de aeronaves en el área de la aviación civil, y en el diseño y uso de vehículos inteligentes y sistemas de navegación de carreteras en el transporte por carretera.

Con el progreso continuo en la automatización basada en computadoras, la naturaleza de las tareas humanas en los sistemas tecnológicos modernos cambia de aquellas que requieren habilidades perceptivo-motoras a aquellas que requieren actividades cognitivas, que son necesarias para la resolución de problemas, para la toma de decisiones en el monitoreo del sistema y para tareas de control de supervisión. Por ejemplo, los operadores humanos en los sistemas de fabricación integrados por computadora actúan principalmente como monitores del sistema, solucionadores de problemas y tomadores de decisiones. Las actividades cognitivas del supervisor humano en cualquier entorno HAS son (1) planificar lo que debe hacerse durante un período de tiempo determinado, (2) diseñar procedimientos (o pasos) para lograr el conjunto de objetivos planificados, (3) monitorear el progreso de procesos (tecnológicos), (4) “enseñar” al sistema a través de una computadora interactiva humana, (5) intervenir si el sistema se comporta de manera anormal o si las prioridades de control cambian y (6) aprender a través de la retroalimentación del sistema sobre el impacto de acciones de supervisión (Sheridan 1987).

Diseño de sistema híbrido

Las interacciones hombre-máquina en un HAS implican la utilización de bucles de comunicación dinámicos entre los operadores humanos y las máquinas inteligentes, un proceso que incluye la detección y el procesamiento de información y el inicio y ejecución de tareas de control y toma de decisiones, dentro de una estructura dada de asignación de funciones entre humanos y máquinas. Como mínimo, las interacciones entre las personas y la automatización deben reflejar la alta complejidad de los sistemas automatizados híbridos, así como las características relevantes de los operadores humanos y los requisitos de las tareas. Por lo tanto, el sistema automatizado híbrido se puede definir formalmente como un quíntuple en la siguiente fórmula:

TIENE = (T, U, C, E, I)

donde T = requisitos de la tarea (físicos y cognitivos); U = características del usuario (físicas y cognitivas); C = las características de automatización (hardware y software, incluidas las interfaces informáticas); E = el entorno del sistema; I = un conjunto de interacciones entre los elementos anteriores.

El conjunto de interacciones I incorpora todas las posibles interacciones entre T, U y C in E independientemente de su naturaleza o fuerza de asociación. Por ejemplo, una de las posibles interacciones podría involucrar la relación de los datos almacenados en la memoria de la computadora con el conocimiento correspondiente, si lo hay, del operador humano. las interacciones I puede ser elemental (es decir, limitado a una asociación uno a uno) o complejo, como implicaría interacciones entre el operador humano, el software particular utilizado para lograr la tarea deseada y la interfaz física disponible con la computadora.

Los diseñadores de muchos sistemas automatizados híbridos se enfocan principalmente en la integración asistida por computadora de máquinas sofisticadas y otros equipos como parte de la tecnología basada en computadora, y rara vez prestan mucha atención a la necesidad primordial de una integración humana efectiva dentro de tales sistemas. Por lo tanto, en la actualidad, muchos de los sistemas (tecnológicos) integrados por computadora no son totalmente compatibles con las capacidades inherentes de los operadores humanos expresadas por las habilidades y el conocimiento necesarios para el control y monitoreo efectivo de estos sistemas. Tal incompatibilidad surge en todos los niveles de funcionamiento humano, máquina y hombre-máquina, y puede definirse dentro de un marco de referencia del individuo y de toda la organización o instalación. Por ejemplo, los problemas de integración de personas y tecnología en empresas de fabricación avanzada ocurren al principio de la etapa de diseño de HAS. Estos problemas se pueden conceptualizar utilizando el siguiente modelo de integración de sistemas de la complejidad de las interacciones, I, entre los diseñadores del sistema, D, operadores humanos, H, o usuarios potenciales del sistema y la tecnología, T:

yo (H, T) = F [ Yo (H, D), Yo (D, T)]

donde I significa interacciones relevantes que tienen lugar en la estructura de un HAS dado, mientras que F indica relaciones funcionales entre diseñadores, operadores humanos y tecnología.

El modelo de integración del sistema anterior destaca el hecho de que las interacciones entre los usuarios y la tecnología están determinadas por el resultado de la integración de las dos interacciones anteriores, a saber, (1) aquellas entre los diseñadores de HAS y los usuarios potenciales y (2) aquellas entre los diseñadores. y la tecnología HAS (a nivel de máquinas y su integración). Cabe señalar que, aunque normalmente existen fuertes interacciones entre los diseñadores y la tecnología, solo se pueden encontrar muy pocos ejemplos de interrelaciones igualmente fuertes entre los diseñadores y los operadores humanos.

Se puede argumentar que incluso en los sistemas más automatizados, el papel humano sigue siendo crítico para el desempeño exitoso del sistema a nivel operativo. Bainbridge (1983) identificó un conjunto de problemas relevantes para la operación del HAS que se deben a la naturaleza de la automatización en sí, como sigue:

- Operadores “fuera del lazo de control”. Los operadores humanos están presentes en el sistema para ejercer el control cuando es necesario, pero al estar "fuera del circuito de control" no pueden mantener las habilidades manuales y el conocimiento del sistema a largo plazo que a menudo se requieren en caso de una emergencia.

- "Imagen mental" obsoleta. Es posible que los operadores humanos no puedan responder rápidamente a los cambios en el comportamiento del sistema si no han estado siguiendo muy de cerca los eventos de su operación. Además, el conocimiento de los operadores o la imagen mental del funcionamiento del sistema pueden ser inadecuados para iniciar o ejercer las respuestas requeridas.

- Desaparición de generaciones de habilidades. Es posible que los nuevos operadores no puedan adquirir el conocimiento suficiente sobre el sistema computarizado logrado a través de la experiencia y, por lo tanto, no podrán ejercer un control efectivo cuando sea necesario.

- Autoridad de automáticos. Si el sistema computarizado se ha implementado porque puede realizar las tareas requeridas mejor que el operador humano, surge la pregunta: "¿Sobre qué base debe decidir el operador que los sistemas automatizados están tomando decisiones correctas o incorrectas?"

- Aparición de los nuevos tipos de “errores humanos” debidos a la automatización. Los sistemas automatizados dan lugar a nuevos tipos de errores y, en consecuencia, accidentes que no pueden ser analizados en el marco de las técnicas tradicionales de análisis.

Asignación de tareas

Uno de los temas importantes para el diseño de HAS es determinar cuántas y qué funciones o responsabilidades deben asignarse a los operadores humanos, y cuáles y cuántas a las computadoras. En general, hay tres clases básicas de problemas de asignación de tareas que deben considerarse: (1) la asignación de tareas de supervisor humano-computadora, (2) la asignación de tareas humano-humano y (3) la asignación de tareas de supervisión computadora-computadora. Idealmente, las decisiones de asignación deben tomarse a través de algún procedimiento de asignación estructurado antes de comenzar el diseño del sistema básico. Desafortunadamente, un proceso sistemático de este tipo rara vez es posible, ya que las funciones que se asignarán pueden necesitar un examen más detallado o deben llevarse a cabo de forma interactiva entre los componentes del sistema humano y de la máquina, es decir, mediante la aplicación del paradigma de control de supervisión. La asignación de tareas en los sistemas automatizados híbridos debe centrarse en el alcance de las responsabilidades de supervisión humana y de la computadora, y debe considerar la naturaleza de las interacciones entre el operador humano y los sistemas de soporte de decisiones computarizados. También se deben considerar los medios de transferencia de información entre las máquinas y las interfaces de entrada y salida humanas y la compatibilidad del software con las capacidades cognitivas humanas de resolución de problemas.

En los enfoques tradicionales para el diseño y la gestión de sistemas automatizados híbridos, se consideraba a los trabajadores como sistemas de entrada-salida deterministas, y había una tendencia a ignorar la naturaleza teleológica del comportamiento humano, es decir, el comportamiento orientado a objetivos que se basa en la adquisición de información relevante y la selección de metas (Goodstein et al. 1988). Para tener éxito, el diseño y la gestión de sistemas automatizados híbridos avanzados deben basarse en una descripción de las funciones mentales humanas necesarias para una tarea específica. El enfoque de “ingeniería cognitiva” (descrito más adelante) propone que los sistemas hombre-máquina (híbridos) deben concebirse, diseñarse, analizarse y evaluarse en términos de procesos mentales humanos (es decir, el modelo mental del operador de los sistemas adaptativos se toma en consideración). cuenta). Los siguientes son los requisitos del enfoque centrado en el ser humano para el diseño y la operación de HAS formulados por Corbett (1988):

- Compatibilidad. La operación del sistema no debería requerir habilidades no relacionadas con las habilidades existentes, pero debería permitir que las habilidades existentes evolucionen. El operador humano debe introducir y recibir información que sea compatible con la práctica convencional para que la interfaz se ajuste a los conocimientos y habilidades previos del usuario.

- Transparencia. No se puede controlar un sistema sin comprenderlo. Por lo tanto, el operador humano debe poder “ver” los procesos internos del software de control del sistema si se quiere facilitar el aprendizaje. Un sistema transparente facilita a los usuarios la construcción de un modelo interno de las funciones de control y toma de decisiones que el sistema puede realizar.

- Choque mínimo. El sistema no debe hacer nada que los operadores encuentren inesperado a la luz de la información disponible para ellos, que detalla el estado actual del sistema.

- control de perturbaciones. Las tareas inciertas (tal como se definen en el análisis de la estructura de elección) deben estar bajo el control de un operador humano con soporte informático para la toma de decisiones.

- Falibilidad. Las habilidades y conocimientos implícitos de los operadores humanos no deben diseñarse fuera del sistema. Los operadores nunca deben ponerse en una posición en la que vean impotentes cómo el software dirige una operación incorrecta.

- Reversibilidad de errores. El software debe proporcionar suficiente retroalimentación de información para informar al operador humano de las posibles consecuencias de una operación o estrategia en particular.

- Flexibilidad operativa. El sistema debe ofrecer a los operadores humanos la libertad de compensar los requisitos y los límites de recursos cambiando las estrategias operativas sin perder el soporte del software de control.

Ingeniería Cognitiva de Factores Humanos

La ingeniería cognitiva de factores humanos se centra en cómo los operadores humanos toman decisiones en el lugar de trabajo, resuelven problemas, formulan planes y aprenden nuevas habilidades (Hollnagel y Woods 1983). Los roles de los operadores humanos que funcionan en cualquier HAS se pueden clasificar utilizando el esquema de Rasmussen (1983) en tres categorías principales:

- Comportamiento basado en habilidades es el desempeño sensorio-motor ejecutado durante actos o actividades que tienen lugar sin control consciente como patrones de comportamiento fluidos, automatizados y altamente integrados. Las actividades humanas que entran en esta categoría se consideran una secuencia de actos hábiles compuestos para una situación dada. El comportamiento basado en habilidades es, por lo tanto, la expresión de patrones de comportamiento más o menos almacenados o instrucciones preprogramadas en un dominio de espacio-tiempo.

- Comportamiento basado en reglas es una categoría de rendimiento orientada a un objetivo estructurada por el control de avance a través de una regla o procedimiento almacenado, es decir, un rendimiento ordenado que permite componer una secuencia de subrutinas en una situación de trabajo familiar. La regla generalmente se selecciona de experiencias previas y refleja las propiedades funcionales que restringen el comportamiento del entorno. El rendimiento basado en reglas se basa en conocimientos técnicos explícitos en lo que respecta al empleo de las reglas pertinentes. El conjunto de datos de decisión consta de referencias para el reconocimiento e identificación de estados, eventos o situaciones.

- Comportamiento basado en el conocimiento es una categoría de actuación controlada por objetivos, en la que el objetivo se formula explícitamente sobre la base del conocimiento del entorno y los objetivos de la persona. La estructura interna del sistema está representada por un “modelo mental”. Este tipo de comportamiento permite el desarrollo y la prueba de diferentes planes bajo condiciones de control desconocidas y, por lo tanto, inciertas, y es necesario cuando las habilidades o las reglas no están disponibles o son inadecuadas, por lo que se debe recurrir a la resolución de problemas y la planificación.

En el diseño y gestión de un HAS se deben considerar las características cognitivas de los trabajadores para asegurar la compatibilidad de la operación del sistema con el modelo interno del trabajador que describe sus funciones. En consecuencia, el nivel de descripción del sistema debe cambiarse de los aspectos del funcionamiento humano basados en habilidades a los basados en reglas y conocimientos, y se deben usar métodos apropiados de análisis de tareas cognitivas para identificar el modelo de sistema del operador. Un tema relacionado en el desarrollo de un HAS es el diseño de medios de transmisión de información entre el operador humano y los componentes del sistema automatizado, tanto a nivel físico como cognitivo. Dicha transferencia de información debe ser compatible con los modos de información utilizados en los diferentes niveles de operación del sistema, es decir, visual, verbal, táctil o híbrida. Esta compatibilidad informativa asegura que las diferentes formas de transferencia de información requerirán una incompatibilidad mínima entre el medio y la naturaleza de la información. Por ejemplo, una pantalla visual es mejor para la transmisión de información espacial, mientras que la entrada auditiva puede usarse para transmitir información textual.

Muy a menudo, el operador humano desarrolla un modelo interno que describe el funcionamiento y la función del sistema de acuerdo con su experiencia, formación e instrucciones en relación con el tipo de interfaz hombre-máquina dado. A la luz de esta realidad, los diseñadores de un HAS deberían intentar construir en las máquinas (u otros sistemas artificiales) un modelo de las características físicas y cognitivas del operador humano, es decir, la imagen del sistema del operador (Hollnagel y Woods 1983) . Los diseñadores de un HAS también deben tener en cuenta el nivel de abstracción en la descripción del sistema, así como varias categorías relevantes del comportamiento del operador humano. Estos niveles de abstracción para modelar el funcionamiento humano en el entorno laboral son los siguientes (Rasmussen 1983): (1) forma física (estructura anatómica), (2) funciones físicas (funciones fisiológicas), (3) funciones generalizadas (mecanismos psicológicos y cognitivos). y procesos afectivos), (4) funciones abstractas (procesamiento de información) y (5) propósito funcional (estructuras de valores, mitos, religiones, interacciones humanas). Estos cinco niveles deben ser considerados simultáneamente por los diseñadores para asegurar un desempeño HAS efectivo.

Diseño de software del sistema

Dado que el software de computadora es un componente principal de cualquier entorno HAS, el desarrollo de software, incluido el diseño, las pruebas, la operación y la modificación, y los problemas de confiabilidad del software también deben considerarse en las primeras etapas del desarrollo de HAS. De esta manera, uno debería poder reducir el costo de la detección y eliminación de errores de software. Sin embargo, es difícil estimar la confiabilidad de los componentes humanos de un HAS debido a las limitaciones en nuestra capacidad para modelar el desempeño de tareas humanas, la carga de trabajo relacionada y los posibles errores. Una carga de trabajo mental excesiva o insuficiente puede conducir a una sobrecarga de información y al aburrimiento, respectivamente, y puede resultar en un desempeño humano degradado, lo que lleva a errores y aumenta la probabilidad de accidentes. Los diseñadores de un HAS deberían emplear interfaces adaptables, que utilizan técnicas de inteligencia artificial, para resolver estos problemas. Además de la compatibilidad hombre-máquina, debe tenerse en cuenta la cuestión de la adaptabilidad hombre-máquina entre sí para reducir los niveles de estrés que se producen cuando se pueden superar las capacidades humanas.

Debido al alto nivel de complejidad de muchos sistemas automatizados híbridos, la identificación de cualquier peligro potencial relacionado con el hardware, el software, los procedimientos operativos y las interacciones hombre-máquina de estos sistemas se vuelve fundamental para el éxito de los esfuerzos destinados a reducir las lesiones y los daños a los equipos. . Los peligros para la salud y la seguridad asociados con los sistemas automatizados híbridos complejos, como la tecnología de fabricación integrada por computadora (CIM), es claramente uno de los aspectos más críticos del diseño y la operación del sistema.

Problemas de seguridad del sistema

Los entornos automatizados híbridos, con su importante potencial de comportamiento errático del software de control en condiciones de perturbación del sistema, crean una nueva generación de riesgos de accidentes. A medida que los sistemas automatizados híbridos se vuelven más versátiles y complejos, las perturbaciones del sistema, incluidos los problemas de arranque y apagado y las desviaciones en el control del sistema, pueden aumentar significativamente la posibilidad de un peligro grave para los operadores humanos. Irónicamente, en muchas situaciones anormales, los operadores generalmente confían en el correcto funcionamiento de los subsistemas de seguridad automatizados, una práctica que puede aumentar el riesgo de lesiones graves. Por ejemplo, un estudio de accidentes relacionados con el mal funcionamiento de los sistemas de control técnico mostró que alrededor de un tercio de las secuencias de accidentes incluyeron la intervención humana en el circuito de control del sistema perturbado.

Dado que las medidas de seguridad tradicionales no se pueden adaptar fácilmente a las necesidades de los entornos HAS, las estrategias de control de lesiones y prevención de accidentes deben reconsiderarse en vista de las características inherentes de estos sistemas. Por ejemplo, en el área de la tecnología de fabricación avanzada, muchos procesos se caracterizan por la existencia de cantidades sustanciales de flujos de energía que los operadores humanos no pueden anticipar fácilmente. Además, los problemas de seguridad suelen surgir en las interfaces entre subsistemas, o cuando las perturbaciones del sistema progresan de un subsistema a otro. De acuerdo con la Organización Internacional para la Estandarización (ISO 1991), los riesgos asociados con los peligros debidos a la automatización industrial varían según los tipos de máquinas industriales incorporadas en el sistema de fabricación específico y con las formas en que el sistema se instala, programa, opera y mantiene. y reparado. Por ejemplo, una comparación de accidentes relacionados con robots en Suecia con otros tipos de accidentes mostró que los robots pueden ser las máquinas industriales más peligrosas utilizadas en la industria manufacturera avanzada. La tasa de accidentes estimada para los robots industriales fue de un accidente grave por 45 años-robot, una tasa más alta que la de las prensas industriales, que se informó que era de un accidente por 50 años-máquina. Cabe señalar aquí que las prensas industriales en los Estados Unidos representaron alrededor del 23 % de todas las muertes relacionadas con máquinas metalúrgicas durante el período 1980-1985, y las prensas eléctricas ocuparon el primer lugar con respecto al producto gravedad-frecuencia para lesiones no fatales.

En el dominio de la tecnología de fabricación avanzada, existen muchas piezas móviles que son peligrosas para los trabajadores, ya que cambian de posición de manera compleja fuera del campo visual de los operadores humanos. Los rápidos desarrollos tecnológicos en la fabricación integrada por computadora crearon una necesidad crítica de estudiar los efectos de la tecnología de fabricación avanzada en los trabajadores. Para identificar los peligros causados por varios componentes de dicho entorno HAS, los accidentes pasados deben analizarse cuidadosamente. Desafortunadamente, los accidentes que involucran el uso de robots son difíciles de aislar de los informes de accidentes relacionados con máquinas operadas por humanos y, por lo tanto, puede haber un alto porcentaje de accidentes no registrados. Las normas de salud y seguridad en el trabajo de Japón establecen que “los robots industriales no cuentan en la actualidad con medios fiables de seguridad y los trabajadores no pueden estar protegidos de ellos a menos que se regule su uso”. Por ejemplo, los resultados de la encuesta realizada por el Ministerio de Trabajo de Japón (Sugimoto 1987) de accidentes relacionados con robots industriales en las 190 fábricas encuestadas (con 4,341 robots en funcionamiento) mostraron que hubo 300 perturbaciones relacionadas con robots, de los cuales 37 casos de los actos inseguros resultaron en algunos casi accidentes, 9 fueron accidentes que produjeron lesiones y 2 fueron accidentes fatales. Los resultados de otros estudios indican que la automatización basada en computadora no necesariamente aumenta el nivel general de seguridad, ya que el hardware del sistema no puede hacerse a prueba de fallas mediante funciones de seguridad en el software de la computadora solamente, y los controladores del sistema no siempre son altamente confiables. Además, en un HAS complejo, uno no puede depender exclusivamente de dispositivos de detección de seguridad para detectar condiciones peligrosas y emprender estrategias apropiadas para evitar peligros.

Efectos de la automatización en la salud humana

Como se discutió anteriormente, las actividades de los trabajadores en muchos entornos HAS son básicamente aquellas de control de supervisión, monitoreo, soporte del sistema y mantenimiento. Estas actividades también se pueden clasificar en cuatro grupos básicos de la siguiente manera: (1) tareas de programación, es decir, codificar la información que guía y dirige la operación de la maquinaria, (2) monitoreo de los componentes de producción y control de HAS, (3) mantenimiento de los componentes de HAS para prevenir o aliviar el mal funcionamiento de la maquinaria, y (4) realizar una variedad de tareas de apoyo, etc. Muchas revisiones recientes del impacto del HAS en el bienestar de los trabajadores concluyeron que aunque la utilización de un HAS en el área de fabricación puede eliminar tareas pesadas y peligrosas , trabajar en un entorno HAS puede ser insatisfactorio y estresante para los trabajadores. Las fuentes de estrés incluyeron el monitoreo constante requerido en muchas aplicaciones HAS, el alcance limitado de las actividades asignadas, el bajo nivel de interacción de los trabajadores permitido por el diseño del sistema y los riesgos de seguridad asociados con la naturaleza impredecible e incontrolable del equipo. Si bien algunos trabajadores que participan en actividades de programación y mantenimiento sienten los elementos del desafío, que pueden tener efectos positivos en su bienestar, estos efectos a menudo se ven contrarrestados por la naturaleza compleja y exigente de estas actividades, así como por la presión. ejercida por la administración para completar estas actividades rápidamente.

Si bien en algunos entornos HAS los operadores humanos están alejados de las fuentes de energía tradicionales (el flujo de trabajo y el movimiento de la máquina) durante las condiciones normales de operación, muchas tareas en los sistemas automatizados aún deben realizarse en contacto directo con otras fuentes de energía. Dado que el número de diferentes componentes HAS aumenta continuamente, se debe hacer especial hincapié en la comodidad y la seguridad de los trabajadores y en el desarrollo de disposiciones eficaces para el control de lesiones, especialmente en vista del hecho de que los trabajadores ya no pueden mantenerse al día con la sofisticación y complejidad de tales sistemas.

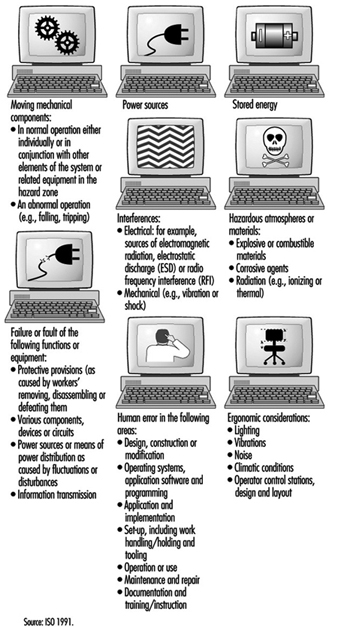

Con el fin de satisfacer las necesidades actuales de control de lesiones y seguridad de los trabajadores en los sistemas de fabricación integrados por computadora, el Comité de Sistemas de Automatización Industrial de ISO ha propuesto una nueva norma de seguridad titulada "Seguridad de los sistemas de fabricación integrados" (1991). Esta nueva norma internacional, que se desarrolló en reconocimiento de los peligros particulares que existen en los sistemas de fabricación integrados que incorporan máquinas industriales y equipos asociados, tiene como objetivo minimizar las posibilidades de lesiones al personal mientras trabaja en un sistema de fabricación integrado o junto a él. Las principales fuentes de peligros potenciales para los operadores humanos en CIM identificados por esta norma se muestran en la figura 1.

Figura 1. Fuente principal de peligros en la fabricación integrada por computadora (CIM) (después de ISO 1991)

Errores humanos y del sistema

En general, los peligros en un HAS pueden surgir del propio sistema, de su asociación con otros equipos presentes en el entorno físico o de las interacciones del personal humano con el sistema. Un accidente es solo uno de los varios resultados de las interacciones hombre-máquina que pueden surgir en condiciones peligrosas; los accidentes cercanos y los incidentes con daños son mucho más comunes (Zimolong y Duda 1992). La ocurrencia de un error puede llevar a una de estas consecuencias: (1) el error pasa desapercibido, (2) el sistema puede compensar el error, (3) el error conduce a una falla de la máquina y/o al paro del sistema o (4) ) el error conduce a un accidente.

Dado que no todos los errores humanos que resultan en un incidente crítico causarán un accidente real, es apropiado distinguir aún más entre las categorías de resultados de la siguiente manera: (1) un incidente inseguro (es decir, cualquier ocurrencia no intencional independientemente de si resulta en lesiones, daños o pérdida), (2) un accidente (es decir, un evento inseguro que resulta en una lesión, daño o pérdida), (3) un incidente de daño (es decir, un evento inseguro que resulta solo en algún tipo de daño material), (4) un casi accidente o “casi accidente” (es decir, un evento inseguro en el que una lesión, daño o pérdida se evitó fortuitamente por un margen estrecho) y (5) la existencia de un accidente potencial (es decir, eventos inseguros que podrían haber resultado en lesiones, daños o pérdidas). , o pérdida, pero, debido a las circunstancias, no resultó ni siquiera en un casi accidente).

Se pueden distinguir tres tipos básicos de error humano en un HAS:

- resbalones y lapsus basados en habilidades

- errores basados en reglas

- errores basados en el conocimiento.

Esta taxonomía, ideada por Reason (1990), se basa en una modificación de la clasificación del desempeño humano de habilidad-regla-conocimiento de Rasmussen, como se describe anteriormente. En el nivel basado en habilidades, el desempeño humano se rige por patrones almacenados de instrucciones preprogramadas representadas como estructuras análogas en un dominio de espacio-tiempo. El nivel basado en reglas es aplicable para abordar problemas familiares en los que las soluciones se rigen por reglas almacenadas (llamadas "producciones", ya que se accede a ellas o se producen según sea necesario). Estas reglas exigen la realización de determinados diagnósticos (o juicios) o la realización de determinadas acciones correctoras, dado que se han dado determinadas condiciones que exigen una respuesta adecuada. En este nivel, los errores humanos se asocian típicamente con la clasificación errónea de situaciones, lo que lleva a la aplicación de una regla incorrecta o al recuerdo incorrecto de juicios o procedimientos consecuentes. Los errores basados en el conocimiento ocurren en situaciones novedosas para las cuales se deben planificar acciones “on-line” (en un momento dado), utilizando procesos analíticos conscientes y conocimiento almacenado. Los errores en este nivel surgen de limitaciones de recursos y conocimientos incompletos o incorrectos.

Los sistemas genéricos de modelado de errores (GEMS) propuestos por Reason (1990), que intenta localizar los orígenes de los tipos básicos de errores humanos, se pueden utilizar para derivar la taxonomía general del comportamiento humano en un HAS. GEMS busca integrar dos áreas distintas de investigación de errores: (1) deslices y fallas, en los que las acciones se desvían de la intención actual debido a fallas en la ejecución y/o fallas en el almacenamiento y (2) errores, en los cuales las acciones pueden ejecutarse de acuerdo con el plan. pero el plan es inadecuado para lograr el resultado deseado.

Evaluación y Prevención de Riesgos en CIM

De acuerdo con la ISO (1991), la evaluación de riesgos en CIM debe realizarse para minimizar todos los riesgos y servir como base para determinar los objetivos y medidas de seguridad en el desarrollo de programas o planes tanto para crear un entorno de trabajo seguro como para garantizar la seguridad y la salud del personal también. Por ejemplo, los riesgos laborales en entornos HAS basados en la fabricación se pueden caracterizar de la siguiente manera: (1) el operador humano puede necesitar ingresar a la zona de peligro durante las tareas de recuperación, servicio y mantenimiento de perturbaciones, (2) la zona de peligro es difícil de determinar, percibir y controlar, (3) el trabajo puede ser monótono y (4) los accidentes que ocurren dentro de los sistemas de fabricación integrados por computadora son a menudo graves. Cada peligro identificado debe evaluarse por su riesgo, y deben determinarse e implementarse las medidas de seguridad apropiadas para minimizar ese riesgo. Los peligros también deben determinarse con respecto a todos los siguientes aspectos de cualquier proceso dado: la unidad individual en sí; la interacción entre unidades individuales; las secciones operativas del sistema; y el funcionamiento del sistema completo para todos los modos y condiciones de funcionamiento previstos, incluidas las condiciones en las que se suspenden los medios de protección normales para operaciones tales como programación, verificación, resolución de problemas, mantenimiento o reparación.

La fase de diseño de la estrategia de seguridad ISO (1991) para CIM incluye:

- especificación de los límites de los parámetros del sistema

- aplicación de una estrategia de seguridad

- identificación de peligros

- evaluación de los riesgos asociados

- eliminación de los peligros o disminución de los riesgos tanto como sea posible.

La especificación de seguridad del sistema debe incluir:

- una descripción de las funciones del sistema

- un diseño y/o modelo del sistema

- los resultados de una encuesta realizada para investigar la interacción de diferentes procesos de trabajo y actividades manuales

- un análisis de secuencias de procesos, incluida la interacción manual

- una descripción de las interfaces con el transportador o las líneas de transporte

- diagramas de flujo de proceso

- planes de fundación

- planos de dispositivos de suministro y eliminación

- determinación del espacio necesario para el suministro y disposición de material

- registros de accidentes disponibles.

De acuerdo con la ISO (1991), todos los requisitos necesarios para garantizar una operación segura del sistema CIM deben tenerse en cuenta en el diseño de procedimientos sistemáticos de planificación de la seguridad. Esto incluye todas las medidas de protección para reducir eficazmente los peligros y requiere:

- integración de la interfaz hombre-máquina

- definición temprana de la posición de quienes trabajan en el sistema (en el tiempo y el espacio)

- consideración temprana de formas de reducir el trabajo aislado

- consideración de los aspectos ambientales.

El procedimiento de planificación de seguridad debe abordar, entre otros, los siguientes aspectos de seguridad de CIM:

- Selección de los modos de funcionamiento del sistema. El equipo de control debe tener provisiones para al menos los siguientes modos de operación: (1) modo normal o de producción (es decir, con todas las protecciones normales conectadas y en funcionamiento), (2) operación con algunas de las protecciones normales suspendidas y (3) operación en qué sistema o iniciación manual remota de situaciones peligrosas se previene (por ejemplo, en el caso de operación local o de aislamiento de energía o bloqueo mecánico de condiciones peligrosas).

- Formación, instalación, puesta en marcha y pruebas funcionales. Cuando se requiere que el personal esté en la zona de peligro, se deben proporcionar las siguientes medidas de seguridad en el sistema de control: (1) mantener para ejecutar, (2) dispositivo habilitador, (3) velocidad reducida, (4) potencia reducida y (5) ) parada de emergencia móvil.

- Seguridad en la programación, mantenimiento y reparación de sistemas. Durante la programación, solo el programador debe estar permitido en el espacio protegido. El sistema debe contar con procedimientos de inspección y mantenimiento para garantizar la operación prevista continua del sistema. El programa de inspección y mantenimiento debe tener en cuenta las recomendaciones del proveedor del sistema y las de los proveedores de varios elementos de los sistemas. No hace falta mencionar que el personal que realiza el mantenimiento o las reparaciones del sistema debe estar capacitado en los procedimientos necesarios para realizar las tareas requeridas.

- Eliminación de fallas. Cuando sea necesario eliminar la falla desde el interior del espacio protegido, debe realizarse después de una desconexión segura (o, si es posible, después de que se haya accionado un mecanismo de bloqueo). Deben tomarse medidas adicionales contra el inicio erróneo de situaciones peligrosas. Cuando puedan ocurrir peligros durante la eliminación de fallas en secciones del sistema o en las máquinas de sistemas o máquinas contiguas, estos también deben ponerse fuera de servicio y protegerse contra arranques inesperados. Por medio de señales de instrucción y advertencia, se debe llamar la atención sobre la eliminación de fallas en los componentes del sistema que no se pueden observar por completo.

Control de perturbaciones del sistema

En muchas instalaciones HAS utilizadas en el área de fabricación integrada por computadora, normalmente se necesitan operadores humanos con el fin de controlar, programar, mantener, preconfigurar, reparar o solucionar problemas. Las perturbaciones en el sistema conducen a situaciones que hacen necesario que los trabajadores ingresen a las áreas peligrosas. A este respecto, se puede suponer que las perturbaciones siguen siendo la razón más importante de la interferencia humana en CIM, porque los sistemas se programarán con mayor frecuencia desde fuera de las áreas restringidas. Uno de los temas más importantes para la seguridad de CIM es prevenir perturbaciones, ya que la mayoría de los riesgos ocurren en la fase de solución de problemas del sistema. La prevención de perturbaciones es el objetivo común en lo que se refiere tanto a la seguridad como a la rentabilidad.

Una perturbación en un sistema CIM es un estado o función de un sistema que se desvía del estado planificado o deseado. Además de la productividad, las perturbaciones durante la operación de un CIM tienen un efecto directo en la seguridad de las personas involucradas en la operación del sistema. Un estudio finlandés (Kuivanen 1990) mostró que aproximadamente la mitad de las perturbaciones en la fabricación automatizada reducen la seguridad de los trabajadores. Las principales causas de las perturbaciones fueron errores en el diseño del sistema (34 %), fallas en los componentes del sistema (31 %), errores humanos (20 %) y factores externos (15 %). La mayoría de las fallas de las máquinas fueron causadas por el sistema de control y, en el sistema de control, la mayoría de las fallas ocurrieron en los sensores. Una forma eficaz de aumentar el nivel de seguridad de las instalaciones CIM es reducir el número de perturbaciones. Si bien las acciones humanas en sistemas perturbados previenen la ocurrencia de accidentes en el ambiente HAS, también contribuyen a ellos. Por ejemplo, un estudio de accidentes relacionados con el mal funcionamiento de los sistemas de control técnico mostró que alrededor de un tercio de las secuencias de accidentes incluyeron la intervención humana en el circuito de control del sistema perturbado.

Los principales temas de investigación en la prevención de perturbaciones CIM se refieren a (1) las principales causas de las perturbaciones, (2) los componentes y funciones no confiables, (3) el impacto de las perturbaciones en la seguridad, (4) el impacto de las perturbaciones en la función del sistema, ( 5) daños materiales y (6) reparaciones. La seguridad de HAS debe planificarse al principio de la etapa de diseño del sistema, con la debida consideración de la tecnología, las personas y la organización, y ser una parte integral del proceso general de planificación técnica de HAS.

HAS Diseño: Desafíos Futuros

Para asegurar el máximo beneficio de los sistemas automatizados híbridos, como se mencionó anteriormente, se necesita una visión mucho más amplia del desarrollo de sistemas, que se base en la integración de personas, organizaciones y tecnología. Aquí se deben aplicar tres tipos principales de integración de sistemas:

- integracion de personas, asegurando una comunicación efectiva entre ellos

- integración humano-computadora, mediante el diseño de interfaces adecuadas y la interacción entre las personas y las computadoras

- integración tecnológica, asegurando interfaces e interacciones efectivas entre máquinas.

Los requisitos mínimos de diseño para los sistemas automatizados híbridos deben incluir lo siguiente: (1) flexibilidad, (2) adaptación dinámica, (3) capacidad de respuesta mejorada y (4) la necesidad de motivar a las personas y hacer un mejor uso de sus habilidades, juicio y experiencia. . Lo anterior también requiere que se desarrollen estructuras organizacionales, prácticas de trabajo y tecnologías de HAS para permitir que las personas en todos los niveles del sistema adapten sus estrategias de trabajo a la variedad de situaciones de control de sistemas. Por lo tanto, las organizaciones, prácticas de trabajo y tecnologías de HAS deberán diseñarse y desarrollarse como sistemas abiertos (Kidd 1994).

Un sistema automatizado híbrido abierto (OHAS) es un sistema que recibe entradas y envía salidas a su entorno. La idea de un sistema abierto se puede aplicar no solo a las arquitecturas de sistemas y estructuras organizativas, sino también a las prácticas de trabajo, las interfaces humano-computadora y la relación entre las personas y las tecnologías: se pueden mencionar, por ejemplo, los sistemas de programación, los sistemas de control y Sistemas de Soporte a la Decisión. Un sistema abierto también es adaptativo cuando permite a las personas un alto grado de libertad para definir el modo de operar del sistema. Por ejemplo, en el área de fabricación avanzada, los requisitos de un sistema automatizado híbrido abierto se pueden cumplir a través del concepto de Manufactura integrada por humanos y computadoras (HCIM). Desde este punto de vista, el diseño de la tecnología debe abordar la arquitectura general del sistema HCIM, incluidos los siguientes: (1) consideraciones de la red de grupos, (2) la estructura de cada grupo, (3) la interacción entre grupos, (4) la naturaleza del software de soporte y (5) las necesidades técnicas de comunicación e integración entre los módulos de software de soporte.

El sistema automatizado híbrido adaptativo, a diferencia del sistema cerrado, no restringe lo que pueden hacer los operadores humanos. El papel del diseñador de un HAS es crear un sistema que satisfaga las preferencias personales del usuario y permita a sus usuarios trabajar de la forma que consideren más apropiada. Un requisito previo para permitir la entrada del usuario es el desarrollo de una metodología de diseño adaptativo, es decir, un OHAS que permita habilitar tecnología asistida por computadora para su implementación en el proceso de diseño. La necesidad de desarrollar una metodología para el diseño adaptativo es uno de los requisitos inmediatos para realizar el concepto OHAS en la práctica. También es necesario desarrollar un nuevo nivel de tecnología de control de supervisión humana adaptativa. Dicha tecnología debería permitir que el operador humano "vea a través" del sistema de control del funcionamiento del HAS, que de otro modo sería invisible, por ejemplo, mediante la aplicación de un sistema de video interactivo de alta velocidad en cada punto de control y operación del sistema. Finalmente, también es muy necesaria una metodología para el desarrollo de un soporte basado en computadora inteligente y altamente adaptable de roles humanos y funcionamiento humano en los sistemas automatizados híbridos.

" EXENCIÓN DE RESPONSABILIDAD: La OIT no se responsabiliza por el contenido presentado en este portal web que se presente en un idioma que no sea el inglés, que es el idioma utilizado para la producción inicial y la revisión por pares del contenido original. Ciertas estadísticas no se han actualizado desde la producción de la 4ª edición de la Enciclopedia (1998)."