Toxicología en la Regulación de Seguridad y Salud

La toxicología juega un papel importante en el desarrollo de regulaciones y otras políticas de salud ocupacional. Para prevenir lesiones y enfermedades ocupacionales, las decisiones se basan cada vez más en la información que se puede obtener antes o en ausencia de los tipos de exposición humana que producirían información definitiva sobre el riesgo, como los estudios epidemiológicos. Además, los estudios toxicológicos, tal como se describen en este capítulo, pueden brindar información precisa sobre la dosis y la respuesta en las condiciones controladas de la investigación de laboratorio; esta información suele ser difícil de obtener en el entorno no controlado de las exposiciones ocupacionales. Sin embargo, esta información debe evaluarse cuidadosamente para estimar la probabilidad de efectos adversos en humanos, la naturaleza de estos efectos adversos y la relación cuantitativa entre exposiciones y efectos.

Se ha prestado considerable atención en muchos países, desde la década de 1980, al desarrollo de métodos objetivos para utilizar la información toxicológica en la toma de decisiones reglamentarias. Métodos formales, frecuentemente denominados evaluación de riesgos, han sido propuestos y utilizados en estos países por entidades gubernamentales y no gubernamentales. La evaluación de riesgos se ha definido de diversas formas; fundamentalmente es un proceso evaluativo que incorpora información toxicológica, epidemiológica y de exposición para identificar y estimar la probabilidad de efectos adversos asociados con la exposición a sustancias o condiciones peligrosas. La evaluación de riesgos puede ser de naturaleza cualitativa, indicando la naturaleza de un efecto adverso y una estimación general de la probabilidad, o puede ser cuantitativa, con estimaciones del número de personas afectadas a niveles específicos de exposición. En muchos sistemas regulatorios, la evaluación de riesgos se lleva a cabo en cuatro etapas: identificación de peligros, la descripción de la naturaleza del efecto tóxico; evaluación dosis-respuesta, un análisis semicuantitativo o cuantitativo de la relación entre la exposición (o dosis) y la gravedad o probabilidad del efecto tóxico; Asesoramiento de exposición, la evaluación de la información sobre el rango de exposiciones que probablemente ocurran para las poblaciones en general o para los subgrupos dentro de las poblaciones; caracterización del riesgo, la compilación de toda la información anterior en una expresión de la magnitud del riesgo que se espera que ocurra bajo condiciones de exposición especificadas (ver NRC 1983 para una declaración de estos principios).

En esta sección, se presentan tres enfoques para la evaluación de riesgos a modo ilustrativo. Es imposible proporcionar un compendio completo de los métodos de evaluación de riesgos utilizados en todo el mundo, y estas selecciones no deben tomarse como prescriptivas. Cabe señalar que existen tendencias hacia la armonización de los métodos de evaluación de riesgos, en parte como respuesta a las disposiciones de los recientes acuerdos del GATT. Actualmente se encuentran en marcha dos procesos de armonización internacional de métodos de evaluación de riesgos, a través del Programa Internacional sobre Seguridad Química (IPCS) y la Organización para la Cooperación y el Desarrollo Económicos (OCDE). Estas organizaciones también mantienen información actualizada sobre enfoques nacionales para la evaluación de riesgos.

Estructura Actividad Relaciones

El análisis de las relaciones estructura-actividad (SAR) es la utilización de información sobre la estructura molecular de los productos químicos para predecir características importantes relacionadas con la persistencia, la distribución, la absorción y la toxicidad. SAR es un método alternativo para identificar posibles productos químicos peligrosos, que promete ayudar a las industrias y los gobiernos a priorizar sustancias para una evaluación adicional o para la toma de decisiones en la etapa inicial de nuevos productos químicos. La toxicología es una tarea cada vez más costosa y que requiere muchos recursos. Las crecientes preocupaciones sobre el potencial de los productos químicos para causar efectos adversos en las poblaciones humanas expuestas han llevado a las agencias reguladoras y de salud a ampliar el rango y la sensibilidad de las pruebas para detectar peligros toxicológicos. Al mismo tiempo, las cargas reales y percibidas de la regulación sobre la industria han provocado preocupaciones sobre la practicidad de los métodos de prueba de toxicidad y el análisis de datos. En la actualidad, la determinación de la carcinogenicidad química depende de las pruebas de por vida de al menos dos especies, ambos sexos, en varias dosis, con un análisis histopatológico cuidadoso de múltiples órganos, así como la detección de cambios preneoplásicos en células y órganos diana. En los Estados Unidos, se estima que el bioensayo del cáncer cuesta más de $3 millones (dólares de 1995).

Incluso con recursos financieros ilimitados, la carga de probar los aproximadamente 70,000 1984 productos químicos existentes producidos en el mundo actualmente excedería los recursos disponibles de toxicólogos capacitados. Se necesitarían siglos para completar incluso una evaluación de primer nivel de estos productos químicos (NRC 1993). En muchos países han aumentado las preocupaciones éticas sobre el uso de animales en las pruebas de toxicidad, lo que genera presiones adicionales sobre el uso de métodos estándar de pruebas de toxicidad. SAR ha sido ampliamente utilizado en la industria farmacéutica para identificar moléculas con potencial para uso beneficioso en el tratamiento (Hansch y Zhang 1979). En la política de salud ambiental y ocupacional, SAR se utiliza para predecir la dispersión de compuestos en el entorno físico-químico y para detectar nuevos productos químicos para una evaluación adicional de la toxicidad potencial. Bajo la Ley de Control de Sustancias Tóxicas (TSCA) de los EE. UU., la EPA ha utilizado desde 5 un enfoque SAR como una "primera selección" de nuevos productos químicos en el proceso de notificación previa a la fabricación (PMN); Australia utiliza un enfoque similar como parte de su procedimiento de notificación de nuevos productos químicos (NICNAS). En el análisis SAR de EE. UU. es una base importante para determinar que existe una base razonable para concluir que la fabricación, el procesamiento, la distribución, el uso o la eliminación de la sustancia presentarán un riesgo irrazonable de daño a la salud humana o al medio ambiente, como lo requiere la Sección 6(f) de TSCA. Sobre la base de este hallazgo, la EPA puede entonces requerir pruebas reales de la sustancia bajo la Sección XNUMX de la TSCA.

Justificación del SAR

La justificación científica del SAR se basa en la suposición de que la estructura molecular de una sustancia química predecirá aspectos importantes de su comportamiento en los sistemas físico-químicos y biológicos (Hansch y Leo 1979).

Proceso SAR

El proceso de revisión de SAR incluye la identificación de la estructura química, incluidas las formulaciones empíricas y el compuesto puro; identificación de sustancias estructuralmente análogas; buscar bases de datos y literatura para obtener información sobre análogos estructurales; y análisis de toxicidad y otros datos sobre análogos estructurales. En algunos casos raros, la información sobre la estructura del compuesto por sí sola puede ser suficiente para respaldar algún análisis SAR, basado en mecanismos de toxicidad bien conocidos. Se han compilado varias bases de datos sobre SAR, así como métodos informáticos para la predicción de estructuras moleculares.

Con esta información, se pueden estimar los siguientes puntos finales con SAR:

- parámetros físico-químicos: punto de ebullición, presión de vapor, solubilidad en agua, coeficiente de partición octanol/agua

- parámetros de destino biológico/ambiental: biodegradación, sorción del suelo, fotodegradación, farmacocinética

- parámetros de toxicidad: toxicidad en organismos acuáticos, absorción, toxicidad aguda en mamíferos (prueba límite o LD50), irritación dérmica, pulmonar y ocular, sensibilización, toxicidad subcrónica, mutagenicidad.

Cabe señalar que no existen métodos SAR para criterios de valoración de la salud tan importantes como la carcinogenicidad, la toxicidad para el desarrollo, la toxicidad para la reproducción, la neurotoxicidad, la inmunotoxicidad u otros efectos sobre los órganos diana. Esto se debe a tres factores: la falta de una gran base de datos sobre la cual probar las hipótesis de SAR, la falta de conocimiento de los determinantes estructurales de la acción tóxica y la multiplicidad de células diana y mecanismos que están involucrados en estos criterios de valoración (ver “The United States enfoque para la evaluación de riesgos de sustancias tóxicas para la reproducción y agentes neurotóxicos”). Algunos intentos limitados de utilizar SAR para predecir la farmacocinética utilizando información sobre coeficientes de partición y solubilidad (Johanson y Naslund 1988). Se ha realizado un SAR cuantitativo más extenso para predecir el metabolismo dependiente de P450 de una variedad de compuestos y la unión de moléculas similares a dioxinas y PCB al receptor citosólico de "dioxinas" (Hansch y Zhang 1993).

Se ha demostrado que SAR tiene una previsibilidad variable para algunos de los puntos finales enumerados anteriormente, como se muestra en la tabla 1. Esta tabla presenta datos de dos comparaciones de actividad prevista con resultados reales obtenidos por medición empírica o prueba de toxicidad. El SAR realizado por los expertos de la EPA de EE. UU. funcionó peor para predecir las propiedades físico-químicas que para predecir la actividad biológica, incluida la biodegradación. Para los puntos finales de toxicidad, SAR funcionó mejor para predecir la mutagenicidad. Ashby y Tennant (1991) en un estudio más extenso también encontraron una buena previsibilidad de la genotoxicidad a corto plazo en su análisis de las sustancias químicas NTP. Estos hallazgos no son sorprendentes, dada la comprensión actual de los mecanismos moleculares de la genotoxicidad (ver "Toxicología genética") y el papel de la electrofilia en la unión al ADN. Por el contrario, el SAR tendía a subestimar la toxicidad sistémica y subcrónica en los mamíferos ya sobreestimar la toxicidad aguda en los organismos acuáticos.

Tabla 1. Comparación de SAR y datos de prueba: análisis OECD/NTP

| Punto final | Convenio (%) | Desacuerdo (%) | Número |

| Punto de ebullición | 50 | 50 | 30 |

| Presión de vapor | 63 | 37 | 113 |

| Solubilidad del agua | 68 | 32 | 133 |

| Coeficiente de partición | 61 | 39 | 82 |

| Biodegradacion | 93 | 7 | 107 |

| Toxicidad en peces | 77 | 22 | 130 |

| Toxicidad de la dafnia | 67 | 33 | 127 |

| Toxicidad aguda en mamíferos (LD50 ) | 80 | 201 | 142 |

| Irritación de la piel | 82 | 18 | 144 |

| Irritación de ojo | 78 | 22 | 144 |

| sensibilización de la piel | 84 | 16 | 144 |

| Toxicidad subcrónica | 57 | 32 | 143 |

| Mutagenicidad2 | 88 | 12 | 139 |

| Mutagenicidad3 | 82-944 | 1-10 | 301 |

| Carcinogenicidad3 : Bioensayo de dos años | 72-954 | - | 301 |

Fuente: Datos de la OCDE, comunicación personal C. Auer, US EPA. Solo se utilizaron en este análisis aquellos criterios de valoración para los que se disponía de predicciones de SAR comparables y datos de pruebas reales. Los datos de NTP son de Ashby y Tennant 1991.

1 Preocupante fue el fracaso de SAR para predecir la toxicidad aguda en el 12% de los productos químicos probados.

2 Datos de la OCDE, basados en la concordancia de la prueba de Ames con SAR

3 Datos NTP, basados en ensayos genetox comparados con predicciones SAR para varias clases de "sustancias químicas de alerta estructural".

4 La concordancia varía con la clase; la concordancia más alta fue con compuestos amino/nitro aromáticos; más bajo con estructuras "misceláneas".

Para otros puntos finales tóxicos, como se señaló anteriormente, SAR tiene una utilidad menos demostrable. Las predicciones de toxicidad en mamíferos se complican por la falta de SAR para la toxicocinética de moléculas complejas. No obstante, se han hecho algunos intentos de proponer principios SAR para criterios de valoración complejos de toxicidad en mamíferos (por ejemplo, véase Bernstein (1984) para un análisis SAR de posibles sustancias tóxicas para la reproducción masculina). En la mayoría de los casos, la base de datos es demasiado pequeña para permitir pruebas rigurosas de predicciones basadas en estructuras.

En este punto, se puede concluir que SAR puede ser útil principalmente para priorizar la inversión en recursos de pruebas de toxicidad o para plantear inquietudes tempranas sobre peligros potenciales. Solo en el caso de la mutagenicidad es probable que el análisis SAR por sí mismo pueda utilizarse con fiabilidad para informar otras decisiones. Para ningún punto final es probable que el SAR pueda proporcionar el tipo de información cuantitativa necesaria para fines de evaluación de riesgos, como se analiza en otra parte de este capítulo y Enciclopedia.

Pruebas de toxicidad in vitro

La aparición de tecnologías sofisticadas en biología molecular y celular ha estimulado una evolución relativamente rápida en las ciencias de la vida, incluida la toxicología. En efecto, el enfoque de la toxicología está cambiando de animales completos y poblaciones de animales completos a las células y moléculas de animales individuales y humanos. Desde mediados de la década de 1980, los toxicólogos han comenzado a emplear estas nuevas metodologías para evaluar los efectos de las sustancias químicas en los sistemas vivos. Como una progresión lógica, estos métodos se están adaptando a los fines de las pruebas de toxicidad. Estos avances científicos han trabajado junto con factores sociales y económicos para efectuar cambios en la evaluación de la seguridad del producto y el riesgo potencial.

Los factores económicos están específicamente relacionados con el volumen de materiales que deben ser probados. Cada año se introduce en el mercado una plétora de nuevos cosméticos, productos farmacéuticos, pesticidas, productos químicos y productos para el hogar. Todos estos productos deben ser evaluados por su toxicidad potencial. Además, hay una acumulación de productos químicos que ya están en uso y que no se han probado adecuadamente. La enorme tarea de obtener información de seguridad detallada sobre todos estos productos químicos utilizando métodos tradicionales de prueba con animales completos sería costosa en términos de dinero y tiempo, si es que pudiera lograrse.

También existen problemas sociales relacionados con la salud y la seguridad públicas, así como una creciente preocupación pública sobre el uso de animales para las pruebas de seguridad de los productos. Con respecto a la seguridad humana, los grupos de defensa del interés público y ambiental han ejercido una presión significativa sobre las agencias gubernamentales para que apliquen regulaciones más estrictas sobre los productos químicos. Un ejemplo reciente de esto ha sido un movimiento de algunos grupos ambientalistas para prohibir el cloro y los compuestos que contienen cloro en los Estados Unidos. Una de las motivaciones para una acción tan extrema radica en el hecho de que la mayoría de estos compuestos nunca se han probado adecuadamente. Desde una perspectiva toxicológica, el concepto de prohibir toda una clase de productos químicos diversos basándose simplemente en la presencia de cloro es tanto científicamente erróneo como irresponsable. Sin embargo, es comprensible que, desde la perspectiva del público, debe existir cierta seguridad de que las sustancias químicas liberadas en el medio ambiente no representan un riesgo significativo para la salud. Tal situación subraya la necesidad de métodos más eficientes y rápidos para evaluar la toxicidad.

La otra preocupación social que ha afectado el área de las pruebas de toxicidad es el bienestar animal. El creciente número de grupos de protección animal en todo el mundo ha expresado una oposición considerable al uso de animales completos para las pruebas de seguridad de productos. Se han emprendido campañas activas contra los fabricantes de cosméticos, productos para el hogar y el cuidado personal y productos farmacéuticos en un intento de detener las pruebas con animales. Tales esfuerzos en Europa han resultado en la aprobación de la Sexta Enmienda a la Directiva 76/768/EEC (la Directiva de Cosméticos). La consecuencia de esta Directiva es que los productos cosméticos o ingredientes cosméticos que hayan sido probados en animales después del 1 de enero de 1998 no pueden comercializarse en la Unión Europea, a menos que los métodos alternativos no estén suficientemente validados. Si bien esta Directiva no tiene jurisdicción sobre la venta de dichos productos en los Estados Unidos u otros países, afectará significativamente a aquellas empresas que tienen mercados internacionales que incluyen a Europa.

El concepto de alternativas, que constituye la base para el desarrollo de ensayos distintos de los de animales enteros, se define por los tres Rs: reducción en el número de animales utilizados; refinamiento de protocolos para que los animales experimenten menos estrés o molestias; y reemplazo de las pruebas actuales en animales con pruebas in vitro (es decir, pruebas realizadas fuera del animal vivo), modelos informáticos o pruebas en especies de vertebrados inferiores o invertebrados. El tres Rs fueron introducidos en un libro publicado en 1959 por dos científicos británicos, WMS Russell y Rex Burch, Los principios de la técnica experimental humanitaria. Russell y Burch sostuvieron que la única forma en que se pueden obtener resultados científicos válidos es a través del trato humanitario de los animales y creían que se deberían desarrollar métodos para reducir el uso de animales y, en última instancia, reemplazarlo. Curiosamente, los principios descritos por Russell y Burch recibieron poca atención hasta el resurgimiento del movimiento por el bienestar animal a mediados de la década de 1970. Hoy el concepto de los tres Rs está muy a la vanguardia con respecto a la investigación, las pruebas y la educación.

En resumen, el desarrollo de metodologías de prueba in vitro se ha visto influenciado por una variedad de factores que han convergido en los últimos diez a 20 años. Es difícil determinar si alguno de estos factores por sí solo habría tenido un efecto tan profundo en las estrategias de pruebas de toxicidad.

Concepto de Ensayos de Toxicidad In Vitro

Esta sección se centrará únicamente en los métodos in vitro para evaluar la toxicidad, como una de las alternativas a las pruebas con animales completos. En otros artículos de este capítulo se analizan alternativas adicionales sin animales, como el modelado por computadora y las relaciones cuantitativas entre estructura y actividad.

Los estudios in vitro generalmente se llevan a cabo en células o tejidos animales o humanos fuera del cuerpo. In vitro significa literalmente “en vidrio”, y se refiere a procedimientos llevados a cabo en material vivo o componentes de material vivo cultivados en placas de Petri o en tubos de ensayo bajo condiciones definidas. Estos pueden contrastarse con los estudios in vivo, o los realizados “en el animal vivo”. Si bien es difícil, si no imposible, proyectar los efectos de un químico en un organismo complejo cuando las observaciones se limitan a un solo tipo de células en un plato, los estudios in vitro también brindan una cantidad significativa de información sobre la toxicidad intrínseca. como mecanismos celulares y moleculares de toxicidad. Además, ofrecen muchas ventajas sobre los estudios in vivo, ya que generalmente son menos costosos y pueden realizarse en condiciones más controladas. Además, a pesar de que todavía se necesita un pequeño número de animales para obtener células para cultivos in vitro, estos métodos pueden considerarse alternativas de reducción (ya que se utilizan muchos menos animales en comparación con los estudios in vivo) y alternativas de refinamiento (porque eliminan la necesidad de someter a los animales a las consecuencias tóxicas adversas impuestas por los experimentos in vivo).

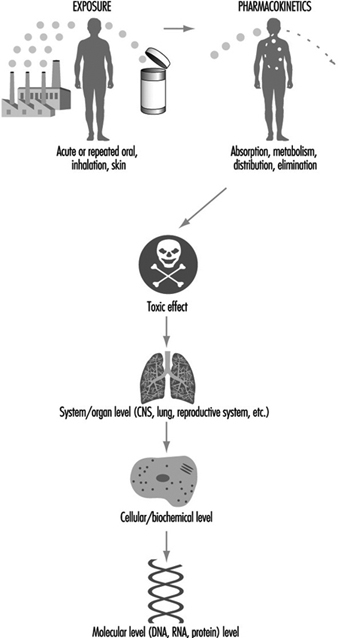

Para interpretar los resultados de las pruebas de toxicidad in vitro, determinar su utilidad potencial para evaluar la toxicidad y relacionarlos con el proceso toxicológico general in vivo, es necesario comprender qué parte del proceso toxicológico se está examinando. Todo el proceso toxicológico consiste en eventos que comienzan con la exposición del organismo a un agente físico o químico, progresan a través de interacciones celulares y moleculares y finalmente se manifiestan en la respuesta de todo el organismo. Las pruebas in vitro generalmente se limitan a la parte del proceso toxicológico que tiene lugar a nivel celular y molecular. Los tipos de información que se pueden obtener de los estudios in vitro incluyen vías de metabolismo, interacción de metabolitos activos con objetivos celulares y moleculares y puntos finales tóxicos potencialmente medibles que pueden servir como biomarcadores moleculares para la exposición. En una situación ideal, se conocería el mecanismo de toxicidad de cada sustancia química a partir de la exposición a la manifestación del organismo, de modo que la información obtenida de las pruebas in vitro podría interpretarse completamente y relacionarse con la respuesta de todo el organismo. Sin embargo, esto es prácticamente imposible, ya que se han dilucidado relativamente pocos mecanismos toxicológicos completos. Por lo tanto, los toxicólogos se enfrentan a una situación en la que los resultados de una prueba in vitro no pueden utilizarse como una predicción totalmente precisa de la toxicidad in vivo porque se desconoce el mecanismo. Sin embargo, con frecuencia durante el proceso de desarrollo de una prueba in vitro, se aclaran los componentes de los mecanismos celulares y moleculares de toxicidad.

Una de las cuestiones clave no resueltas que rodean el desarrollo y la implementación de las pruebas in vitro está relacionada con la siguiente consideración: ¿deben basarse mecánicamente o es suficiente que sean descriptivas? Es indiscutiblemente mejor desde una perspectiva científica utilizar únicamente pruebas mecánicas como reemplazo de las pruebas in vivo. Sin embargo, en ausencia de un conocimiento mecanicista completo, la perspectiva de desarrollar pruebas in vitro para reemplazar completamente las pruebas con animales completos en un futuro cercano es casi nula. Sin embargo, esto no descarta el uso de tipos de análisis más descriptivos como herramientas de detección temprana, como es el caso actualmente. Estas pantallas han dado como resultado una reducción significativa en el uso de animales. Por lo tanto, hasta que se genere más información mecanicista, puede ser necesario emplear, en una medida más limitada, pruebas cuyos resultados simplemente se correlacionen bien con los obtenidos in vivo.

Pruebas in vitro de citotoxicidad

En esta sección, se describirán varias pruebas in vitro que se han desarrollado para evaluar el potencial citotóxico de una sustancia química. En su mayor parte, estas pruebas son fáciles de realizar y el análisis se puede automatizar. Una prueba in vitro de uso común para la citotoxicidad es el ensayo de rojo neutro. Este ensayo se realiza en células en cultivo y, para la mayoría de las aplicaciones, las células se pueden mantener en placas de cultivo que contienen 96 pocillos pequeños, cada uno de 6.4 mm de diámetro. Dado que cada pocillo se puede utilizar para una única determinación, esta disposición puede admitir múltiples concentraciones de la sustancia problema, así como controles positivos y negativos con un número suficiente de réplicas para cada uno. Después del tratamiento de las células con diversas concentraciones de la sustancia problema en un rango de al menos dos órdenes de magnitud (p. ej., de 0.01 mM a 1 mM), así como con productos químicos de control positivo y negativo, las células se enjuagan y se tratan con rojo neutro, un colorante que puede ser absorbido y retenido solo por células vivas. El colorante puede añadirse tras la eliminación de la sustancia problema para determinar los efectos inmediatos, o puede añadirse en varios momentos después de eliminar la sustancia problema para determinar los efectos acumulativos o retardados. La intensidad del color en cada pozo corresponde al número de células vivas en ese pozo. La intensidad del color se mide con un espectrofotómetro que puede estar equipado con un lector de placas. El lector de placas está programado para proporcionar mediciones individuales para cada uno de los 96 pocillos de la placa de cultivo. Esta metodología automatizada permite al investigador realizar rápidamente un experimento de concentración-respuesta y obtener datos estadísticamente útiles.

Otro ensayo relativamente simple para la citotoxicidad es la prueba MTT. El MTT (bromuro de 3[4,5-dimetiltiazol-2-il]-2,5-difeniltetrazolio) es un colorante de tetrazolio que las enzimas mitocondriales reducen a un color azul. Solo las células con mitocondrias viables conservarán la capacidad de llevar a cabo esta reacción; por lo tanto, la intensidad del color está directamente relacionada con el grado de integridad mitocondrial. Esta es una prueba útil para detectar compuestos citotóxicos generales, así como aquellos agentes que se dirigen específicamente a las mitocondrias.

La medición de la actividad de la lactato deshidrogenasa (LDH) también se utiliza como un ensayo de base amplia para la citotoxicidad. Esta enzima normalmente está presente en el citoplasma de las células vivas y se libera en el medio de cultivo celular a través de membranas celulares con fugas de células muertas o moribundas que han sido afectadas negativamente por un agente tóxico. Se pueden eliminar pequeñas cantidades de medio de cultivo en varios momentos después del tratamiento químico de las células para medir la cantidad de LDH liberada y determinar el curso temporal de la toxicidad. Si bien el ensayo de liberación de LDH es una evaluación muy general de la citotoxicidad, es útil porque es fácil de realizar y se puede realizar en tiempo real.

Se están desarrollando muchos métodos nuevos para detectar daño celular. Los métodos más sofisticados emplean sondas fluorescentes para medir una variedad de parámetros intracelulares, como la liberación de calcio y los cambios en el pH y el potencial de membrana. En general, estas sondas son muy sensibles y pueden detectar cambios celulares más sutiles, lo que reduce la necesidad de utilizar la muerte celular como criterio de valoración. Además, muchos de estos ensayos fluorescentes pueden automatizarse mediante el uso de placas de 96 pocillos y lectores de placas fluorescentes.

Una vez que se han recopilado los datos sobre una serie de productos químicos usando una de estas pruebas, se pueden determinar las toxicidades relativas. La toxicidad relativa de una sustancia química, determinada en una prueba in vitro, puede expresarse como la concentración que ejerce un efecto del 50 % sobre la respuesta de punto final de las células no tratadas. Esta determinación se conoce como la CE50 (Eefectivo Cconcentración para 50% de las células) y se puede utilizar para comparar la toxicidad de diferentes productos químicos in vitro. (Un término similar utilizado para evaluar la toxicidad relativa es IC50, que indica la concentración de una sustancia química que provoca una inhibición del 50 % de un proceso celular, por ejemplo, la capacidad de absorber el rojo neutro). No es fácil evaluar si la toxicidad relativa in vitro de las sustancias químicas es comparable a su relativa en toxicidades vivo, ya que hay tantos factores de confusión en el sistema in vivo, como la toxicocinética, el metabolismo, la reparación y los mecanismos de defensa. Además, dado que la mayoría de estos ensayos miden puntos finales generales de citotoxicidad, no se basan en mecanismos. Por lo tanto, la concordancia entre las toxicidades relativas in vitro e in vivo es simplemente correlativa. A pesar de las numerosas complejidades y dificultades en la extrapolación de in vitro a in vivo, estas pruebas in vitro están demostrando ser muy valiosas porque son simples y económicas de realizar y pueden usarse como pantallas para detectar drogas o productos químicos altamente tóxicos en las primeras etapas de desarrollo.

Toxicidad en órganos diana

Las pruebas in vitro también se pueden utilizar para evaluar la toxicidad específica de órganos diana. Hay una serie de dificultades asociadas con el diseño de tales pruebas, siendo la más notable la incapacidad de los sistemas in vitro para mantener muchas de las características del órgano in vivo. Con frecuencia, cuando las células se toman de animales y se colocan en cultivo, tienden a degenerar rápidamente y/o a desdiferenciarse, es decir, pierden sus funciones similares a las de los órganos y se vuelven más genéricas. Esto presenta el problema de que dentro de un corto período de tiempo, normalmente unos pocos días, los cultivos ya no son útiles para evaluar los efectos de una toxina en órganos específicos.

Muchos de estos problemas se están superando gracias a los recientes avances en biología molecular y celular. La información que se obtiene sobre el entorno celular in vivo puede utilizarse para modular las condiciones de cultivo in vitro. Desde mediados de la década de 1980, se han descubierto nuevos factores de crecimiento y citoquinas, y muchos de ellos ahora están disponibles comercialmente. La adición de estos factores a las células en cultivo ayuda a preservar su integridad y también puede ayudar a conservar funciones más diferenciadas durante períodos de tiempo más prolongados. Otros estudios básicos han aumentado el conocimiento de los requerimientos nutricionales y hormonales de las células en cultivo, de modo que se puedan formular nuevos medios. También se han realizado avances recientes en la identificación de matrices extracelulares tanto naturales como artificiales en las que se pueden cultivar células. El cultivo de células en estas diferentes matrices puede tener efectos profundos tanto en su estructura como en su función. Una gran ventaja derivada de este conocimiento es la capacidad de controlar de forma compleja el entorno de las células en cultivo y examinar individualmente los efectos de estos factores en los procesos celulares básicos y en sus respuestas a diferentes agentes químicos. En resumen, estos sistemas pueden proporcionar una gran comprensión de los mecanismos de toxicidad específicos de órganos.

Muchos estudios de toxicidad en órganos diana se llevan a cabo en células primarias, que por definición se aíslan recientemente de un órgano y, por lo general, exhiben una vida finita en cultivo. Hay muchas ventajas de tener cultivos primarios de un solo tipo de célula de un órgano para la evaluación de la toxicidad. Desde una perspectiva mecanicista, tales cultivos son útiles para estudiar objetivos celulares específicos de una sustancia química. En algunos casos, se pueden cultivar juntos dos o más tipos de células de un órgano, lo que proporciona la ventaja adicional de poder observar las interacciones célula-célula en respuesta a una toxina. Se han diseñado algunos sistemas de cocultivo para la piel de modo que formen una estructura tridimensional que se asemeje a la piel in vivo. También es posible cocultivar células de diferentes órganos, por ejemplo, hígado y riñón. Este tipo de cultivo sería útil para evaluar los efectos específicos en las células renales de una sustancia química que debe bioactivarse en el hígado.

Las herramientas de biología molecular también han jugado un papel importante en el desarrollo de líneas celulares continuas que pueden ser útiles para las pruebas de toxicidad en órganos diana. Estas líneas celulares se generan mediante la transfección de ADN en células primarias. En el procedimiento de transfección, las células y el ADN se tratan de manera que el ADN pueda ser absorbido por las células. El ADN suele ser de un virus y contiene un gen o genes que, cuando se expresan, permiten que las células se inmortalicen (es decir, sean capaces de vivir y crecer durante largos períodos de tiempo en cultivo). El ADN también puede diseñarse de manera que el gen inmortalizador sea controlado por un promotor inducible. La ventaja de este tipo de construcción es que las células se dividirán solo cuando reciban el estímulo químico apropiado para permitir la expresión del gen inmortalizador. Un ejemplo de tal construcción es el gen del antígeno T grande del virus Simian Virus 40 (SV40) (el gen inmortalizador), precedido por la región promotora del gen de la metalotioneína, que es inducida por la presencia de un metal en el medio de cultivo. Por lo tanto, después de transfectar el gen en las células, las células pueden tratarse con bajas concentraciones de zinc para estimular el promotor de MT y activar la expresión del gen del antígeno T. En estas condiciones, las células proliferan. Cuando se elimina el zinc del medio, las células dejan de dividirse y, en condiciones ideales, vuelven a un estado en el que expresan sus funciones específicas de tejido.

La capacidad de generar células inmortalizadas combinada con los avances en la tecnología de cultivo celular han contribuido en gran medida a la creación de líneas celulares de muchos órganos diferentes, incluidos el cerebro, el riñón y el hígado. Sin embargo, antes de que estas líneas celulares puedan usarse como sustitutos de los tipos de células de buena fe, deben caracterizarse cuidadosamente para determinar qué tan "normales" son realmente.

Otros sistemas in vitro para estudiar la toxicidad en órganos diana implican una complejidad creciente. A medida que los sistemas in vitro progresan en complejidad desde el cultivo de una sola célula hasta el cultivo de órganos completos, se vuelven más comparables con el medio in vivo, pero al mismo tiempo se vuelven mucho más difíciles de controlar dado el mayor número de variables. Por lo tanto, lo que se puede ganar al pasar a un nivel superior de organización se puede perder en la incapacidad del investigador para controlar el entorno experimental. La Tabla 1 compara algunas de las características de varios sistemas in vitro que se han utilizado para estudiar la hepatotoxicidad.

Tabla 1. Comparación de sistemas in vitro para estudios de hepatotoxicidad

| System | Complejidad (nivel de interacción) |

Capacidad para retener funciones específicas del hígado. | Duración potencial del cultivo | Habilidad para controlar el entorno. |

| Líneas celulares inmortalizadas | algo de celda a celda (varía con la línea celular) | pobre a bueno (varía con la línea celular) | indefinido | excelente, |

| Cultivos primarios de hepatocitos | celda a celda | regular a excelente (varía con las condiciones de cultivo) | dias a semanas | excelente, |

| Cocultivos de células hepáticas | celda a celda (entre el mismo y diferentes tipos de células) | bueno a excelente | semanas. | excelente, |

| Rebanadas de hígado | célula a célula (entre todos los tipos de células) | bueno a excelente | horas a días | candidato |

| Hígado aislado, perfundido | de célula a célula (entre todos los tipos de células), e intra-órgano | excelente, | horas | feria |

Las rebanadas de tejido cortadas con precisión se utilizan cada vez más para estudios toxicológicos. Hay nuevos instrumentos disponibles que permiten al investigador cortar rebanadas uniformes de tejido en un ambiente estéril. Los cortes de tejido ofrecen alguna ventaja sobre los sistemas de cultivo celular en el sentido de que todos los tipos de células del órgano están presentes y mantienen su arquitectura in vivo y comunicación intercelular. Por lo tanto, se pueden realizar estudios in vitro para determinar el tipo de célula diana dentro de un órgano, así como para investigar la toxicidad específica del órgano diana. Una desventaja de los cortes es que degeneran rápidamente después de las primeras 24 horas de cultivo, principalmente debido a la mala difusión de oxígeno a las células en el interior de los cortes. Sin embargo, estudios recientes han indicado que se puede lograr una aireación más eficiente mediante una rotación suave. Esto, junto con el uso de un medio más complejo, permite que las rodajas sobrevivan hasta 96 horas.

Los explantes de tejido son similares en concepto a los cortes de tejido y también se pueden utilizar para determinar la toxicidad de los productos químicos en órganos diana específicos. Los explantes de tejido se establecen extrayendo un pequeño trozo de tejido (para estudios de teratogenicidad, un embrión intacto) y colocándolo en cultivo para su posterior estudio. Los cultivos de explantes han sido útiles para estudios de toxicidad a corto plazo que incluyen irritación y corrosividad en la piel, estudios de asbesto en la tráquea y estudios de neurotoxicidad en el tejido cerebral.

Los órganos perfundidos aislados también se pueden utilizar para evaluar la toxicidad en órganos diana. Estos sistemas ofrecen una ventaja similar a la de los cortes de tejido y los explantes en el sentido de que están presentes todos los tipos de células, pero sin el estrés que suponen para el tejido las manipulaciones implicadas en la preparación de los cortes. Además, permiten el mantenimiento de interacciones intraorgánicas. Una desventaja importante es su viabilidad a corto plazo, lo que limita su uso para pruebas de toxicidad in vitro. En términos de servir como una alternativa, estos cultivos pueden considerarse un refinamiento ya que los animales no experimentan las consecuencias adversas del tratamiento in vivo con tóxicos. Sin embargo, su uso no disminuye significativamente el número de animales necesarios.

En resumen, hay varios tipos de sistemas in vitro disponibles para evaluar la toxicidad en órganos diana. Es posible adquirir mucha información sobre los mecanismos de toxicidad usando una o más de estas técnicas. La dificultad permanece en saber cómo extrapolar de un sistema in vitro, que representa una parte relativamente pequeña del proceso toxicológico, a todo el proceso que ocurre in vivo.

Pruebas in vitro para la irritación ocular

Quizás la prueba de toxicidad en animales enteros más polémica desde la perspectiva del bienestar animal es la prueba Draize para la irritación ocular, que se realiza en conejos. En esta prueba, se coloca una pequeña dosis fija de un químico en uno de los ojos del conejo mientras que el otro ojo se usa como control. El grado de irritación e inflamación se puntúa en varios momentos después de la exposición. Se está haciendo un gran esfuerzo para desarrollar metodologías que sustituyan a esta prueba, que ha sido criticada no solo por razones humanas, sino también por la subjetividad de las observaciones y la variabilidad de los resultados. Es interesante señalar que, a pesar de las duras críticas que ha recibido la prueba de Draize, ha demostrado tener un éxito notable en la predicción de los irritantes oculares humanos, en particular las sustancias ligeramente o moderadamente irritantes, que son difíciles de identificar por otros métodos. Por lo tanto, las demandas de alternativas in vitro son grandes.

La búsqueda de alternativas a la prueba de Draize es complicada, aunque se prevé que tenga éxito. Se han desarrollado numerosas alternativas in vitro y de otro tipo y en algunos casos se han implementado. Las alternativas de refinamiento a la prueba Draize, que por definición son menos dolorosas o angustiosas para los animales, incluyen la prueba ocular de bajo volumen, en la que se colocan cantidades más pequeñas de materiales de prueba en los ojos de los conejos, no solo por razones humanitarias, sino también para imitar más de cerca las cantidades a las que las personas pueden estar realmente expuestas accidentalmente. Otro refinamiento es que las sustancias que tienen un pH inferior a 2 o superior a 11.5 ya no se prueban en animales, ya que se sabe que irritan gravemente los ojos.

Entre 1980 y 1989, hubo una disminución estimada del 87% en el número de conejos utilizados para las pruebas de irritación ocular de los cosméticos. Las pruebas in vitro se han incorporado como parte de un enfoque de pruebas por niveles para lograr esta gran reducción en las pruebas con animales completos. Este enfoque es un proceso de varios pasos que comienza con un examen exhaustivo de los datos históricos de irritación ocular y el análisis físico y químico de la sustancia química que se va a evaluar. Si estos dos procesos no arrojan suficiente información, se realiza una batería de pruebas in vitro. Los datos adicionales obtenidos de las pruebas in vitro podrían entonces ser suficientes para evaluar la seguridad de la sustancia. De lo contrario, el paso final sería realizar pruebas in vivo limitadas. Es fácil ver cómo este enfoque puede eliminar o al menos reducir drásticamente el número de animales necesarios para predecir la seguridad de una sustancia de prueba.

La batería de pruebas in vitro que se utiliza como parte de esta estrategia de prueba por niveles depende de las necesidades de la industria en particular. Las pruebas de irritación ocular se realizan en una amplia variedad de industrias, desde cosmética hasta productos farmacéuticos y productos químicos industriales. El tipo de información requerida por cada industria varía y por lo tanto no es posible definir una sola batería de pruebas in vitro. Una batería de pruebas generalmente está diseñada para evaluar cinco parámetros: citotoxicidad, cambios en la fisiología y bioquímica del tejido, relaciones cuantitativas entre estructura y actividad, mediadores de inflamación y recuperación y reparación. Un ejemplo de una prueba de citotoxicidad, que es una posible causa de irritación, es el ensayo de rojo neutro que usa células cultivadas (ver arriba). Los cambios en la fisiología celular y la bioquímica resultantes de la exposición a una sustancia química pueden analizarse en cultivos de células epiteliales corneales humanas. Alternativamente, los investigadores también han utilizado globos oculares de bovinos o pollos intactos o disecados obtenidos de los mataderos. Muchos de los criterios de valoración medidos en estos cultivos de órganos completos son los mismos que los medidos in vivo, como la opacidad de la córnea y la hinchazón de la córnea.

La inflamación es con frecuencia un componente de las lesiones oculares inducidas por sustancias químicas y hay varios ensayos disponibles para examinar este parámetro. Diversos ensayos bioquímicos detectan la presencia de mediadores liberados durante el proceso inflamatorio como el ácido araquidónico y las citoquinas. La membrana corioalantoidea (CAM) del huevo de gallina también se puede utilizar como indicador de inflamación. En el ensayo CAM, se extrae un pequeño trozo de la cáscara de un embrión de pollo de diez a 14 días para exponer la CAM. A continuación, se aplica el producto químico a la CAM y se puntúan los signos de inflamación, como hemorragia vascular, en varios momentos posteriores.

Uno de los procesos in vivo más difíciles de evaluar in vitro es la recuperación y reparación de lesiones oculares. Un instrumento recientemente desarrollado, el microfisiómetro de silicio, mide pequeños cambios en el pH extracelular y puede usarse para monitorear células cultivadas en tiempo real. Se ha demostrado que este análisis se correlaciona bastante bien con la recuperación in vivo y se ha utilizado como prueba in vitro para este proceso. Este ha sido un breve resumen de los tipos de pruebas que se emplean como alternativas a la prueba de Draize para la irritación ocular. Es probable que en los próximos años se defina una serie completa de baterías de pruebas in vitro y cada una se valide para su propósito específico.

Validación

La clave para la aceptación regulatoria y la implementación de metodologías de prueba in vitro es la validación, el proceso mediante el cual se establece la credibilidad de una prueba candidata para un propósito específico. Se han realizado esfuerzos para definir y coordinar el proceso de validación tanto en los Estados Unidos como en Europa. La Unión Europea estableció el Centro Europeo para la Validación de Métodos Alternativos (ECVAM) en 1993 para coordinar esfuerzos allí e interactuar con organizaciones estadounidenses como el Johns Hopkins Center for Alternatives to Animal Testing (CAAT), un centro académico en los Estados Unidos. , y el Comité Coordinador Interinstitucional para la Validación de Métodos Alternativos (ICCVAM), compuesto por representantes de los Institutos Nacionales de Salud, la Agencia de Protección Ambiental de EE. UU., la Administración de Drogas y Alimentos de EE. UU. y la Comisión de Seguridad de Productos de Consumo.

La validación de las pruebas in vitro requiere una organización y planificación sustanciales. Debe haber consenso entre los reguladores gubernamentales y los científicos académicos e industriales sobre los procedimientos aceptables, y la supervisión suficiente por parte de un consejo asesor científico para garantizar que los protocolos cumplan con los estándares establecidos. Los estudios de validación deben realizarse en una serie de laboratorios de referencia utilizando conjuntos calibrados de productos químicos de un banco químico y células o tejidos de una sola fuente. Tanto la repetibilidad intralaboratorio como la reproducibilidad entre laboratorios de una prueba candidata deben demostrarse y los resultados deben someterse a un análisis estadístico apropiado. Una vez que se han compilado los resultados de los diferentes componentes de los estudios de validación, el consejo asesor científico puede hacer recomendaciones sobre la validez de la(s) prueba(s) candidata(s) para un propósito específico. Además, los resultados de los estudios deben publicarse en revistas revisadas por pares y colocarse en una base de datos.

La definición del proceso de validación es actualmente un trabajo en progreso. Cada nuevo estudio de validación proporcionará información útil para el diseño del próximo estudio. La comunicación y la cooperación internacionales son esenciales para el rápido desarrollo de una serie de protocolos ampliamente aceptables, particularmente dada la mayor urgencia impuesta por la aprobación de la Directiva de Cosméticos de la CE. De hecho, esta legislación puede proporcionar el impulso necesario para emprender un esfuerzo serio de validación. Solo a través de la finalización de este proceso puede comenzar la aceptación de los métodos in vitro por parte de las diversas comunidades reguladoras.

Conclusión

Este artículo ha proporcionado una visión general amplia del estado actual de las pruebas de toxicidad in vitro. La ciencia de la toxicología in vitro es relativamente joven, pero está creciendo exponencialmente. El desafío para los próximos años es incorporar el conocimiento mecanicista generado por los estudios celulares y moleculares al vasto inventario de datos in vivo para proporcionar una descripción más completa de los mecanismos toxicológicos, así como para establecer un paradigma mediante el cual se puedan utilizar los datos in vitro. para predecir la toxicidad in vivo. Solo será a través de los esfuerzos concertados de toxicólogos y representantes gubernamentales que se podrá realizar el valor inherente de estos métodos in vitro.

Evaluación de toxicidad genética

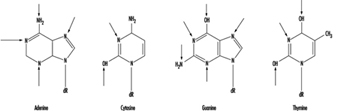

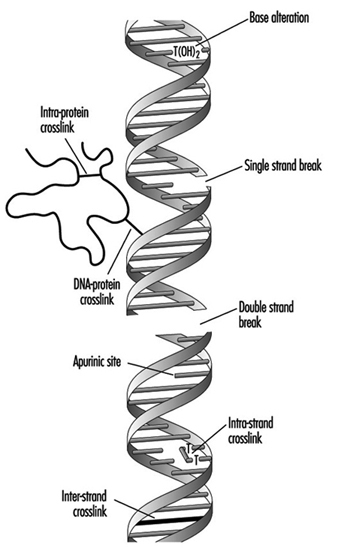

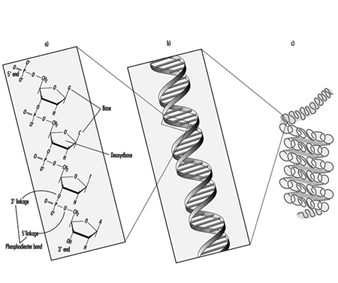

La evaluación de la toxicidad genética es la evaluación de los agentes por su capacidad para inducir cualquiera de los tres tipos generales de cambios (mutaciones) en el material genético (ADN): genético, cromosómico y genómico. En organismos como los humanos, los genes están compuestos de ADN, que consta de unidades individuales llamadas bases de nucleótidos. Los genes están dispuestos en estructuras físicas discretas llamadas cromosomas. La genotoxicidad puede tener efectos significativos e irreversibles sobre la salud humana. El daño genotóxico es un paso crítico en la inducción del cáncer y también puede estar involucrado en la inducción de defectos de nacimiento y muerte fetal. Las tres clases de mutaciones mencionadas anteriormente pueden ocurrir dentro de cualquiera de los dos tipos de tejidos que poseen organismos como los humanos: espermatozoides u óvulos (células germinales) y el tejido restante (células somáticas).

Los ensayos que miden la mutación génica son aquellos que detectan la sustitución, adición o eliminación de nucleótidos dentro de un gen. Los ensayos que miden la mutación cromosómica son aquellos que detectan rupturas o reordenamientos cromosómicos que involucran uno o más cromosomas. Los ensayos que miden la mutación genómica son aquellos que detectan cambios en el número de cromosomas, una condición llamada aneuploidía. La evaluación de la toxicidad genética ha cambiado considerablemente desde el desarrollo por parte de Herman Muller en 1927 del primer ensayo para detectar agentes genotóxicos (mutagénicos). Desde entonces, se han desarrollado más de 200 ensayos que miden mutaciones en el ADN; sin embargo, menos de diez ensayos se utilizan comúnmente hoy en día para la evaluación de la toxicidad genética. Este artículo revisa estos ensayos, describe lo que miden y explora el papel de estos ensayos en la evaluación de la toxicidad.

Identificación de riesgos de cáncer antes del desarrollo del Campo de Toxicología Genética

La toxicología genética se ha convertido en una parte integral del proceso general de evaluación de riesgos y ha ganado prestigio en los últimos tiempos como predictor fiable de la actividad cancerígena. Sin embargo, antes del desarrollo de la toxicología genética (antes de 1970), se usaban y todavía se usan otros métodos para identificar los riesgos potenciales de cáncer para los humanos. Hay seis categorías principales de métodos utilizados actualmente para identificar los riesgos de cáncer humano: estudios epidemiológicos, bioensayos in vivo a largo plazo, bioensayos in vivo a mediano plazo, bioensayos in vivo e in vitro a corto plazo, inteligencia artificial (estructura-actividad), e inferencia basada en mecanismos.

La Tabla 1 muestra las ventajas y desventajas de estos métodos.

Tabla 1. Ventajas y desventajas de los métodos actuales para identificar los riesgos de cáncer en humanos

| Ventajas | Desventajas | |

| Estudios epidemiológicos | (1) los humanos son los últimos indicadores de enfermedad; (2) evaluar poblaciones sensibles o susceptibles; (3) cohortes de exposición ocupacional; (4) alertas ambientales centinela |

(1) generalmente retrospectivo (certificados de defunción, sesgos de recuerdo, etc.); (2) insensible, costoso, extenso; (3) datos de exposición confiables a veces no disponibles o difíciles de obtener; (4) exposiciones combinadas, múltiples y complejas; falta de cohortes de control apropiadas; (5) experimentos en humanos no realizados; (6) detección del cáncer, no prevención |

| Bioensayos in vivo a largo plazo | (1) evaluaciones prospectivas y retrospectivas (validación); (2) excelente correlación con carcinógenos humanos identificados; (3) niveles de exposición y condiciones conocidas; (4) identifica la toxicidad química y los efectos cancerígenos; (5) resultados obtenidos con relativa rapidez; (6) comparaciones cualitativas entre clases químicas; (7) sistemas biológicos integrativos e interactivos relacionados estrechamente con los humanos | (1) raramente replicado, intensivo en recursos; (3) instalaciones limitadas adecuadas para tales experimentos; (4) debate sobre la extrapolación de especies; (5) las exposiciones utilizadas se encuentran a menudo en niveles muy superiores a los que experimentan los seres humanos; (6) la exposición a un solo químico no imita la exposición humana, que generalmente es a múltiples químicos simultáneamente |

| Bioensayos in vivo e in vitro a medio y corto plazo | (1) más rápido y menos costoso que otros ensayos; (2) muestras grandes que se replican fácilmente; (3) se miden puntos finales biológicamente significativos (mutación, etc.); (4) se puede utilizar como ensayos de detección para seleccionar productos químicos para bioensayos a largo plazo |

(1) in vitro no completamente predictivo de in vivo; (2) generalmente organismo u órgano específico; (3) potencias no comparables con animales completos o humanos |

| Asociaciones estructura química-actividad biológica | (1) relativamente fácil, rápido y económico; (2) fiable para ciertas clases de productos químicos (p. ej., nitrosaminas y tintes de bencidina); (3) desarrollado a partir de datos biológicos pero no dependiente de experimentación biológica adicional | (1) no “biológico”; (2) muchas excepciones a las reglas formuladas; (3) retrospectivo y rara vez (pero llegando a ser) prospectivo |

| Inferencias basadas en mecanismos | (1) razonablemente precisa para ciertas clases de productos químicos; (2) permite refinamientos de hipótesis; (3) puede orientar las evaluaciones de riesgo a poblaciones sensibles | (1) mecanismos de carcinogénesis química indefinidos, múltiples y probablemente específicos de una clase o sustancia química; (2) puede no resaltar las excepciones a los mecanismos generales |

Justificación y base conceptual para los ensayos de toxicología genética

Aunque los tipos exactos y la cantidad de ensayos utilizados para la evaluación de la toxicidad genética están en constante evolución y varían de un país a otro, los más comunes incluyen ensayos para (1) mutaciones genéticas en bacterias y/o células de mamíferos cultivadas y (2) mutaciones cromosómicas en células de mamífero cultivadas y/o médula ósea dentro de ratones vivos. Algunos de los ensayos dentro de esta segunda categoría también pueden detectar aneuploidía. Aunque estos ensayos no detectan mutaciones en células germinales, se utilizan principalmente debido al costo adicional y la complejidad de realizar ensayos de células germinales. No obstante, los ensayos de células germinales en ratones se utilizan cuando se desea obtener información sobre los efectos de las células germinales.

Los estudios sistemáticos durante un período de 25 años (1970-1995), especialmente en el Programa Nacional de Toxicología de EE. UU. en Carolina del Norte, han resultado en el uso de un número discreto de ensayos para detectar la actividad mutagénica de los agentes. El fundamento para evaluar la utilidad de los ensayos se basó en su capacidad para detectar agentes que causan cáncer en roedores y que se sospecha que causan cáncer en humanos (es decir, carcinógenos). Esto se debe a que los estudios realizados durante las últimas décadas han indicado que las células cancerosas contienen mutaciones en ciertos genes y que muchos carcinógenos también son mutágenos. Por lo tanto, se considera que las células cancerosas contienen mutaciones de células somáticas, y la carcinogénesis se considera un tipo de mutagénesis de células somáticas.

Los ensayos de toxicidad genética que se utilizan más comúnmente en la actualidad se han seleccionado no solo por su gran base de datos, su costo relativamente bajo y su facilidad de ejecución, sino porque se ha demostrado que detectan muchos carcinógenos en roedores y, presumiblemente, en humanos. En consecuencia, los ensayos de toxicidad genética se utilizan para predecir la carcinogenicidad potencial de los agentes.

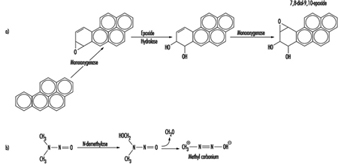

Un desarrollo conceptual y práctico importante en el campo de la toxicología genética fue el reconocimiento de que muchos carcinógenos fueron modificados por enzimas dentro del cuerpo, creando formas alteradas (metabolitos) que con frecuencia eran la forma carcinogénica y mutagénica final de la sustancia química original. Para duplicar este metabolismo en una placa de Petri, Heinrich Malling demostró que la inclusión de una preparación de hígado de roedor contenía muchas de las enzimas necesarias para realizar esta conversión o activación metabólica. Por lo tanto, muchos ensayos de toxicidad genética realizados en placas o tubos (in vitro) emplean la adición de preparaciones enzimáticas similares. Las preparaciones simples se denominan mezcla S9 y las preparaciones purificadas se denominan microsomas. Algunas células bacterianas y de mamíferos ahora han sido modificadas genéticamente para contener algunos de los genes de roedores o humanos que producen estas enzimas, lo que reduce la necesidad de agregar una mezcla S9 o microsomas.

Ensayos y técnicas de toxicología genética

Los principales sistemas bacterianos utilizados para la detección de toxicidad genética son el ensayo de mutagenicidad de Salmonella (Ames) y, en mucha menor medida, la cepa WP2 de Escherichia coli. Los estudios realizados a mediados de la década de 1980 indicaron que el uso de solo dos cepas del sistema de Salmonella (TA98 y TA100) fue suficiente para detectar aproximadamente el 90% de los mutágenos de Salmonella conocidos. Por lo tanto, estas dos cepas se utilizan para la mayoría de los fines de detección; sin embargo, varias otras cepas están disponibles para pruebas más extensas.

Estos ensayos se realizan de diversas formas, pero dos procedimientos generales son los ensayos de incorporación en placa y de suspensión líquida. En el ensayo de incorporación en placa, las células, la sustancia problema y (si se desea) el S9 se agregan en un agar licuado y se vierten sobre la superficie de una placa de Petri de agar. El agar superior se endurece en unos pocos minutos y las placas se incuban durante dos o tres días, después de lo cual las células mutantes han crecido para formar grupos de células detectables visualmente llamados colonias, que luego se cuentan. El medio de agar contiene agentes selectivos o está compuesto de ingredientes tales que solo crecerán las células recién mutadas. El ensayo de incubación líquida es similar, excepto que las células, el agente de prueba y S9 se incuban juntos en un líquido que no contiene agar licuado, y luego las células se lavan para eliminar el agente de prueba y S9 y se siembran en el agar.

Las mutaciones en células de mamífero cultivadas se detectan principalmente en uno de dos genes: hprt y tk. De manera similar a los ensayos bacterianos, las líneas celulares de mamíferos (desarrolladas a partir de células humanas o de roedores) se exponen al agente de prueba en placas o tubos de cultivo de plástico y luego se siembran en placas de cultivo que contienen un medio con un agente selectivo que permite que solo crezcan células mutantes. . Los ensayos utilizados para este propósito incluyen el CHO/HPRT, el TK6 y el linfoma de ratón L5178Y/TK+/- ensayos También se utilizan otras líneas celulares que contienen diversas mutaciones de reparación del ADN, así como algunos genes humanos implicados en el metabolismo. Estos sistemas permiten la recuperación de mutaciones dentro del gen (mutación del gen) así como mutaciones que involucran regiones del cromosoma que flanquean al gen (mutación cromosómica). Sin embargo, este último tipo de mutación es recuperada en mucha mayor medida por la tk sistemas de genes que por el hprt sistemas de genes debido a la ubicación de la tk .

Similar al ensayo de incubación líquida para mutagenicidad bacteriana, los ensayos de mutagenicidad en células de mamíferos generalmente implican la exposición de las células en placas o tubos de cultivo en presencia del agente de prueba y S9 durante varias horas. Luego, las células se lavan, se cultivan durante varios días más para permitir que los productos genéticos normales (de tipo salvaje) se degraden y los productos genéticos recién mutantes se expresen y acumulen, y luego se siembran en un medio que contiene un agente selectivo que permite sólo las células mutantes para crecer. Al igual que los ensayos bacterianos, las células mutantes crecen en colonias detectables visualmente que luego se cuentan.

La mutación cromosómica se identifica principalmente mediante ensayos citogenéticos, que implican la exposición de roedores y/o células humanas o de roedores en placas de cultivo a un producto químico de prueba, lo que permite que ocurran una o más divisiones celulares, la tinción de los cromosomas y luego el examen visual de los cromosomas a través de un microscopio. para detectar alteraciones en la estructura o número de cromosomas. Aunque se puede examinar una variedad de criterios de valoración, los dos que actualmente aceptan las agencias reguladoras como los más significativos son las aberraciones cromosómicas y una subcategoría llamada micronúcleos.

Se requiere una capacitación y experiencia considerables para evaluar la presencia de aberraciones cromosómicas en las células, lo que hace que este sea un procedimiento costoso en términos de tiempo y dinero. Por el contrario, los micronúcleos requieren poco entrenamiento y su detección puede automatizarse. Los micronúcleos aparecen como pequeños puntos dentro de la célula que son distintos del núcleo, que contiene los cromosomas. Los micronúcleos resultan de la rotura cromosómica o de la aneuploidía. Debido a la facilidad para calificar micronúcleos en comparación con las aberraciones cromosómicas, y debido a que estudios recientes indican que los agentes que inducen aberraciones cromosómicas en la médula ósea de ratones vivos generalmente inducen micronúcleos en este tejido, los micronúcleos ahora se miden comúnmente como una indicación de la capacidad de un agente para inducir la mutación cromosómica.

Aunque los ensayos de células germinales se usan con mucha menos frecuencia que los otros ensayos descritos anteriormente, son indispensables para determinar si un agente representa un riesgo para las células germinales, cuyas mutaciones pueden tener efectos en la salud de las generaciones futuras. Los ensayos de células germinales que se usan con más frecuencia son en ratones e involucran sistemas que detectan (1) translocaciones hereditarias (intercambios) entre cromosomas (ensayo de translocación heredable), (2) mutaciones genéticas o cromosómicas que involucran genes específicos (locus visible o bioquímico específico). ensayos), y (3) mutaciones que afectan la viabilidad (ensayo letal dominante). Al igual que con los ensayos de células somáticas, la suposición de trabajo con los ensayos de células germinales es que se presume que los agentes positivos en estos ensayos son mutágenos potenciales de células germinales humanas.

Estado actual y perspectivas futuras

Estudios recientes han indicado que solo se necesitaban tres piezas de información para detectar aproximadamente el 90% de un conjunto de 41 carcinógenos de roedores (es decir, presuntos carcinógenos humanos y mutágenos de células somáticas). Estos incluían (1) el conocimiento de la estructura química del agente, especialmente si contiene restos electrofílicos (ver la sección sobre relaciones estructura-actividad); (2) datos de mutagenicidad de Salmonella; y (3) datos de un ensayo de toxicidad crónica de 90 días en roedores (ratones y ratas). De hecho, esencialmente todos los carcinógenos humanos declarados por la IARC son detectables como mutágenos utilizando solo el ensayo de Salmonella y el ensayo de micronúcleo de médula ósea de ratón. El uso de estos ensayos de mutagenicidad para detectar carcinógenos humanos potenciales está respaldado por el hallazgo de que la mayoría de los carcinógenos humanos son carcinógenos tanto en ratas como en ratones (carcinógenos transespecies) y que la mayoría de los carcinógenos transespecies son mutagénicos en Salmonella y/o inducen micronúcleos. en médula ósea de ratón.

Con los avances en la tecnología del ADN, el proyecto del genoma humano y una mejor comprensión del papel de la mutación en el cáncer, se están desarrollando nuevos ensayos de genotoxicidad que probablemente se incorporarán a los procedimientos de detección estándar. Entre estos se encuentran el uso de células transgénicas y roedores. Los sistemas transgénicos son aquellos en los que se ha introducido un gen de otra especie en una célula u organismo. Por ejemplo, ahora se encuentran en uso experimental ratones transgénicos que permiten la detección de mutaciones en cualquier órgano o tejido del animal, basándose en la introducción de un gen bacteriano en el ratón. Las células bacterianas, como Salmonella, y las células de mamíferos (incluidas las líneas celulares humanas) ahora están disponibles y contienen genes implicados en el metabolismo de agentes cancerígenos/mutagénicos, como los genes P450. Análisis molecular de las mutaciones reales inducidas en el gen trans dentro de roedores transgénicos, o dentro de genes nativos como hprt, o los genes objetivo dentro de Salmonella ahora se pueden realizar, de modo que se pueda determinar la naturaleza exacta de las mutaciones inducidas por los productos químicos, proporcionando información sobre el mecanismo de acción del producto químico y permitiendo comparaciones con mutaciones en humanos presuntamente expuestos al agente. .

Los avances moleculares en citogenética ahora permiten una evaluación más detallada de las mutaciones cromosómicas. Estos incluyen el uso de sondas (pequeños fragmentos de ADN) que se adhieren (hibridan) a genes específicos. Los reordenamientos de genes en el cromosoma pueden revelarse luego por la ubicación alterada de las sondas, que son fluorescentes y se visualizan fácilmente como sectores coloreados en los cromosomas. El ensayo de electroforesis en gel unicelular para rotura de ADN (comúnmente llamado ensayo “cometa”) permite la detección de roturas de ADN dentro de células individuales y puede convertirse en una herramienta extremadamente útil en combinación con técnicas citogenéticas para detectar daño cromosómico.

Después de muchos años de uso y la generación de una gran base de datos desarrollada sistemáticamente, la evaluación de la toxicidad genética ahora se puede realizar con solo unos pocos ensayos a un costo relativamente pequeño en un período corto de tiempo (unas pocas semanas). Los datos producidos se pueden utilizar para predecir la capacidad de un agente para ser un roedor y, presumiblemente, carcinógeno humano/mutágeno de células somáticas. Tal capacidad hace posible limitar la introducción en el medio ambiente de agentes mutagénicos y cancerígenos y desarrollar agentes no mutagénicos alternativos. Los estudios futuros deberían conducir a métodos aún mejores con mayor predictibilidad que los ensayos actuales.

Biomarcadores

La palabra biomarcador es la abreviatura de marcador biológico, un término que se refiere a un evento medible que ocurre en un sistema biológico, como el cuerpo humano. Este evento se interpreta entonces como un reflejo, o marcador, de un estado más general del organismo o de la esperanza de vida. En salud ocupacional, un biomarcador se usa generalmente como un indicador del estado de salud o riesgo de enfermedad.

Los biomarcadores se utilizan para estudios in vitro e in vivo que pueden incluir seres humanos. Por lo general, se identifican tres tipos específicos de marcadores biológicos. Aunque algunos biomarcadores pueden ser difíciles de clasificar, por lo general se dividen en biomarcadores de exposición, biomarcadores de efecto o biomarcadores de susceptibilidad (ver tabla 1).

Tabla 1. Ejemplos de biomarcadores de exposición o biomarcadores de efecto que se utilizan en estudios toxicológicos en salud ocupacional

| Muestra | Measurement | Propósito |

| Biomarcadores de exposición | ||

| Tejido adiposo | dioxina | Exposición a dioxinas |

| Sangre | Lidera | Exposición al plomo |

| Hueso | Aluminio | exposición al aluminio |

| aliento exhalado | tolueno | Exposición al tolueno |

| Cabello | Mercurio | Exposición al metilmercurio |

| Serum | Benceno | Exposición al benceno |

| Orina | Fenol | Exposición al benceno |

| Biomarcadores de efecto | ||

| Sangre | Carboxihemoglobina | Exposición al monóxido de carbono |

| las células rojas de la sangre | Zinc-protoporfirina | Exposición al plomo |

| Serum | Colinesterasa | Exposición a organofosforados |

| Orina | Microglobulinas | Exposición nefrotóxica |

| Los glóbulos blancos | aductos de ADN | Exposición a mutágenos |

Dado un grado aceptable de validez, los biomarcadores pueden emplearse para varios propósitos. De forma individual, un biomarcador se puede usar para respaldar o refutar un diagnóstico de un tipo particular de envenenamiento u otro efecto adverso inducido químicamente. En un sujeto sano, un biomarcador también puede reflejar la hipersusceptibilidad individual a exposiciones químicas específicas y, por lo tanto, puede servir como base para la predicción del riesgo y el asesoramiento. En grupos de trabajadores expuestos, se pueden aplicar algunos biomarcadores de exposición para evaluar el grado de cumplimiento de las normas de reducción de la contaminación o la eficacia de los esfuerzos preventivos en general.

Biomarcadores de exposición

Un biomarcador de exposición puede ser un compuesto exógeno (o un metabolito) dentro del cuerpo, un producto interactivo entre el compuesto (o metabolito) y un componente endógeno u otro evento relacionado con la exposición. Más comúnmente, los biomarcadores de exposición a compuestos estables, como metales, comprenden mediciones de las concentraciones de metales en muestras apropiadas, como sangre, suero u orina. Con productos químicos volátiles, se puede evaluar su concentración en el aliento exhalado (después de la inhalación de aire libre de contaminación). Si el compuesto se metaboliza en el cuerpo, se pueden elegir uno o más metabolitos como biomarcador de la exposición; los metabolitos a menudo se determinan en muestras de orina.

Los métodos modernos de análisis pueden permitir la separación de isómeros o congéneres de compuestos orgánicos y la determinación de la especiación de compuestos metálicos o proporciones isotópicas de ciertos elementos. Los análisis sofisticados permiten la determinación de cambios en la estructura del ADN u otras macromoléculas causados por la unión con químicos reactivos. Estas técnicas avanzadas sin duda ganarán una importancia considerable para las aplicaciones en estudios de biomarcadores, y es probable que los límites de detección más bajos y una mejor validez analítica hagan que estos biomarcadores sean aún más útiles.

Se han producido desarrollos particularmente prometedores con biomarcadores de exposición a sustancias químicas mutagénicas. Estos compuestos son reactivos y pueden formar aductos con macromoléculas, como proteínas o ADN. Los aductos de ADN se pueden detectar en los glóbulos blancos o en las biopsias de tejido, y se pueden excretar fragmentos de ADN específicos en la orina. Por ejemplo, la exposición al óxido de etileno da como resultado reacciones con bases de ADN y, después de la escisión de la base dañada, la N-7-(2-hidroxietil)guanina se eliminará en la orina. Algunos aductos pueden no referirse directamente a una exposición en particular. Por ejemplo, la 8-hidroxi-2´-desoxiguanosina refleja el daño oxidativo del ADN, y esta reacción puede desencadenarse por varios compuestos químicos, la mayoría de los cuales también inducen la peroxidación lipídica.

Otras macromoléculas también pueden cambiar por formación de aductos u oxidación. De especial interés, tales compuestos reactivos pueden generar aductos de hemoglobina que pueden determinarse como biomarcadores de exposición a los compuestos. La ventaja es que se pueden obtener grandes cantidades de hemoglobina de una muestra de sangre y, dada la vida útil de cuatro meses de los glóbulos rojos, los aductos formados con los aminoácidos de la proteína indicarán la exposición total durante este período.

Los aductos pueden determinarse mediante técnicas sensibles, como la cromatografía de lípidos de alta resolución, y también están disponibles algunos métodos inmunológicos. En general, los métodos analíticos son nuevos, costosos y necesitan mayor desarrollo y validación. Se puede obtener una mejor sensibilidad utilizando el 32P ensayo posterior al etiquetado, que es una indicación no específica de que se ha producido daño en el ADN. Todas estas técnicas son potencialmente útiles para el control biológico y se han aplicado en un número creciente de estudios. Sin embargo, se necesitan métodos analíticos más simples y sensibles. Dada la especificidad limitada de algunos métodos a exposiciones de bajo nivel, el tabaquismo u otros factores pueden tener un impacto significativo en los resultados de la medición, lo que provoca dificultades en la interpretación.

La exposición a compuestos mutagénicos, oa compuestos que se metabolizan en mutágenos, también puede determinarse evaluando la mutagenicidad de la orina de un individuo expuesto. La muestra de orina se incuba con una cepa de bacterias en la que se expresa una mutación puntual específica de una manera que se puede medir fácilmente. Si las sustancias químicas mutagénicas están presentes en la muestra de orina, se producirá una mayor tasa de mutaciones en las bacterias.

Los biomarcadores de exposición deben evaluarse con respecto a la variación temporal de la exposición y la relación con los diferentes compartimentos. Por lo tanto, los marcos de tiempo representados por el biomarcador, es decir, la medida en que la medición del biomarcador refleja exposiciones pasadas y/o carga corporal acumulada, deben determinarse a partir de datos toxicocinéticos para interpretar el resultado. En particular, se debe considerar el grado en que el biomarcador indica retención en órganos diana específicos. Aunque las muestras de sangre se utilizan a menudo para estudios de biomarcadores, la sangre periférica generalmente no se considera un compartimento como tal, aunque actúa como medio de transporte entre compartimentos. El grado en que la concentración en la sangre refleja los niveles en diferentes órganos varía ampliamente entre los diferentes productos químicos y, por lo general, también depende de la duración de la exposición, así como del tiempo transcurrido desde la exposición.

A veces, este tipo de evidencia se usa para clasificar un biomarcador como un indicador de la dosis absorbida (total) o un indicador de la dosis efectiva (es decir, la cantidad que ha llegado al tejido objetivo). Por ejemplo, la exposición a un solvente particular puede evaluarse a partir de datos sobre la concentración real del solvente en la sangre en un momento particular después de la exposición. Esta medida reflejará la cantidad de disolvente que se ha absorbido en el cuerpo. Parte de la cantidad absorbida será exhalada debido a la presión de vapor del solvente. Mientras circula en la sangre, el solvente interactuará con varios componentes del cuerpo y eventualmente se verá sujeto a la descomposición por parte de las enzimas. El resultado de los procesos metabólicos se puede evaluar determinando los ácidos mercaptúricos específicos producidos por conjugación con glutatión. La excreción acumulada de ácidos mercaptúricos puede reflejar mejor la dosis efectiva que la concentración en sangre.

Los eventos de la vida, como la reproducción y la senescencia, pueden afectar la distribución de una sustancia química. La distribución de sustancias químicas dentro del cuerpo se ve significativamente afectada por el embarazo, y muchas sustancias químicas pueden atravesar la barrera placentaria, lo que provoca la exposición del feto. La lactancia puede provocar la excreción de sustancias químicas solubles en lípidos, lo que conduce a una disminución de la retención en la madre junto con una mayor absorción por parte del lactante. Durante la pérdida de peso o el desarrollo de la osteoporosis, se pueden liberar sustancias químicas almacenadas, lo que puede resultar en una exposición “endógena” renovada y prolongada de los órganos diana. Otros factores pueden afectar la absorción individual, el metabolismo, la retención y la distribución de compuestos químicos, y algunos biomarcadores de susceptibilidad están disponibles (ver más abajo).

Biomarcadores de efecto

Un marcador de efecto puede ser un componente endógeno, o una medida de la capacidad funcional, o algún otro indicador del estado o equilibrio del cuerpo o sistema de órganos, según se vea afectado por la exposición. Dichos marcadores de efecto son generalmente indicadores preclínicos de anomalías.

Estos biomarcadores pueden ser específicos o no específicos. Los biomarcadores específicos son útiles porque indican un efecto biológico de una exposición particular, proporcionando así evidencia que potencialmente puede usarse con fines preventivos. Los biomarcadores no específicos no apuntan a una causa individual del efecto, pero pueden reflejar el efecto total integrado debido a una exposición mixta. Por lo tanto, ambos tipos de biomarcadores pueden tener un uso considerable en salud ocupacional.

No existe una distinción clara entre biomarcadores de exposición y biomarcadores de efecto. Por ejemplo, podría decirse que la formación de aductos refleja un efecto en lugar de la exposición. Sin embargo, los biomarcadores de efectos suelen indicar cambios en las funciones de las células, los tejidos o el cuerpo en su totalidad. Algunos investigadores incluyen cambios importantes, como un aumento en el peso del hígado de los animales de laboratorio expuestos o una disminución del crecimiento en los niños, como biomarcadores del efecto. A los efectos de la salud ocupacional, los biomarcadores de efectos deben restringirse a aquellos que indican cambios bioquímicos subclínicos o reversibles, como la inhibición de enzimas. El biomarcador de efecto más utilizado es probablemente la inhibición de la colinesterasa provocada por ciertos insecticidas, es decir, los organofosforados y los carbamatos. En la mayoría de los casos, este efecto es completamente reversible y la inhibición de la enzima refleja la exposición total a este grupo particular de insecticidas.

Algunas exposiciones no dan como resultado la inhibición de la enzima, sino más bien un aumento de la actividad de una enzima. Este es el caso de varias enzimas que pertenecen a la familia P450 (ver “Determinantes genéticos de la respuesta tóxica”). Pueden ser inducidos por la exposición a ciertos solventes e hidrocarburos poliaromáticos (HAP). Dado que estas enzimas se expresan principalmente en tejidos de los que puede ser difícil obtener una biopsia, la actividad enzimática se determina indirectamente in vivo mediante la administración de un compuesto que es metabolizado por esa enzima en particular, y luego el producto de descomposición se mide en orina o plasma.