bambini categorie

27. Monitoraggio biologico (6)

27. Monitoraggio biologico

Editor del capitolo: Robert Lauwerys

Sommario

Tabelle e figure

Principi generali

Vito Foà e Lorenzo Alessio

Certificazione di qualità

D.Gompertz

Metalli e Composti Organometallici

P.Hoet e Robert Lauwerys

Solventi organici

Masayuki Ikeda

Sostanze chimiche genotossiche

Marja Sorsa

Pesticidi

Marco Maroni e Adalberto Ferioli

tavoli

Fare clic su un collegamento sottostante per visualizzare la tabella nel contesto dell'articolo.

1. ACGIH, DFG e altri valori limite per i metalli

2. Esempi di monitoraggio chimico e biologico

3. Monitoraggio biologico per solventi organici

4. Genotossicità delle sostanze chimiche valutata da IARC

5. Biomarcatori e alcuni campioni di cellule/tessuti e genotossicità

6. Agenti cancerogeni per l'uomo, esposizione professionale e endpoint citogenetici

8. Esposizione da produzione e uso di pesticidi

9. Tossicità OP acuta a diversi livelli di inibizione ACHE

10 Variazioni di ACHE e PCHE e condizioni di salute selezionate

11 Attività della colinesterasi di persone sane non esposte

12 Alchilfosfati urinari e pesticidi OP

13 Misurazioni di alchilfosfati urinari e OP

14 Metaboliti carbammati urinari

15 Metaboliti urinari del ditiocarbammato

16 Indici proposti per il monitoraggio biologico dei pesticidi

17 Valori limite biologici raccomandati (a partire dal 1996)

Cifre

Punta su una miniatura per vedere la didascalia della figura, fai clic per vedere la figura nel contesto dell'articolo.

28. Epidemiologia e statistica (12)

28. Epidemiologia e statistica

Redattori di capitoli: Franco Merletti, Colin L. Soskolne e Paolo Vineis

Sommario

Tabelle e figure

Metodo epidemiologico applicato alla salute e sicurezza sul lavoro

Franco Merletti, Colin L. Soskolne e Paolo Vineis

Valutazione dell'esposizione

Sig. Gerald Ott

Sommario Misure di esposizione durante la vita lavorativa

Colin L. Soskolne

Misurazione degli effetti delle esposizioni

Shelia Hoar Zahm

Caso di studio: Misure

Franco Merletti, Colin L. Soskolne e Paola Vineis

Opzioni nella progettazione dello studio

Sven Hernberg

Problemi di validità nella progettazione dello studio

Annie J.Sasco

Impatto dell'errore di misurazione casuale

Paolo Vineis e Colin L. Soskolne

Metodi statistici

Annibale Biggeri e Mario Braga

Valutazione della causalità ed etica nella ricerca epidemiologica

Paolo Vineis

Casi di studio che illustrano questioni metodologiche nella sorveglianza delle malattie professionali

Jung-Der Wang

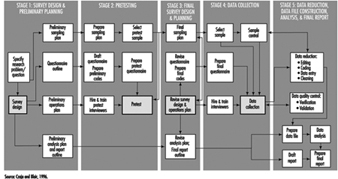

Questionari nella ricerca epidemiologica

Steven D. Stellman e Colin L. Soskolne

Prospettiva storica dell'amianto

Lorenzo Garfinkel

tavoli

Fare clic su un collegamento sottostante per visualizzare la tabella nel contesto dell'articolo.

1. Cinque misure riassuntive selezionate dell'esposizione durante la vita lavorativa

2. Misure di insorgenza della malattia

3. Misure di associazione per uno studio di coorte

4. Misure di associazione per studi caso-controllo

5. Layout generale della tabella delle frequenze per i dati di coorte

6. Esempio di layout dei dati caso-controllo

7. Disporre i dati caso-controllo: un controllo per caso

8. Ipotetica coorte di 1950 individui a T2

9. Indici di tendenza centrale e dispersione

10 Un esperimento binomiale e probabilità

11 Possibili esiti di un esperimento binomiale

12 Distribuzione binomiale, 15 successi/30 prove

13 Distribuzione binomiale, p = 0.25; 30 prove

14 Errore e alimentazione di tipo II; x = 12, n = 30, a = 0.05

15 Errore e alimentazione di tipo II; x = 12, n = 40, a = 0.05

16 632 lavoratori esposti all'amianto da 20 anni o più

17 O/E numero di morti tra 632 lavoratori dell'amianto

Cifre

Punta su una miniatura per vedere la didascalia della figura, fai clic per vedere la figura nel contesto dell'articolo.

29. Ergonomia (27)

29. Ergonomia

Redattori di capitoli: Wolfgang Laurig e Joachim Vedder

Sommario

Tabelle e figure

Panoramica

Wolfgang Laurig e Joachim Vedder

Obiettivi, principi e metodi

La natura e gli scopi dell'ergonomia

William T. Singleton

Analisi delle attività, dei compiti e dei sistemi di lavoro

Veronica De Keyser

Ergonomia e standardizzazione

Friedhelm Nachreiner

Liste di controllo

Pranab Kumar Nag

Aspetti fisici e fisiologici

Antropometria

Melchiorre Masali

Lavoro muscolare

Juhani Smolander e Veikko Louhevaara

Posture sul lavoro

Ilkka Kuorinka

Biomeccanica

Franco Darby

Fatica Generale

Etienne Grandjean

Fatica e recupero

Rolf Helbig e Walter Rohmert

Aspetti psicologici

Carico di lavoro mentale

Winfried Hacker

vigilanza

Herbert Heuer

Affaticamento mentale

Pietro Richter

Aspetti organizzativi del lavoro

Organizzazione del lavoro

Eberhard Ulich e Gudela Grote

Privazione del sonno

Kazutaka Kogi

Progettazione di sistemi di lavoro

workstation

Roland Kadefors

Strumenti

TM Fraser

Comandi, indicatori e pannelli

Karl SE Kroemer

Elaborazione e progettazione delle informazioni

Andries F. Sanders

Progettare per tutti

Progettare per gruppi specifici

Scherzo H. Grady-van den Nieuwboer

Caso di studio: la classificazione internazionale della limitazione funzionale nelle persone

Differenze culturali

Hushang Shahnavaz

Lavoratori anziani

Antoine Laville e Serge Volkoff

Lavoratori con Bisogni Speciali

Scherzo H. Grady-van den Nieuwboer

Diversità e importanza dell'ergonomia: due esempi

Progettazione di sistemi nella produzione di diamanti

Issacar Gilad

Ignorando i principi di progettazione ergonomica: Chernobyl

Vladimir M. Munipov

tavoli

Fare clic su un collegamento sottostante per visualizzare la tabella nel contesto dell'articolo.

1. Elenco dei nuclei antropometrici di base

2. Fatica e recupero dipendono dai livelli di attività

3. Regole di combinazione degli effetti di due fattori di stress sulla deformazione

4. Differenza tra diverse conseguenze negative della tensione mentale

5. Principi orientati al lavoro per la strutturazione della produzione

6. Partecipazione al contesto organizzativo

7. Partecipazione degli utenti al processo tecnologico

8. Orario di lavoro irregolare e privazione del sonno

9. Aspetti dell'anticipo, dell'ancora e del sonno ritardato

10 Controlla i movimenti e gli effetti attesi

11 Relazioni controllo-effetto dei comandi manuali comuni

12 Regole per la disposizione dei controlli

13 Linee guida per le etichette

Cifre

Punta su una miniatura per vedere la didascalia della figura, fai clic per vedere la figura nel contesto dell'articolo.

30. Igiene del lavoro (6)

30. Igiene del lavoro

Editor del capitolo: Robert F.Herrick

Sommario

Tabelle e figure

Obiettivi, definizioni e informazioni generali

Berenice I. Ferrari Goelzer

Riconoscimento dei pericoli

Linnea Lillienberg

Valutazione dell'ambiente di lavoro

Lori A.Todd

Igiene del lavoro: controllo delle esposizioni attraverso l'intervento

James Stewart

La base biologica per la valutazione dell'esposizione

Dick Heederik

Limiti di esposizione professionale

Dennis J. Paustenbach

tavoli

1. Rischi chimici; agenti biologici e fisici

2. Limiti di esposizione professionale (OEL) - vari paesi

Cifre

31. Protezione personale (7)

31. Protezione personale

Editor del capitolo: Robert F.Herrick

Sommario

Tabelle e figure

Panoramica e filosofia della protezione personale

Robert F.Herrick

Protettori per occhi e viso

Kikuzi Kimura

Protezione del piede e della gamba

Toohiko Miura

Protezione della testa

Isabelle Balty e Alain Mayer

Protezione dell'udito

John R. Franchi e Elliott H. Berger

Abbigliamento protettivo

S. Zack Mansdorf

Protezione respiratoria

Thomas J. Nelson

tavoli

Fare clic su un collegamento sottostante per visualizzare la tabella nel contesto dell'articolo.

1. Requisiti di trasmittanza (ISO 4850-1979)

2. Bilance di protezione - saldatura a gas e saldobrasatura

3. Scale di protezione - taglio dell'ossigeno

4. Scale di protezione - taglio ad arco plasma

5. Scale di protezione - saldatura ad arco elettrico o scriccatura

6. Scale di protezione - saldatura ad arco diretto al plasma

7. Elmetto di sicurezza: norma ISO 3873-1977

8. Classificazione di riduzione del rumore di una protezione acustica

9. Calcolo della riduzione del rumore ponderata A

10 Esempi di categorie di rischio dermico

11 Requisiti di prestazione fisica, chimica e biologica

12 Pericoli materiali associati a particolari attività

13 Fattori di protezione assegnati da ANSI Z88 2 (1992)

Cifre

Punta su una miniatura per vedere la didascalia della figura, fai clic per vedere la figura nel contesto dell'articolo.

32. Sistemi di registrazione e sorveglianza (9)

32. Sistemi di registrazione e sorveglianza

Editor del capitolo: Steven D. Stellmann

Sommario

Tabelle e figure

Sistemi di sorveglianza e segnalazione delle malattie professionali

Steven B. Markowitz

Sorveglianza sui rischi professionali

David H. Wegman e Steven D. Stellman

Sorveglianza nei paesi in via di sviluppo

David Koh e Kee-Seng Chia

Sviluppo e applicazione di un sistema di classificazione degli infortuni e delle malattie professionali

Elyce Biddle

Analisi del rischio di lesioni e malattie non mortali sul posto di lavoro

John W. Ruser

Caso di studio: protezione dei lavoratori e statistiche sugli infortuni e le malattie professionali - HVBG, Germania

Martin Butz e Burkhard Hoffmann

Caso di studio: Wismut - Un'esposizione all'uranio rivisitata

Heinz Otten e Horst Schulz

Strategie e tecniche di misurazione per la valutazione dell'esposizione professionale in epidemiologia

Frank Bochmann e Helmut Blomé

Caso di studio: Indagini sulla salute sul lavoro in Cina

tavoli

Fare clic su un collegamento sottostante per visualizzare la tabella nel contesto dell'articolo.

1. Angiosarcoma del fegato - registro mondiale

2. Malattia professionale, Stati Uniti, 1986 contro 1992

3. Morti negli Stati Uniti per pneumoconiosi e mesotelioma pleurico

4. Esempio di elenco delle malattie professionali soggette a denuncia

5. Struttura del codice di segnalazione di malattie e infortuni, Stati Uniti

6. Infortuni e malattie professionali non mortali, Stati Uniti 1993

7. Rischio di infortuni e malattie professionali

8. Rischio relativo per condizioni di movimento ripetitivo

9. Infortuni sul lavoro, Germania, 1981-93

10 Rettificatrici in incidenti di lavorazione dei metalli, Germania, 1984-93

11 Malattia professionale, Germania, 1980-93

12 Malattie infettive, Germania, 1980-93

13 Esposizione alle radiazioni nelle miniere di Wismut

14 Malattie professionali nelle miniere di uranio di Wismut 1952-90

Cifre

Punta su una miniatura per vedere la didascalia della figura, fai clic per vedere la figura nel contesto dell'articolo.

33. Tossicologia (21)

33. Tossicologia

Redattore del capitolo: Ellen K. Silbergeld

Sommario

Tabelle e figure

Introduzione

Ellen K. Silbergeld, caporedattore

Principi generali di tossicologia

Definizioni e Concetti

Bo Holmberg, Johan Hogberg e Gunnar Johanson

Tossicocinetica

Dušan Djuric

Organo bersaglio ed effetti critici

Marek Jakubowski

Effetti dell'età, del sesso e di altri fattori

Spomenka Telisman

Determinanti genetici della risposta tossica

Daniel W. Nebert e Ross A. McKinnon

Meccanismi di tossicità

Introduzione e concetti

Philip G. Watanabe

Danno cellulare e morte cellulare

Benjamin F. Trump e Irene K. Berezesky

Tossicologia genetica

R. Rita Misra e Michael P. Waalkes

Immunotossicologia

Joseph G. Vos e Henk van Loveren

Tossicologia dell'organo bersaglio

Ellen K. Silbergeld

Metodi di test tossicologici

biomarkers

Filippo Grandjean

Valutazione della tossicità genetica

David M. De Marini e James Huff

Test di tossicità in vitro

Giovanna Zurlo

Relazioni struttura attività

Ellen K. Silbergeld

Tossicologia normativa

Tossicologia nel regolamento sulla salute e la sicurezza

Ellen K. Silbergeld

Principi di identificazione dei pericoli - L'approccio giapponese

Masayuki Ikeda

L'approccio degli Stati Uniti alla valutazione del rischio di sostanze tossiche per la riproduzione e agenti neurotossici

Ellen K. Silbergeld

Approcci all'identificazione dei pericoli - IARC

Harri Vainio e Julian Wilbourn

Appendice - Valutazioni complessive di cancerogenicità per l'uomo: Monografie IARC Volumi 1-69 (836)

Valutazione del rischio cancerogeno: altri approcci

Cees A. van der Heijden

tavoli

Fare clic su un collegamento sottostante per visualizzare la tabella nel contesto dell'articolo.

- Esempi di organi critici ed effetti critici

- Effetti fondamentali di possibili interazioni multiple di metalli

- Addotti dell'emoglobina nei lavoratori esposti ad anilina e acetanilide

- Malattie ereditarie, inclini al cancro e difetti nella riparazione del DNA

- Esempi di sostanze chimiche che presentano genotossicità nelle cellule umane

- Classificazione dei test per i marcatori immunitari

- Esempi di biomarcatori di esposizione

- Pro e contro dei metodi per identificare i rischi di cancro nell'uomo

- Confronto di sistemi in vitro per studi di epatotossicità

- Confronto tra SAR e dati dei test: analisi OCSE/NTP

- Regolamentazione delle sostanze chimiche per legge, Giappone

- Elementi di prova ai sensi della legge sul controllo delle sostanze chimiche, Giappone

- Sostanze chimiche e legge sul controllo delle sostanze chimiche

- Principali incidenti di neurotossicità selezionati

- Esempi di test specializzati per misurare la neurotossicità

- Endpoint in tossicologia riproduttiva

- Confronto di procedure di estrapolazione a basse dosi

- Modelli frequentemente citati nella caratterizzazione del rischio cancerogeno

Cifre

Punta su una miniatura per vedere la didascalia della figura, fai clic per vedere la figura nel contesto dell'articolo.

Fatica Generale

Questo articolo è tratto dalla terza edizione dell'Encyclopaedia of Occupational Health and Safety.

I due concetti di fatica e riposo sono familiari a tutti per esperienza personale. La parola "fatica" è usata per indicare condizioni molto diverse, tutte causano una riduzione della capacità di lavoro e della resistenza. L'uso molto vario del concetto di fatica ha portato ad una confusione quasi caotica ed è necessaria una precisazione delle idee correnti. Per molto tempo, la fisiologia ha distinto tra affaticamento muscolare e affaticamento generale. Il primo è un fenomeno doloroso acuto localizzato nei muscoli: la stanchezza generale è caratterizzata da un senso di diminuzione della disponibilità al lavoro. Questo articolo si occupa solo della stanchezza generale, che può anche essere chiamata "stanchezza psichica" o "stanchezza nervosa" e il resto che richiede.

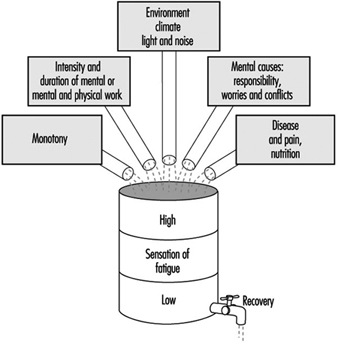

La stanchezza generale può essere dovuta a cause molto diverse, le più importanti delle quali sono mostrate nella figura 1. L'effetto è come se, durante il corso della giornata, tutte le varie sollecitazioni sperimentate si accumulassero all'interno dell'organismo, producendo gradualmente una sensazione di crescente fatica. Questa sensazione spinge alla decisione di interrompere il lavoro; il suo effetto è quello di un fisiologico preludio al sonno.

Figura 1. Rappresentazione schematica dell'effetto cumulativo delle cause quotidiane della fatica

La stanchezza è una sensazione salutare se ci si può sdraiare e riposare. Tuttavia, se si ignora questa sensazione e ci si costringe a continuare a lavorare, la sensazione di stanchezza aumenta fino a diventare angosciante e infine travolgente. Questa esperienza quotidiana dimostra chiaramente il significato biologico della fatica che svolge un ruolo nel sostentamento della vita, simile a quello svolto da altre sensazioni come, ad esempio, la sete, la fame, la paura, ecc.

Il riposo è rappresentato nella figura 1 come lo svuotamento di un barile. Il fenomeno del riposo può avvenire normalmente se l'organismo rimane indisturbato o se almeno una parte essenziale del corpo non è sottoposta a stress. Questo spiega il ruolo decisivo svolto nelle giornate lavorative da tutte le pause lavorative, dalla breve sosta durante il lavoro al sonno notturno. La similitudine del barile illustra quanto sia necessario per la vita normale raggiungere un certo equilibrio tra il carico totale sopportato dall'organismo e la somma delle possibilità di riposo.

Interpretazione neurofisiologica della fatica

I progressi della neurofisiologia degli ultimi decenni hanno notevolmente contribuito a una migliore comprensione dei fenomeni innescati dalla fatica nel sistema nervoso centrale.

Il fisiologo Hess fu il primo ad osservare che la stimolazione elettrica di alcune strutture diencefaliche, e più specialmente di alcune strutture del nucleo mediale del talamo, produceva gradualmente un effetto inibitore che si manifestava in un deterioramento della capacità di reazione e nella tendenza a dormire. Se la stimolazione si prolungava per un certo tempo, il rilassamento generale era seguito dalla sonnolenza e infine dal sonno. Successivamente è stato dimostrato che a partire da queste strutture un'inibizione attiva può estendersi alla corteccia cerebrale dove si concentrano tutti i fenomeni coscienti. Ciò si riflette non solo nel comportamento, ma anche nell'attività elettrica della corteccia cerebrale. Anche altri esperimenti sono riusciti ad avviare inibizioni da altre regioni sottocorticali.

La conclusione che si può trarre da tutti questi studi è che esistono strutture localizzate nel diencefalo e nel mesencefalo che rappresentano un efficace sistema di inibizione e che scatenano la fatica con tutti i fenomeni che l'accompagnano.

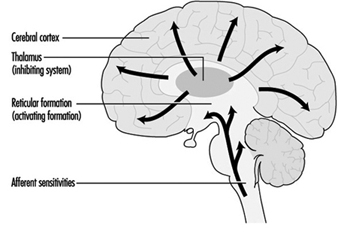

Inibizione e attivazione

Numerosi esperimenti condotti sull'animale e sull'uomo hanno mostrato che la disposizione generale di entrambi alla reazione dipende non solo da questo sistema di inibizione ma essenzialmente anche da un sistema funzionante in modo antagonistico, noto come sistema reticolare ascendente di attivazione. Sappiamo sperimentalmente che la formazione reticolare contiene strutture che controllano il grado di veglia, e di conseguenza le disposizioni generali a una reazione. Esistono collegamenti nervosi tra queste strutture e la corteccia cerebrale dove si esercitano gli influssi attivatori sulla coscienza. Inoltre, il sistema di attivazione riceve stimoli dagli organi sensoriali. Altre connessioni nervose trasmettono impulsi dalla corteccia cerebrale, l'area della percezione e del pensiero, al sistema di attivazione. Sulla base di questi concetti neurofisiologici si può stabilire che gli stimoli esterni, così come gli influssi originati nelle aree della coscienza, possono, passando attraverso il sistema attivante, stimolare una disposizione ad una reazione.

Inoltre, molte altre indagini permettono di concludere che la stimolazione del sistema attivante si propaga frequentemente anche dai centri vegetativi, e induce l'organismo ad orientarsi verso il dispendio di energie, verso il lavoro, la lotta, la fuga, ecc. (conversione ergotropica di gli organi interni). Viceversa, sembra che la stimolazione del sistema inibente nell'ambito del sistema nervoso vegetativo provochi nell'organismo una tendenza al riposo, alla ricostituzione delle sue riserve di energia, fenomeni di assimilazione (conversione trofotropica).

Dalla sintesi di tutte queste scoperte neurofisiologiche, si può stabilire la seguente concezione della fatica: lo stato e la sensazione di fatica sono condizionati dalla reazione funzionale della coscienza nella corteccia cerebrale, che è, a sua volta, governata da due sistemi reciprocamente antagonisti: il sistema inibente e il sistema attivante. Pertanto, la disposizione degli esseri umani al lavoro dipende in ogni momento dal grado di attivazione dei due sistemi: se il sistema inibitorio è dominante, l'organismo sarà in uno stato di affaticamento; quando il sistema di attivazione è dominante, mostrerà una maggiore predisposizione al lavoro.

Questa concezione psicofisiologica della fatica permette di comprendere alcuni dei suoi sintomi talvolta difficili da spiegare. Così, ad esempio, una sensazione di stanchezza può scomparire improvvisamente quando si verifica un evento esterno inaspettato o quando si sviluppa una tensione emotiva. È chiaro in entrambi questi casi che il sistema di attivazione è stato stimolato. Al contrario, se l'ambiente è monotono o il lavoro sembra noioso, il funzionamento del sistema attivante diminuisce e il sistema inibente diventa dominante. Questo spiega perché la fatica si manifesta in una situazione monotona senza che l'organismo sia sottoposto ad alcun carico di lavoro.

La figura 2 illustra schematicamente la nozione dei sistemi reciprocamente antagonisti di inibizione e attivazione.

Figura 2. Rappresentazione schematica del controllo della disposizione al lavoro mediante sistemi di inibizione e attivazione

Stanchezza clinica

È esperienza comune che la stanchezza pronunciata che si manifesta giorno dopo giorno produrrà gradualmente uno stato di stanchezza cronica. La sensazione di affaticamento si intensifica quindi e si manifesta non solo la sera dopo il lavoro ma già durante il giorno, a volte anche prima dell'inizio del lavoro. Un sentimento di malessere, spesso di natura emotiva, accompagna questo stato. Nelle persone affette da affaticamento si osservano spesso i seguenti sintomi: emotività psichica accentuata (comportamento antisociale, incompatibilità), tendenza alla depressione (ansia immotivata), mancanza di energia con perdita di iniziativa. Questi effetti psichici sono spesso accompagnati da un malessere non specifico e si manifestano con sintomi psicosomatici: mal di testa, vertigini, disturbi funzionali cardiaci e respiratori, perdita di appetito, disturbi digestivi, insonnia, ecc.

In considerazione della tendenza ai sintomi morbosi che accompagnano la stanchezza cronica, si può giustamente chiamarla stanchezza clinica. C'è una tendenza all'aumento dell'assenteismo, e in particolare a più assenze per brevi periodi. Ciò sembrerebbe essere causato sia dalla necessità di riposo sia dall'aumento della morbilità. Lo stato di affaticamento cronico si verifica in particolare tra le persone esposte a conflitti o difficoltà psichiche. A volte è molto difficile distinguere le cause esterne e interne. Infatti, è quasi impossibile distinguere causa ed effetto nella fatica clinica: un atteggiamento negativo nei confronti del lavoro, dei superiori o del posto di lavoro può essere la causa della fatica clinica tanto quanto il risultato.

La ricerca ha dimostrato che gli operatori di centralino e il personale di supervisione impiegati nei servizi di telecomunicazione hanno mostrato un aumento significativo dei sintomi fisiologici di affaticamento dopo il loro lavoro (tempo di reazione visiva, frequenza di fusione del flicker, test di destrezza). Indagini mediche hanno rivelato che in questi due gruppi di lavoratori vi era un aumento significativo degli stati nevrotici, dell'irritabilità, della difficoltà a dormire e del senso cronico di spossatezza, rispetto ad un gruppo simile di donne impiegate nei rami tecnici delle poste, telefoniche e servizi telegrafici. L'accumulo di sintomi non è sempre stato dovuto ad un atteggiamento negativo da parte delle donne che hanno influenzato il loro lavoro o le loro condizioni di lavoro.

Misure preventive

Non esiste una panacea per la fatica, ma si può fare molto per alleviare il problema prestando attenzione alle condizioni generali di lavoro e all'ambiente fisico sul posto di lavoro. Ad esempio, si può ottenere molto con la corretta organizzazione dell'orario di lavoro, prevedendo periodi di riposo adeguati e mense e servizi igienici adeguati; anche ai lavoratori dovrebbero essere concesse ferie retribuite adeguate. Lo studio ergonomico del posto di lavoro può anche aiutare nella riduzione della fatica, garantendo che sedili, tavoli e banchi da lavoro siano di dimensioni adeguate e che il flusso di lavoro sia organizzato correttamente. Inoltre, il controllo del rumore, l'aria condizionata, il riscaldamento, la ventilazione e l'illuminazione possono avere tutti un effetto benefico nel ritardare l'insorgere della fatica nei lavoratori.

La monotonia e la tensione possono anche essere alleviate da un uso controllato del colore e della decorazione dell'ambiente, intervalli di musica e talvolta pause per esercizi fisici per i lavoratori sedentari. Anche la formazione dei lavoratori e in particolare del personale di controllo e dirigenza svolge un ruolo importante.

Tossicologia dell'organo bersaglio

Lo studio e la caratterizzazione di sostanze chimiche e altri agenti per le proprietà tossiche viene spesso intrapreso sulla base di organi e sistemi di organi specifici. In questo capitolo, sono stati selezionati due bersagli per una discussione approfondita: il sistema immunitario e il gene. Questi esempi sono stati scelti per rappresentare un complesso sistema di organi bersaglio e un bersaglio molecolare all'interno delle cellule. Per una discussione più completa sulla tossicologia degli organi bersaglio, il lettore può fare riferimento a testi di tossicologia standard come Casarett e Doull e Hayes. Anche il Programma internazionale sulla sicurezza chimica (IPCS) ha pubblicato diversi documenti sui criteri sulla tossicologia degli organi bersaglio, per sistema di organi.

Gli studi di tossicologia sugli organi bersaglio sono di solito intrapresi sulla base di informazioni che indicano il potenziale di effetti tossici specifici di una sostanza, o da dati epidemiologici o da studi generali di tossicità acuta o cronica, o sulla base di preoccupazioni particolari per proteggere determinate funzioni di organi, come come riproduzione o sviluppo fetale. In alcuni casi, test specifici di tossicità per organi bersaglio sono espressamente richiesti dalle autorità statutarie, come i test di neurotossicità ai sensi della legge statunitense sui pesticidi (vedere "L'approccio degli Stati Uniti alla valutazione del rischio di sostanze tossiche per la riproduzione e agenti neurotossici" e i test di mutagenicità ai sensi del Japanese Chemical Chemical Legge sul controllo delle sostanze (vedi “Principi di identificazione dei pericoli: l'approccio giapponese”).

Come discusso in "Organo bersaglio ed effetti critici", l'identificazione di un organo critico si basa sul rilevamento dell'organo o del sistema di organi che per primo risponde negativamente o alle dosi o esposizioni più basse. Queste informazioni vengono quindi utilizzate per progettare indagini tossicologiche specifiche o test di tossicità più definiti progettati per suscitare indicazioni più sensibili di intossicazione nell'organo bersaglio. Gli studi di tossicologia degli organi bersaglio possono anche essere utilizzati per determinare i meccanismi di azione, di utilizzo nella valutazione del rischio (vedere "L'approccio degli Stati Uniti alla valutazione del rischio di sostanze tossiche per la riproduzione e agenti neurotossici").

Metodi di studi sulla tossicità dell'organo bersaglio

Gli organi bersaglio possono essere studiati mediante l'esposizione di organismi intatti e un'analisi dettagliata della funzione e dell'istopatologia nell'organo bersaglio, o mediante l'esposizione in vitro di cellule, sezioni di tessuto o organi interi mantenuti per periodi di breve o lungo termine in coltura (vedere "Meccanismi di tossicologia: introduzione e concetti”). In alcuni casi, i tessuti di soggetti umani possono anche essere disponibili per studi di tossicità sugli organi bersaglio, e questi possono fornire l'opportunità di convalidare ipotesi di estrapolazione tra specie. Tuttavia, va tenuto presente che tali studi non forniscono informazioni sulla tossicocinetica relativa.

In generale, gli studi sulla tossicità dell'organo bersaglio condividono le seguenti caratteristiche comuni: esame istopatologico dettagliato dell'organo bersaglio, compreso l'esame post mortem, il peso del tessuto e l'esame dei tessuti fissati; studi biochimici di percorsi critici nell'organo bersaglio, come importanti sistemi enzimatici; studi funzionali della capacità dell'organo e dei costituenti cellulari di svolgere le funzioni metaboliche e di altro tipo previste; e analisi dei biomarcatori dell'esposizione e degli effetti precoci nelle cellule degli organi bersaglio.

La conoscenza dettagliata della fisiologia degli organi bersaglio, della biochimica e della biologia molecolare può essere incorporata negli studi sugli organi bersaglio. Ad esempio, poiché la sintesi e la secrezione di proteine di piccolo peso molecolare è un aspetto importante della funzione renale, gli studi di nefrotossicità spesso prestano particolare attenzione a questi parametri (IPCS 1991). Poiché la comunicazione cellula-cellula è un processo fondamentale della funzione del sistema nervoso, gli studi sugli organi bersaglio nella neurotossicità possono includere misurazioni neurochimiche e biofisiche dettagliate della sintesi, dell'assorbimento, dell'immagazzinamento, del rilascio e del legame dei neurotrasmettitori, nonché misurazioni elettrofisiologiche dei cambiamenti nella membrana potenziale associato a questi eventi.

Viene posto un alto grado di enfasi sullo sviluppo di metodi in vitro per la tossicità degli organi bersaglio, per sostituire o ridurre l'uso di animali interi. Progressi sostanziali in questi metodi sono stati ottenuti per le sostanze tossiche per la riproduzione (Heindel e Chapin 1993).

In sintesi, gli studi di tossicità sugli organi bersaglio sono generalmente intrapresi come test di ordine superiore per determinare la tossicità. La selezione di specifici organi bersaglio per un'ulteriore valutazione dipende dai risultati dei test a livello di screening, come i test acuti o subcronici utilizzati dall'OCSE e dall'Unione Europea; alcuni organi bersaglio e sistemi di organi possono essere candidati a priori per indagini speciali a causa delle preoccupazioni per prevenire alcuni tipi di effetti avversi sulla salute.

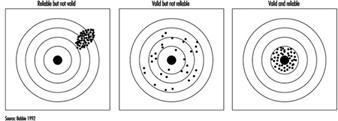

Problemi di validità nella progettazione dello studio

Il bisogno di validità

L'epidemiologia mira a fornire una comprensione dell'esperienza della malattia nelle popolazioni. In particolare, può essere utilizzato per ottenere informazioni sulle cause professionali della malattia. Questa conoscenza deriva da studi condotti su gruppi di persone che hanno una malattia confrontandoli con persone senza quella malattia. Un altro approccio consiste nell'esaminare quali malattie acquisiscono le persone che svolgono determinati lavori con particolari esposizioni e confrontare questi modelli di malattia con quelli di persone non esposte in modo simile. Questi studi forniscono stime del rischio di malattia per esposizioni specifiche. Affinché le informazioni di tali studi possano essere utilizzate per stabilire programmi di prevenzione, per il riconoscimento delle malattie professionali e affinché i lavoratori colpiti da esposizioni siano adeguatamente indennizzati, tali studi devono essere validi.

Validità può essere definita come la capacità di uno studio di riflettere il vero stato delle cose. Uno studio valido è quindi quello che misura correttamente l'associazione (positiva, negativa o assente) tra un'esposizione e una malattia. Descrive la direzione e l'entità di un vero rischio. Si distinguono due tipi di validità: validità interna ed esterna. La validità interna è la capacità di uno studio di riflettere ciò che è realmente accaduto tra i soggetti dello studio; la validità esterna riflette ciò che potrebbe accadere nella popolazione.

La validità si riferisce alla veridicità di una misurazione. La validità deve essere distinta dalla precisione della misurazione, che è funzione della dimensione dello studio e dell'efficienza del disegno dello studio.

Validità interna

Si dice che uno studio è internamente valido quando è privo di pregiudizi e quindi riflette veramente l'associazione tra esposizione e malattia che esiste tra i partecipanti allo studio. Un rischio di malattia osservato in associazione con un'esposizione può effettivamente derivare da un'associazione reale e quindi essere valido, ma può anche riflettere l'influenza di pregiudizi. Un pregiudizio darà un'immagine distorta della realtà.

Tre principali tipi di pregiudizi, chiamati anche errori sistematici, si distinguono solitamente:

- bias di selezione

- bias di informazione o di osservazione

- confusione

Saranno presentati brevemente di seguito, utilizzando esempi tratti dal contesto della salute sul lavoro.

Bias di selezione

Il bias di selezione si verificherà quando l'ingresso nello studio è influenzato dalla conoscenza dello stato di esposizione del potenziale partecipante allo studio. Questo problema si riscontra quindi solo quando la malattia è già in atto nel momento (prima) che la persona entri nello studio. Tipicamente, nel contesto epidemiologico, ciò avverrà in studi caso-controllo o in studi di coorte retrospettivi. Ciò significa che una persona avrà maggiori probabilità di essere considerata un caso se è noto che è stata esposta. Tre serie di circostanze possono portare a un tale evento, che dipenderà anche dalla gravità della malattia.

Bias di autoselezione

Ciò può verificarsi quando persone che sanno di essere state esposte in passato a prodotti noti o ritenuti dannosi e che sono convinte che la loro malattia sia il risultato dell'esposizione consulteranno un medico per sintomi che altre persone, non così esposte, potrebbero aver ignorato. Ciò è particolarmente probabile che accada per le malattie che hanno pochi sintomi evidenti. Un esempio può essere la perdita precoce della gravidanza o l'aborto spontaneo tra le infermiere che maneggiano farmaci usati per il trattamento del cancro. Queste donne sono più consapevoli della maggior parte della fisiologia riproduttiva e, essendo preoccupate della loro capacità di avere figli, possono essere più propense a riconoscere o etichettare come aborto spontaneo ciò che altre donne considererebbero solo un ritardo nell'inizio delle mestruazioni. Un altro esempio tratto da uno studio di coorte retrospettivo, citato da Rothman (1986), coinvolge uno studio del Centers for Disease Control sulla leucemia tra le truppe che erano state presenti durante un test atomico statunitense in Nevada. Delle truppe presenti sul luogo del test, il 76% è stato rintracciato e ha costituito la coorte. Di questi, l'82% è stato trovato dagli investigatori, ma un ulteriore 18% ha contattato gli stessi investigatori dopo aver sentito la pubblicità sullo studio. Quattro casi di leucemia erano presenti tra l'82% tracciato dal CDC e quattro casi erano presenti tra il 18% auto-riferito. Ciò suggerisce fortemente che la capacità degli investigatori di identificare le persone esposte era collegata al rischio di leucemia.

Pregiudizio diagnostico

Ciò si verificherà quando è più probabile che i medici diagnostichino una determinata malattia una volta che sanno a cosa è stato precedentemente esposto il paziente. Ad esempio, quando la maggior parte delle vernici era a base di piombo, un sintomo di malattia dei nervi periferici chiamato neurite periferica con paralisi era noto anche come "goccia del polso" dei pittori. Conoscere l'occupazione del paziente ha reso più facile diagnosticare la malattia anche nelle sue fasi iniziali, mentre l'identificazione dell'agente causale sarebbe molto più difficile nei partecipanti alla ricerca non noti per essere esposti professionalmente al piombo.

Bias derivante dal rifiuto di partecipare a uno studio

Quando a persone, sane o malate, viene chiesto di partecipare a uno studio, diversi fattori giocano un ruolo nel determinare se saranno d'accordo o meno. La disponibilità a rispondere a questionari più o meno lunghi, che a volte riguardano temi delicati, e ancor più a donare sangue o altri campioni biologici, può essere determinata dal grado di interesse personale della persona. Qualcuno che è a conoscenza di una potenziale esposizione passata potrebbe essere pronto a soddisfare questa richiesta nella speranza che aiuti a trovare la causa della malattia, mentre qualcuno che ritiene di non essere stato esposto a nulla di pericoloso o che non è interessato nel saperlo, potrà declinare l'invito a partecipare allo studio. Ciò può portare a una selezione di quelle persone che alla fine saranno i partecipanti allo studio rispetto a tutti coloro che avrebbero potuto esserlo.

Bias informativo

Questo è anche chiamato errore di osservazione e riguarda l'esito della malattia negli studi di follow-up e la valutazione dell'esposizione negli studi caso-controllo.

Valutazione del risultato differenziale in studi prospettici di follow-up (di coorte).

All'inizio dello studio vengono definiti due gruppi: un gruppo esposto e un gruppo non esposto. Se la ricerca dei casi differisce tra questi due gruppi, sorgeranno problemi di bias diagnostico. Ad esempio, si consideri una coorte di persone esposte a un rilascio accidentale di diossina in un dato settore. Per il gruppo altamente esposto viene istituito un sistema di follow-up attivo con visite mediche e monitoraggio biologico a intervalli regolari, mentre il resto della popolazione attiva riceve solo cure di routine. È molto probabile che nel gruppo sottoposto a stretta sorveglianza vengano identificate più malattie, il che porterebbe a una potenziale sovrastima del rischio.

Perdite differenziali in studi di coorte retrospettivi

Il meccanismo inverso a quello descritto nel paragrafo precedente può verificarsi negli studi di coorte retrospettivi. In questi studi, il modo usuale di procedere è quello di partire dalle schede di tutte le persone che sono state impiegate in un dato settore in passato, e valutare la malattia o la mortalità successiva all'occupazione. Sfortunatamente, in quasi tutti gli studi i file sono incompleti e il fatto che una persona sia scomparsa può essere correlato o allo stato di esposizione o allo stato di malattia o ad entrambi. Ad esempio, in un recente studio condotto nell'industria chimica su lavoratori esposti ad ammine aromatiche, sono stati riscontrati otto tumori in un gruppo di 777 lavoratori sottoposti a screening citologico per tumori urinari. Complessivamente, sono risultate mancanti solo 34 record, corrispondenti a una perdita del 4.4% dal file di valutazione dell'esposizione, ma per i casi di cancro alla vescica, i dati sull'esposizione mancavano per due casi su otto, ovvero il 25%. Ciò dimostra che i file delle persone che sono diventate casi avevano maggiori probabilità di perdersi rispetto ai file di altri lavoratori. Ciò può verificarsi a causa di cambi di lavoro più frequenti all'interno dell'azienda (che possono essere collegati agli effetti dell'esposizione), dimissioni, licenziamento o mera casualità.

Valutazione differenziale dell'esposizione negli studi caso-controllo

Negli studi caso-controllo, la malattia si è già manifestata all'inizio dello studio e si cercheranno informazioni sulle esposizioni passate. Il pregiudizio può derivare dall'atteggiamento dell'intervistatore o del partecipante allo studio nei confronti dell'indagine. Le informazioni vengono solitamente raccolte da intervistatori qualificati che possono o meno essere a conoscenza dell'ipotesi alla base della ricerca. Ad esempio, in uno studio caso-controllo basato sulla popolazione sul cancro alla vescica condotto in una regione altamente industrializzata, il personale dello studio potrebbe essere ben consapevole del fatto che alcune sostanze chimiche, come le ammine aromatiche, sono fattori di rischio per il cancro alla vescica. Se sanno anche chi ha sviluppato la malattia e chi no, è probabile che conducano interviste più approfondite con i partecipanti che hanno il cancro alla vescica rispetto ai controlli. Possono insistere su informazioni più dettagliate sulle occupazioni passate, ricercando sistematicamente l'esposizione alle ammine aromatiche, mentre per i controlli possono registrare le occupazioni in modo più sistematico. Il pregiudizio risultante è noto come Bias da sospetto di esposizione.

Anche i partecipanti stessi possono essere responsabili di tale pregiudizio. Questo è chiamato distorsioni della memoria per distinguerlo dal pregiudizio dell'intervistatore. Entrambi hanno il sospetto di esposizione come meccanismo per il bias. Le persone malate possono sospettare un'origine professionale della loro malattia e quindi cercheranno di ricordare il più accuratamente possibile tutti gli agenti pericolosi a cui potrebbero essere state esposte. Nel caso di manipolazione di prodotti indefiniti, possono essere inclini a ricordare i nomi di sostanze chimiche precise, in particolare se viene loro messo a disposizione un elenco di prodotti sospetti. Al contrario, è meno probabile che i controlli passino attraverso lo stesso processo di pensiero.

confondendo

Il confondimento esiste quando l'associazione osservata tra esposizione e malattia è in parte il risultato di una combinazione dell'effetto dell'esposizione in esame e di un altro fattore. Diciamo, ad esempio, che riscontriamo un aumento del rischio di cancro ai polmoni tra i saldatori. Siamo tentati di concludere subito che esiste un nesso causale tra l'esposizione ai fumi di saldatura e il cancro ai polmoni. Tuttavia, sappiamo anche che il fumo è di gran lunga il principale fattore di rischio per il cancro ai polmoni. Pertanto, se le informazioni sono disponibili, iniziamo a controllare lo stato di fumo dei saldatori e di altri partecipanti allo studio. Potremmo scoprire che i saldatori hanno maggiori probabilità di fumare rispetto ai non saldatori. In quella situazione, il fumo è noto per essere associato al cancro ai polmoni e, allo stesso tempo, nel nostro studio risulta che anche il fumo è associato all'essere un saldatore. In termini epidemiologici, ciò significa che il fumo, collegato sia al cancro del polmone che alla saldatura, sta confondendo l'associazione tra saldatura e cancro al polmone.

Modifica dell'interazione o dell'effetto

Contrariamente a tutte le questioni sopra elencate, vale a dire selezione, informazione e confusione, che sono pregiudizi, l'interazione non è un pregiudizio dovuto a problemi nella progettazione o nell'analisi dello studio, ma riflette la realtà e la sua complessità. Un esempio di questo fenomeno è il seguente: l'esposizione al radon è un fattore di rischio per il cancro ai polmoni, così come il fumo. Inoltre, il fumo e l'esposizione al radon hanno effetti diversi sul rischio di cancro ai polmoni a seconda che agiscano insieme o isolatamente. La maggior parte degli studi occupazionali su questo argomento sono stati condotti tra i minatori sotterranei ea volte hanno fornito risultati contrastanti. Nel complesso, sembrano esserci argomenti a favore di un'interazione tra fumo ed esposizione al radon nella produzione di cancro ai polmoni. Ciò significa che il rischio di cancro al polmone è aumentato dall'esposizione al radon, anche nei non fumatori, ma che l'entità dell'aumento del rischio dovuto al radon è molto maggiore tra i fumatori che tra i non fumatori. In termini epidemiologici, diciamo che l'effetto è moltiplicativo. Contrariamente al confondimento, descritto sopra, l'interazione deve essere attentamente analizzata e descritta nell'analisi piuttosto che semplicemente controllata, in quanto riflette ciò che sta accadendo a livello biologico e non è semplicemente una conseguenza di una cattiva progettazione dello studio. La sua spiegazione porta a un'interpretazione più valida dei risultati di uno studio.

Validità esterna

Questo problema può essere risolto solo dopo aver assicurato che la validità interna sia assicurata. Se siamo convinti che i risultati osservati nello studio riflettano associazioni che sono reali, possiamo chiederci se possiamo o meno estrapolare questi risultati alla popolazione più ampia da cui sono stati tratti gli stessi partecipanti allo studio, o anche ad altre popolazioni che sono identiche o almeno molto simile. La domanda più frequente è se i risultati ottenuti per gli uomini valgano anche per le donne. Per anni gli studi e, in particolare, le indagini epidemiologiche occupazionali sono state condotte esclusivamente tra gli uomini. Gli studi tra i chimici condotti negli anni '1960 e '1970 negli Stati Uniti, nel Regno Unito e in Svezia hanno tutti riscontrato un aumento del rischio di tumori specifici, vale a dire leucemia, linfoma e cancro al pancreas. Sulla base di ciò che sapevamo degli effetti dell'esposizione ai solventi e ad alcune altre sostanze chimiche, potevamo già dedurre all'epoca che il lavoro di laboratorio comportava anche un rischio cancerogeno per le donne. Questo infatti è stato dimostrato quando il primo studio tra le donne chimiche è stato finalmente pubblicato a metà degli anni '1980, che ha trovato risultati simili a quelli tra gli uomini. Vale la pena notare che altri tumori in eccesso riscontrati erano tumori della mammella e dell'ovaio, tradizionalmente considerati correlati solo a fattori endogeni o alla riproduzione, ma per i quali possono svolgere un ruolo fattori ambientali recentemente sospettati come i pesticidi. Molto più lavoro deve essere fatto sui determinanti occupazionali dei tumori femminili.

Strategie per uno studio valido

Uno studio perfettamente valido non può mai esistere, ma spetta al ricercatore cercare di evitare, o almeno minimizzare, il maggior numero possibile di pregiudizi. Questo spesso può essere fatto meglio nella fase di progettazione dello studio, ma può anche essere eseguito durante l'analisi.

Disegno di studio

La selezione e il pregiudizio informativo possono essere evitati solo attraverso l'attenta progettazione di uno studio epidemiologico e la scrupolosa attuazione di tutte le linee guida quotidiane che ne derivano, inclusa la meticolosa attenzione alla garanzia della qualità, per la conduzione dello studio in condizioni di campo. Il confondimento può essere affrontato sia in fase di progettazione che di analisi.

Selezione

I criteri per considerare un partecipante come un caso devono essere definiti in modo esplicito. Non si può, o almeno non si dovrebbe, tentare di studiare condizioni cliniche mal definite. Un modo per ridurre al minimo l'impatto che la conoscenza dell'esposizione può avere sulla valutazione della malattia consiste nell'includere solo i casi gravi che sarebbero stati diagnosticati indipendentemente da qualsiasi informazione sulla storia del paziente. Nel campo del cancro, gli studi saranno spesso limitati a casi con prova istologica della malattia per evitare l'inclusione di lesioni borderline. Ciò significherà anche che i gruppi oggetto di studio sono ben definiti. Ad esempio, è ben noto nell'epidemiologia del cancro che tumori di diversi tipi istologici all'interno di un dato organo possono avere fattori di rischio diversi. Se il numero di casi è sufficiente, è meglio separare l'adenocarcinoma del polmone dal carcinoma a cellule squamose del polmone. Qualunque siano i criteri finali per l'ingresso nello studio, dovrebbero sempre essere chiaramente definiti e descritti. Ad esempio, il codice esatto della malattia dovrebbe essere indicato utilizzando la Classificazione Internazionale delle Malattie (ICD) e anche, per il cancro, la Classificazione Internazionale delle Malattie-Oncologiche (ICD-O).

Una volta specificati i criteri, dovrebbero essere compiuti sforzi per massimizzare la partecipazione allo studio. La decisione di rifiutarsi di partecipare non è quasi mai presa a caso e quindi porta a parzialità. Gli studi dovrebbero prima di tutto essere presentati ai medici che stanno vedendo i pazienti. La loro approvazione è necessaria per avvicinare i pazienti, e quindi dovranno essere convinti a sostenere lo studio. Un argomento spesso convincente è che lo studio è nell'interesse della salute pubblica. Tuttavia, in questa fase è meglio non discutere l'esatta ipotesi che si sta valutando per evitare di influenzare indebitamente i clinici coinvolti. Ai medici non dovrebbe essere chiesto di assumere compiti supplementari; è più facile convincere il personale sanitario a prestare il proprio sostegno a uno studio se i ricercatori dello studio forniscono i mezzi per svolgere eventuali compiti aggiuntivi, oltre alle cure di routine, richiesti dallo studio. Gli intervistatori e gli estrattori di dati dovrebbero non essere consapevoli dello stato della malattia dei loro pazienti.

Analoga attenzione dovrebbe essere prestata alle informazioni fornite ai partecipanti. L'obiettivo dello studio deve essere descritto in termini ampi e neutri, ma deve anche essere convincente e persuasivo. È importante che le questioni di riservatezza e interesse per la salute pubblica siano pienamente comprese evitando il gergo medico. Nella maggior parte dei contesti, l'uso di incentivi finanziari o di altro tipo non è considerato appropriato, anche se dovrebbe essere previsto un compenso per qualsiasi spesa che un partecipante potrebbe sostenere. Ultimo, ma non meno importante, la popolazione generale dovrebbe essere sufficientemente scientificamente istruita per comprendere l'importanza di tale ricerca. Sia i benefici che i rischi della partecipazione devono essere spiegati a ciascun potenziale partecipante qualora sia necessario completare i questionari e/o fornire campioni biologici per la conservazione e/o l'analisi. Nessuna coercizione dovrebbe essere applicata per ottenere il consenso preventivo e pienamente informato. Laddove gli studi siano esclusivamente basati su documenti, deve essere assicurata l'approvazione preventiva delle agenzie responsabili di garantire la riservatezza di tali documenti. In questi casi, il consenso del singolo partecipante di solito può essere revocato. Sarà invece sufficiente l'approvazione dei funzionari sindacali e governativi. Le indagini epidemiologiche non rappresentano una minaccia per la vita privata di un individuo, ma un potenziale aiuto per migliorare la salute della popolazione. L'approvazione di un comitato di revisione istituzionale (o comitato di revisione etica) sarà necessaria prima della conduzione di uno studio, e gran parte di ciò che è stato affermato sopra sarà atteso da loro per la loro revisione.

Informazioni

Negli studi prospettici di follow-up, i mezzi per la valutazione della malattia o dello stato di mortalità devono essere identici per i partecipanti esposti e non esposti. In particolare, non dovrebbero essere utilizzate fonti diverse, come il solo controllo in un registro centrale di mortalità per i partecipanti non esposti e l'utilizzo di una sorveglianza attiva intensiva per i partecipanti esposti. Allo stesso modo, la causa della morte deve essere ottenuta in modi strettamente comparabili. Ciò significa che se si utilizza un sistema per ottenere l'accesso ai documenti ufficiali per la popolazione non esposta, che spesso è la popolazione generale, non si dovrebbe mai pensare di ottenere informazioni ancora più precise attraverso cartelle cliniche o interviste sui partecipanti stessi o sulle loro famiglie per il sottogruppo esposto.

Negli studi di coorte retrospettivi, dovrebbero essere compiuti sforzi per determinare quanto la popolazione in studio sia vicina alla popolazione di interesse. Si dovrebbe fare attenzione alle potenziali perdite differenziali nei gruppi esposti e non esposti utilizzando varie fonti riguardanti la composizione della popolazione. Ad esempio, può essere utile confrontare gli elenchi delle buste paga con gli elenchi di appartenenza ai sindacati o altri elenchi professionali. Le discrepanze devono essere riconciliate e il protocollo adottato per lo studio deve essere seguito scrupolosamente.

Negli studi caso-controllo, esistono altre opzioni per evitare pregiudizi. Intervistatori, personale dello studio e partecipanti allo studio non devono essere a conoscenza dell'ipotesi precisa oggetto di studio. Se non conoscono l'associazione in fase di test, è meno probabile che provino a fornire la risposta attesa. Tenere il personale dello studio all'oscuro dell'ipotesi di ricerca è infatti spesso poco pratico. L'intervistatore conoscerà quasi sempre le esposizioni di maggiore potenziale interesse, nonché chi è un caso e chi è un controllo. Dobbiamo quindi fare affidamento sulla loro onestà e anche sulla loro formazione in metodologia della ricerca di base, che dovrebbe far parte del loro bagaglio professionale; l'obiettività è il segno distintivo in tutte le fasi della scienza.

È più facile non informare i partecipanti allo studio dell'esatto oggetto della ricerca. Buone spiegazioni di base sulla necessità di raccogliere dati per avere una migliore comprensione della salute e della malattia sono generalmente sufficienti e soddisferanno le esigenze della revisione etica.

confondendo

Il confondimento è l'unico bias che può essere affrontato nella fase di progettazione dello studio o, a condizione che siano disponibili informazioni adeguate, nella fase di analisi. Se, per esempio, l'età è considerata un potenziale confondente dell'associazione di interesse perché l'età è associata al rischio di malattia (cioè, il cancro diventa più frequente in età avanzata) e anche con l'esposizione (le condizioni di esposizione variano con l'età o con fattori legati all'età come la qualifica, la posizione lavorativa e la durata dell'impiego), esistono diverse soluzioni. Il più semplice è limitare lo studio a una fascia di età specifica, ad esempio arruolare solo uomini caucasici di età compresa tra 40 e 50 anni. Ciò fornirà elementi per una semplice analisi, ma avrà anche l'inconveniente di limitare l'applicazione dei risultati a un singolo sesso età/gruppo razziale. Un'altra soluzione è la corrispondenza in base all'età. Ciò significa che per ogni caso è necessario un referente della stessa età. Questa è un'idea allettante, ma bisogna tenere presente la possibile difficoltà di soddisfare questo requisito con l'aumentare del numero di fattori di corrispondenza. Inoltre, una volta che un fattore è stato abbinato, diventa impossibile valutarne il ruolo nell'insorgenza della malattia. L'ultima soluzione è disporre di informazioni sufficienti sui potenziali fattori confondenti nel database dello studio al fine di controllarli nell'analisi. Questo può essere fatto sia attraverso una semplice analisi stratificata, sia con strumenti più sofisticati come l'analisi multivariata. Tuttavia, va ricordato che l'analisi non sarà mai in grado di compensare uno studio mal progettato o condotto.

Conclusione

La possibilità che si verifichino distorsioni nella ricerca epidemiologica è consolidata da tempo. Questo non era troppo preoccupante quando le associazioni studiate erano forti (come nel caso del fumo e del cancro ai polmoni) e quindi qualche imprecisione non causava un problema troppo grave. Tuttavia, ora che è giunto il momento di valutare i fattori di rischio più deboli, la necessità di strumenti migliori diventa fondamentale. Ciò include la necessità di eccellenti disegni di studio e la possibilità di combinare i vantaggi di vari disegni tradizionali come gli studi caso-controllo o di coorte con approcci più innovativi come gli studi caso-controllo nidificati all'interno di una coorte. Inoltre, l'uso di biomarcatori può fornire i mezzi per ottenere valutazioni più accurate delle esposizioni attuali e possibilmente passate, nonché per le prime fasi della malattia.

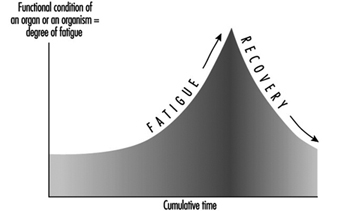

Fatica e recupero

La fatica e il recupero sono processi periodici in ogni organismo vivente. La fatica può essere descritta come uno stato caratterizzato da una sensazione di stanchezza combinata con una riduzione o una variazione indesiderata nell'esecuzione dell'attività (Rohmert 1973).

Non tutte le funzioni dell'organismo umano si affaticano a causa dell'uso. Anche quando dormiamo, per esempio, respiriamo e il nostro cuore batte senza sosta. Ovviamente le funzioni fondamentali della respirazione e dell'attività cardiaca sono possibili per tutta la vita senza fatica e senza pause di recupero.

D'altra parte, troviamo dopo un lavoro pesante abbastanza prolungato che c'è una riduzione della capacità, che noi chiamiamo fatica. Questo non si applica alla sola attività muscolare. Anche gli organi sensoriali oi centri nervosi si stancano. Tuttavia, lo scopo di ogni cellula è bilanciare la capacità persa dalla sua attività, un processo che chiamiamo recupero.

Stress, tensione, affaticamento e recupero

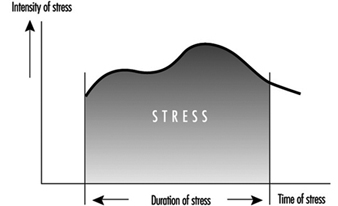

I concetti di affaticamento e recupero durante il lavoro umano sono strettamente correlati ai concetti ergonomici di stress e deformazione (Rohmert 1984) (figura 1).

Figura 1. Stress, deformazione e affaticamento

Per stress si intende la somma di tutti i parametri del lavoro nel sistema lavorativo che influenzano le persone al lavoro, che sono percepiti o percepiti principalmente attraverso il sistema recettore o che pongono richieste al sistema effettore. I parametri dello stress derivano dal compito lavorativo (lavoro muscolare, lavoro non muscolare - dimensioni e fattori orientati al compito) e dalle condizioni fisiche, chimiche e sociali in cui il lavoro deve essere svolto (rumore, clima, illuminazione, vibrazioni , lavoro a turni, ecc. - dimensioni e fattori orientati alla situazione).

L'intensità/difficoltà, la durata e la composizione (cioè la distribuzione simultanea e successiva di queste esigenze specifiche) dei fattori di stress si traduce in uno stress combinato, che tutti gli effetti esogeni di un sistema lavorativo esercitano sulla persona che lavora. Questo stress combinato può essere affrontato attivamente o sopportato passivamente, in particolare a seconda del comportamento della persona che lavora. Il caso attivo comporterà attività dirette all'efficienza del sistema di lavoro, mentre il caso passivo indurrà reazioni (volontarie o involontarie), che riguardano principalmente la minimizzazione dello stress. La relazione tra lo stress e l'attività è influenzata in modo decisivo dalle caratteristiche individuali e dai bisogni della persona che lavora. I principali fattori di influenza sono quelli che determinano le prestazioni e sono legati alla motivazione e alla concentrazione e quelli legati alla disposizione, che possono essere indicati come capacità e competenze.

Le sollecitazioni relative al comportamento, che si manifestano in determinate attività, provocano tensioni individuali diverse. Gli sforzi possono essere indicati dalla reazione di indicatori fisiologici o biochimici (ad esempio, aumento della frequenza cardiaca) o possono essere percepiti. Pertanto, le sollecitazioni sono suscettibili di "scalatura psicofisica", che stima la sollecitazione sperimentata dalla persona che lavora. In un approccio comportamentale, l'esistenza della tensione può anche essere derivata da un'analisi dell'attività. L'intensità con cui reagiscono gli indicatori di stress (fisiologico-biochimici, comportamentali o psico-fisici) dipende dall'intensità, dalla durata e dalla combinazione dei fattori di stress nonché dalle caratteristiche individuali, capacità, abilità e bisogni della persona che lavora.

Nonostante le continue sollecitazioni, gli indicatori derivati dai campi di attività, prestazione e sforzo possono variare nel tempo (effetto temporale). Tali variazioni temporali sono da interpretare come processi di adattamento dei sistemi organici. Gli effetti positivi provocano una riduzione dello sforzo/miglioramento dell'attività o delle prestazioni (ad es. attraverso l'allenamento). In caso negativo, tuttavia, si tradurrà in un aumento dello sforzo/riduzione dell'attività o delle prestazioni (ad es. affaticamento, monotonia).

Gli effetti positivi possono entrare in azione se le capacità e le competenze disponibili vengono migliorate nel processo lavorativo stesso, ad esempio, quando la soglia di stimolazione dell'allenamento viene leggermente superata. È probabile che gli effetti negativi si manifestino se i cosiddetti limiti di resistenza (Rohmert 1984) vengono superati nel corso del processo lavorativo. Questa stanchezza porta ad una riduzione delle funzioni fisiologiche e psicologiche, che può essere compensata dal recupero.

Per ripristinare le prestazioni originarie sono necessarie indennità di riposo o almeno periodi di minor stress (Luczak 1993).

Quando il processo di adattamento viene portato oltre soglie definite, il sistema organico impiegato può subire danni tali da provocare una deficienza parziale o totale delle sue funzioni. Una riduzione irreversibile delle funzioni può manifestarsi quando lo stress è troppo elevato (danno acuto) o quando il recupero è impossibile per lungo tempo (danno cronico). Un tipico esempio di tale danno è la perdita dell'udito indotta dal rumore.

Modelli di fatica

La fatica può essere multiforme, a seconda della forma e della combinazione della deformazione, e una sua definizione generale non è ancora possibile. I processi biologici della fatica in genere non sono misurabili in modo diretto, per cui le definizioni sono principalmente orientate verso i sintomi della fatica. Questi sintomi di affaticamento possono essere suddivisi, ad esempio, nelle seguenti tre categorie.

- Sintomi fisiologici: la fatica è interpretata come una diminuzione delle funzioni degli organi o dell'intero organismo. Risulta in reazioni fisiologiche, ad esempio, in un aumento della frequenza cardiaca o dell'attività muscolare elettrica (Laurig 1970).

- Sintomi comportamentali: la fatica è interpretata principalmente come diminuzione dei parametri prestazionali. Gli esempi sono l'aumento degli errori durante la risoluzione di determinati compiti o una crescente variabilità delle prestazioni.

- Sintomi psico-fisici: la fatica è interpretata come un aumento della sensazione di sforzo e un deterioramento della sensazione, a seconda dell'intensità, della durata e della composizione dei fattori di stress.

Nel processo di affaticamento tutti e tre questi sintomi possono svolgere un ruolo, ma possono comparire in momenti diversi nel tempo.

Le reazioni fisiologiche nei sistemi organici, in particolare quelli coinvolti nel lavoro, possono apparire per prime. Successivamente, le sensazioni di sforzo possono essere influenzate. I cambiamenti nella prestazione si manifestano generalmente in una regolarità decrescente del lavoro o in una quantità crescente di errori, sebbene la media della prestazione possa non essere ancora influenzata. Al contrario, con un'adeguata motivazione, la persona che lavora può anche cercare di mantenere le prestazioni attraverso la forza di volontà. Il passo successivo potrebbe essere una chiara riduzione delle prestazioni che termina con un crollo delle prestazioni. I sintomi fisiologici possono portare a un collasso dell'organismo, compresi i cambiamenti della struttura della personalità e l'esaurimento. Il processo di affaticamento è spiegato nella teoria della successiva destabilizzazione (Luczak 1983).

L'andamento principale della fatica e del recupero è mostrato nella figura 2.

Figura 2. Andamento principale della fatica e del recupero

Prognosi di affaticamento e recupero

Nel campo dell'ergonomia c'è un particolare interesse nel prevedere la fatica in funzione dell'intensità, della durata e della composizione dei fattori di stress e nel determinare il tempo di recupero necessario. La tabella 1 mostra i diversi livelli di attività ei periodi di considerazione e le possibili ragioni dell'affaticamento e le diverse possibilità di recupero.

Tabella 1. Fatica e recupero dipendenti dai livelli di attività

|

Livello di attività |

Periodo |

Fatica da |

Recupero di |

|

Vita lavorativa |

decenni |

Sforzo eccessivo per |

Pensionamento |

|

Fasi della vita lavorativa |

Anni |

Sforzo eccessivo per |

Solo |

|

Sequenze di |

Mesi/settimane |

Spostamento sfavorevole |

Fine settimana, gratis |

|

Un turno di lavoro |

Un giorno |

Stress sopra |

Tempo libero, riposo |

|

Compiti |

Ore |

Stress sopra |

Periodo di riposo |

|

Parte di un compito |

Minuti |

Stress sopra |

Cambio di stress |

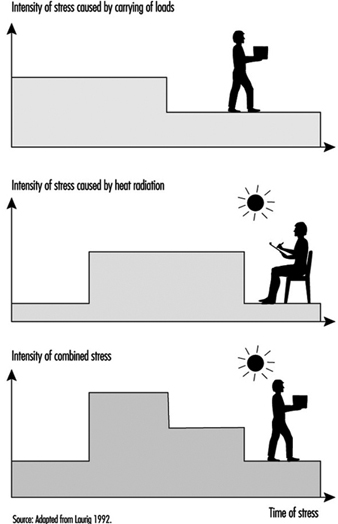

Nell'analisi ergonomica dello stress e della fatica per determinare il tempo di recupero necessario, considerare il periodo di una giornata lavorativa è il più importante. I metodi di tali analisi iniziano con la determinazione dei diversi fattori di stress in funzione del tempo (Laurig 1992) (figura 3).

Figura 3. Stress in funzione del tempo

I fattori di stress sono determinati dal contenuto specifico del lavoro e dalle condizioni di lavoro. Il contenuto del lavoro potrebbe essere la produzione di forza (ad esempio, durante la movimentazione di carichi), il coordinamento delle funzioni motorie e sensoriali (ad esempio, durante il montaggio o il funzionamento della gru), la conversione di informazioni in reazione (ad esempio, durante il controllo), le trasformazioni da input produrre informazioni (ad es. durante la programmazione, la traduzione) e la produzione di informazioni (ad es. durante la progettazione, la risoluzione di problemi). Le condizioni di lavoro comprendono aspetti fisici (ad es. rumore, vibrazioni, calore), chimici (agenti chimici) e sociali (ad es. colleghi, lavoro a turni).

Nel caso più semplice ci sarà un solo importante fattore di stress mentre gli altri possono essere trascurati. In questi casi, soprattutto quando i fattori di stress derivano dal lavoro muscolare, è spesso possibile calcolare le indennità di riposo necessarie, perché i concetti di base sono noti.

Ad esempio, l'indennità di riposo sufficiente nel lavoro muscolare statico dipende dalla forza e dalla durata della contrazione muscolare come in una funzione esponenziale legata dalla moltiplicazione secondo la formula:

![]()

con

RA = Indennità di riposo in percentuale di t

t = durata della contrazione (periodo lavorativo) in minuti

T = durata massima possibile della contrazione in minuti

f = la forza necessaria per la forza statica e

F = forza massima.

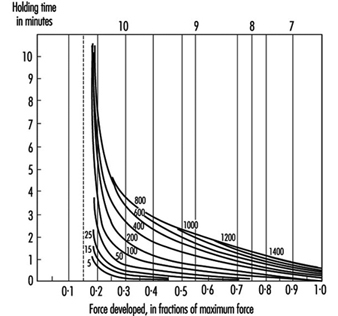

La connessione tra forza, tempo di mantenimento e indennità di riposo è mostrata nella figura 4.

Figura 4. Indennità di riposo in percentuale per varie combinazioni di forze di tenuta e tempo

Leggi simili esistono per lavoro muscolare dinamico pesante (Rohmert 1962), lavoro muscolare leggero attivo (Laurig 1974) o diverso lavoro muscolare industriale (Schmidtke 1971). Più raramente si trovano leggi comparabili per il lavoro non fisico, ad esempio per l'informatica (Schmidtke 1965). Laurig (1981) e Luczak (1982) forniscono una panoramica dei metodi esistenti per determinare l'indennità di riposo per il lavoro muscolare e non muscolare principalmente isolato.

Più difficile è la situazione in cui esiste una combinazione di diversi fattori di stress, come mostrato nella figura 5, che colpiscono simultaneamente la persona che lavora (Laurig 1992).

Figura 5. La combinazione di due fattori di stress

La combinazione di due fattori di sollecitazione, ad esempio, può portare a diverse reazioni di deformazione a seconda delle leggi di combinazione. L'effetto combinato di diversi fattori di stress può essere indifferente, compensativo o cumulativo.

Nel caso di leggi di combinazione indifferenti, i diversi fattori di stress hanno effetto su diversi sottosistemi dell'organismo. Ciascuno di questi sottosistemi può compensare la deformazione senza che la deformazione venga inserita in un sottosistema comune. La deformazione complessiva dipende dal fattore di sollecitazione più elevato e quindi non sono necessarie leggi di sovrapposizione.

Si ha un effetto compensatorio quando la combinazione di diversi fattori di stress porta a una deformazione inferiore rispetto a ciascun fattore di stress da solo. La combinazione di lavoro muscolare e basse temperature può ridurre lo sforzo complessivo, perché le basse temperature permettono al corpo di disperdere il calore prodotto dal lavoro muscolare.

Un effetto cumulativo si verifica se si sovrappongono diversi fattori di stress, ovvero devono passare attraverso un "collo di bottiglia" fisiologico. Un esempio è la combinazione di lavoro muscolare e stress da calore. Entrambi i fattori di stress influenzano il sistema circolatorio come un comune collo di bottiglia con conseguente sforzo cumulativo.

Possibili effetti combinati tra lavoro muscolare e condizioni fisiche sono descritti in Bruder (1993) (vedi tabella 2).

Tabella 2. Regole degli effetti combinati di due fattori di sollecitazione sulla deformazione

|

Freddo |

Vibrazione |

Illuminazione |

Rumore |

|

|

Lavoro dinamico pesante |

- |

+ |

0 |

0 |

|

Lavoro muscolare leggero attivo |

+ |

+ |

0 |

0 |

|

Lavoro muscolare statico |

+ |

+ |

0 |

0 |

0 effetto indifferente; + effetto cumulativo; – effetto compensativo.

Fonte: adattato da Bruder 1993.

Per il caso della combinazione di più di due fattori di stress, che nella pratica è la situazione normale, sono disponibili solo conoscenze scientifiche limitate. Lo stesso vale per la combinazione successiva di fattori di stress (cioè l'effetto di deformazione di diversi fattori di stress che colpiscono successivamente il lavoratore). Per tali casi, in pratica, il tempo di recupero necessario viene determinato misurando parametri fisiologici o psicologici e utilizzandoli come valori integrativi.

Impatto dell'errore di misurazione casuale

Gli errori nella misurazione dell'esposizione possono avere impatti diversi sulla relazione esposizione-malattia studiata, a seconda di come sono distribuiti gli errori. Se uno studio epidemiologico è stato condotto alla cieca (ovvero, le misurazioni sono state effettuate senza alcuna conoscenza della malattia o dello stato di salute dei partecipanti allo studio) ci aspettiamo che l'errore di misurazione sia distribuito uniformemente tra gli strati della malattia o dello stato di salute.

La tabella 1 fornisce un esempio: supponiamo di reclutare una coorte di persone esposte sul lavoro a una sostanza tossica, per indagare su una malattia frequente. Determiniamo lo stato di esposizione solo al momento del reclutamento (T0), e non in altri momenti durante il follow-up. Diciamo però che un certo numero di individui cambia effettivamente il proprio stato di esposizione nell'anno successivo: al tempo T1, 250 delle 1,200 persone originariamente esposte hanno cessato di essere esposte, mentre 150 delle 750 persone originariamente non esposte hanno iniziato a essere esposte alla sostanza tossica. Pertanto, al tempo T1, 1,100 individui sono esposti e 850 non sono esposti. Di conseguenza, abbiamo una "classificazione errata" dell'esposizione, basata sulla nostra misurazione iniziale dello stato dell'esposizione al tempo T0. Questi individui vengono poi rintracciati dopo 20 anni (al tempo T2) e viene valutato il rischio cumulativo di malattia. (L'ipotesi fatta nell'esempio è che solo l'esposizione di più di un anno è una preoccupazione.)

Tabella 1. Ipotetica coorte di 1950 individui (esposti e non esposti al lavoro), reclutati al tempo T0 e il cui stato di malattia è accertato al tempo T2

|

Ora |

|||

|

T0 |

T1 |

T2 |

|

Lavoratori esposti 1200 250 cessazione esposizione 1100 (1200-250+150)

Casi di malattia al tempo T2 = 220 tra i lavoratori esposti

Lavoratori non esposti 750 150 inizio esposizione 850 (750-150+250)

Casi di malattia al tempo T2 = 85 tra i lavoratori non esposti

I vero rischio di malattia al tempo T2 è del 20% tra i lavoratori esposti (220/1100),

e il 10% nei lavoratori non esposti (85/850) (rapporto di rischio = 2.0).

Rischio stimato a T2 di malattia tra quelli classificati come esposti a T0: 20%

(ovvero rischio reale in soggetti esposti) ´ 950 (ovvero 1200-250)+ 10%

(ossia, rischio reale nei non esposti) ´ 250 = (190+25)/1200 = 17.9%

Rischio stimato a T2 di malattia tra quelli classificati come non esposti a

T0: 20% (ovvero, rischio vero negli esposti) ´ 150 +10%

(ovvero, rischio reale in non esposti) ´ 600 (ovvero 750-150) = (30+60)/750 = 12%

Rapporto di rischio stimato = 17.9% / 12% = 1.49

L'errata classificazione dipende, in questo esempio, dal disegno dello studio e dalle caratteristiche della popolazione, piuttosto che dai limiti tecnici della misurazione dell'esposizione. L'effetto dell'errata classificazione è tale che il rapporto “vero” di 2.0 tra il rischio cumulativo tra le persone esposte e le persone non esposte diventa un rapporto “osservato” di 1.49 (tabella 1). Questa sottostima del rapporto di rischio deriva da un "offuscamento" del rapporto tra esposizione e malattia, che si verifica quando l'errata classificazione dell'esposizione, come in questo caso, è uniformemente distribuita in base alla malattia o allo stato di salute (ovvero, la misurazione dell'esposizione è non influenzato dal fatto che la persona soffrisse o meno della malattia che stiamo studiando).

Al contrario, può verificarsi una sottostima o una sopravvalutazione dell'associazione degli interessi quando l'errata classificazione dell'esposizione non è distribuita uniformemente sul risultato degli interessi. Nell'esempio, potremmo avere pregiudizio, e non solo un offuscamento della relazione eziologica, se la classificazione dell'esposizione dipende dalla malattia o dallo stato di salute dei lavoratori. Ciò potrebbe verificarsi, ad esempio, se decidiamo di prelevare campioni biologici da un gruppo di lavoratori esposti e da un gruppo di lavoratori non esposti, al fine di identificare i primi cambiamenti legati all'esposizione sul lavoro. I campioni dei lavoratori esposti potrebbero quindi essere analizzati in modo più accurato rispetto ai campioni dei lavoratori non esposti; la curiosità scientifica potrebbe portare il ricercatore a misurare ulteriori biomarcatori tra le persone esposte (tra cui, ad esempio, addotti al DNA nei linfociti o marcatori urinari di danno ossidativo al DNA), nell'ipotesi che queste persone siano scientificamente “più interessanti”. Si tratta di un atteggiamento piuttosto comune che, tuttavia, potrebbe portare a gravi pregiudizi.

Metodi statistici

Si discute molto sul ruolo della statistica nella ricerca epidemiologica sulle relazioni causali. In epidemiologia, la statistica è principalmente una raccolta di metodi per valutare i dati basati sulle popolazioni umane (e anche animali). In particolare, la statistica è una tecnica per la quantificazione e la misurazione di fenomeni incerti. Tutte le indagini scientifiche che si occupano di aspetti non deterministici e variabili della realtà potrebbero beneficiare della metodologia statistica. In epidemiologia, la variabilità è intrinseca all'unità di osservazione: una persona non è un'entità deterministica. Mentre i disegni sperimentali sarebbero migliorati in termini di migliore corrispondenza con le ipotesi della statistica in termini di variazione casuale, per ragioni etiche e pratiche questo approccio non è molto comune. Invece, l'epidemiologia è impegnata nella ricerca osservazionale che ha associato ad essa sia fonti casuali che altre fonti di variabilità.

La teoria statistica si occupa di come controllare la variabilità non strutturata nei dati al fine di trarre valide inferenze da osservazioni empiriche. In mancanza di qualsiasi spiegazione per il comportamento variabile del fenomeno studiato, la statistica lo assume come casuale- cioè, deviazioni non sistematiche da uno stato di natura medio (vedi Groenlandia 1990 per una critica a questi presupposti).

La scienza si basa sull'esperienza prova per dimostrare se i suoi modelli teorici di eventi naturali hanno una qualche validità. In effetti, i metodi utilizzati dalla teoria statistica determinano il grado in cui le osservazioni nel mondo reale sono conformi alla visione degli scienziati, in forma di modello matematico, di un fenomeno. I metodi statistici, basati sulla matematica, devono quindi essere accuratamente selezionati; ci sono molti esempi su "come mentire con le statistiche". Pertanto, gli epidemiologi dovrebbero essere consapevoli dell'adeguatezza delle tecniche che applicano per misurare il rischio di malattia. In particolare, è necessaria grande attenzione nell'interpretazione sia dei risultati statisticamente significativi che di quelli statisticamente non significativi.

Il primo significato della parola statistica si riferisce a qualsiasi quantità di riepilogo calcolata su un insieme di valori. Indici descrittivi o statistici come la media aritmetica, la mediana o la moda, sono ampiamente utilizzati per sintetizzare le informazioni in una serie di osservazioni. Storicamente, questi descrittori sommari sono stati utilizzati per scopi amministrativi dagli stati, e quindi sono stati nominati statistica. In epidemiologia, le statistiche che si vedono comunemente derivano dai confronti inerenti alla natura dell'epidemiologia, che pone domande come: "Una popolazione è a maggior rischio di malattia rispetto a un'altra?" Nel fare tali confronti, il rischio relativo è una misura popolare della forza dell'associazione tra una caratteristica individuale e la probabilità di ammalarsi, ed è più comunemente applicato nella ricerca eziologica; il rischio attribuibile è anche una misura dell'associazione tra caratteristiche individuali e insorgenza della malattia, ma sottolinea il guadagno in termini di numero di casi risparmiati da un intervento che rimuove il fattore in questione: è applicato principalmente nella sanità pubblica e nella medicina preventiva.