Kinder Kategorien

27. Biologische Überwachung (6)

27. Biologische Überwachung

Kapitelherausgeber: Robert Lauwerys

Inhaltsverzeichnis

Tabellen und Abbildungen

Allgemeine Grundsätze

Vito Foà und Lorenzo Alessio

Qualitätssicherung

D. Gompertz

Metalle und metallorganische Verbindungen

P. Hoet und Robert Lauwerys

Organische Lösungsmittel

Masayuki Ikeda

Genotoxische Chemikalien

Marja Sorsa

Pestizide

Marco Maroni und Adalberto Ferioli

Tische

Klicken Sie unten auf einen Link, um die Tabelle im Artikelkontext anzuzeigen.

1. ACGIH, DFG & andere Grenzwerte für Metalle

2. Beispiele für Chemikalien- und biologisches Monitoring

3. Biologische Überwachung auf organische Lösungsmittel

4. Genotoxizität von Chemikalien, bewertet von IARC

5. Biomarker und einige Zell-/Gewebeproben und Genotoxizität

6. Menschliche Karzinogene, berufliche Exposition und zytogenetische Endpunkte

8. Exposition durch Produktion und Verwendung von Pestiziden

9. Akute OP-Toxizität bei verschiedenen Graden der ACHE-Hemmung

10 Variationen von ACHE & PCHE & ausgewählten Gesundheitszuständen

11 Cholinesterase-Aktivitäten von nicht exponierten gesunden Menschen

12 Alkylphosphate im Urin und OP-Pestizide

13 Alkylphosphatmessungen im Urin & OP

14 Carbamat-Metaboliten im Urin

15 Dithiocarbamat-Metaboliten im Urin

16 Vorgeschlagene Indizes für die biologische Überwachung von Pestiziden

17 Empfohlene biologische Grenzwerte (Stand 1996)

Zahlen

Zeigen Sie auf eine Miniaturansicht, um die Bildunterschrift anzuzeigen, klicken Sie, um die Abbildung im Artikelkontext anzuzeigen.

28. Epidemiologie und Statistik (12)

28. Epidemiologie und Statistik

Kapitel-Editoren: Franco Merletti, Colin L. Soskolne und Paolo Vineis

Inhaltsverzeichnis

Tabellen und Abbildungen

Epidemiologische Methode für Arbeitssicherheit und Gesundheitsschutz

Franco Merletti, Colin L. Soskolne und Paolo Vineis

Expositionsbewertung

M. Gerald Ott

Zusammenfassung der Expositionsmaßnahmen im Arbeitsleben

Colin L. Soskolne

Messung der Auswirkungen von Expositionen

Shelia Hoar Zahm

Fallbeispiel: Maßnahmen

Franco Merletti, Colin L. Soskolne und Paola Vineis

Optionen im Studiendesign

Sven Herberg

Validitätsprobleme im Studiendesign

Annie J. Sasco

Einfluss zufälliger Messfehler

Paolo Vineis und Colin L. Soskolne

Statistische Methoden

Annibale Biggeri und Mario Braga

Kausalitätsbewertung und Ethik in der epidemiologischen Forschung

Paolo Vineis

Fallstudien zur Veranschaulichung methodischer Probleme bei der Überwachung von Berufskrankheiten

Jung-Der Wang

Fragebögen in der epidemiologischen Forschung

Steven D. Stellman und Colin L. Soskolne

Asbest Historische Perspektive

Laurent Garfinkel

Tische

Klicken Sie unten auf einen Link, um die Tabelle im Artikelkontext anzuzeigen.

1. Fünf ausgewählte zusammenfassende Maßnahmen zur Exposition im Berufsleben

2. Maße für das Auftreten von Krankheiten

3. Assoziationsmaße für eine Kohortenstudie

4. Assoziationsmaße für Fall-Kontroll-Studien

5. Allgemeines Häufigkeitstabellenlayout für Kohortendaten

6. Musterlayout von Fallkontrolldaten

7. Layout-Fallkontrolldaten – eine Kontrolle pro Fall

8. Hypothetische Kohorte von 1950 Individuen zu T2

9. Indizes der zentralen Tendenz und Streuung

10 Ein binomiales Experiment & Wahrscheinlichkeiten

11 Mögliche Ergebnisse eines binomialen Experiments

12 Binomialverteilung, 15 Erfolge/30 Versuche

13 Binomialverteilung, p = 0.25; 30 Versuche

14 Fehler XNUMX. Art & Leistung; x = 12, n = 30, a = 0.05

15 Fehler XNUMX. Art & Leistung; x = 12, n = 40, a = 0.05

16 632 Arbeitnehmer, die 20 Jahre oder länger Asbest ausgesetzt waren

17 O/E Zahl der Todesfälle unter 632 Asbestarbeitern

Zahlen

Zeigen Sie auf eine Miniaturansicht, um die Bildunterschrift anzuzeigen, klicken Sie, um die Abbildung im Artikelkontext anzuzeigen.

29. Ergonomie (27)

29. Ergonomie

Kapitel-Editoren: Wolfgang Laurig und Joachim Vedder

Inhaltsverzeichnis

Tabellen und Abbildungen

Überblick

Wolfgang Laurig und Joachim Vedder

Ziele, Prinzipien und Methoden

Wesen und Ziele der Ergonomie

William T. Singleton

Analyse von Aktivitäten, Aufgaben und Arbeitssystemen

Véronique De Keyser

Ergonomie und Standardisierung

Friedhelm Nachreiner

Prüflisten

Pranab Kumar Nag

Physikalische und physiologische Aspekte

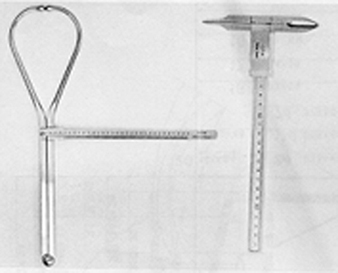

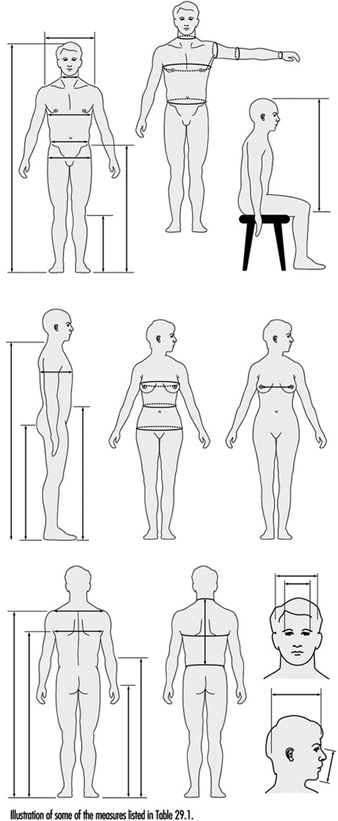

Anthropometrie

Melchiorre Masali

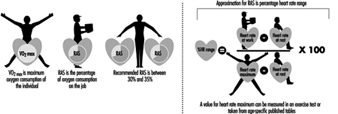

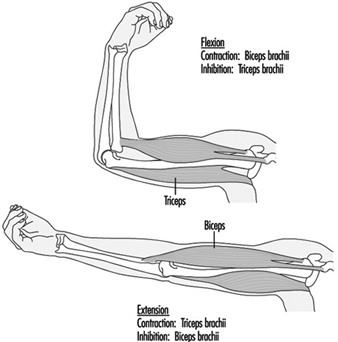

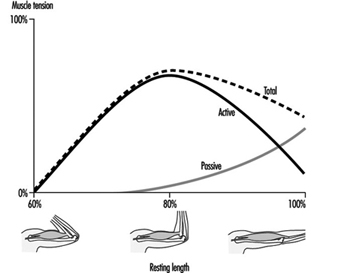

Muskelarbeit

Juhani Smolander und Veikko Louhevaara

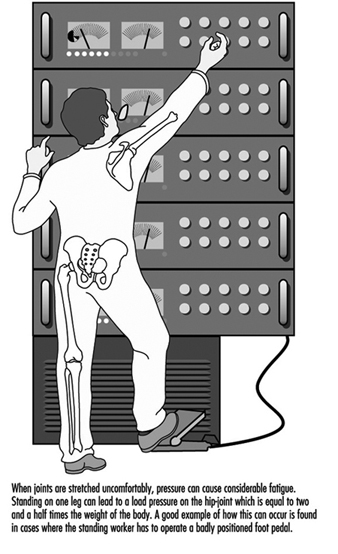

Körperhaltungen bei der Arbeit

Ilkka Kurinka

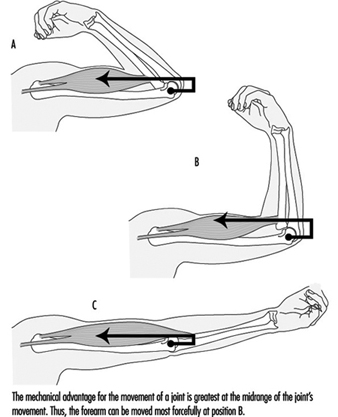

Biomechanik

Frank Darby

Allgemeine Müdigkeit

Etienne Grandjean

Müdigkeit und Erholung

Rolf Helbig und Walter Rohmert

Psychologische Aspekte

Geistige Arbeitsbelastung

Winfried Hacker

Wachsamkeit

Herbert Heuer

Geistige Müdigkeit

Peter Richter

Organisatorische Aspekte der Arbeit

Arbeitsorganisation

Eberhard Ulich und Gudela Grote

Schlafentzug

Kazutaka Kogi

Gestaltung von Arbeitssystemen

Workstations

Roland Kadefors

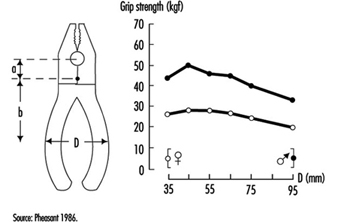

Tools

TM Fraser

Bedienelemente, Anzeigen und Bedienfelder

Karl HE Kroemer

Informationsverarbeitung und Design

Andries F. Sanders

Designen für alle

Entwerfen für bestimmte Gruppen

Witz H. Grady-van den Nieuwboer

Fallstudie: Die internationale Klassifikation der Funktionseinschränkung beim Menschen

Kulturelle Unterschiede

Houshang Shahnavaz

Ältere Arbeitnehmer

Antoine Laville und Serge Volkoff

Arbeitnehmer mit besonderen Bedürfnissen

Witz H. Grady-van den Nieuwboer

Vielfalt und Bedeutung der Ergonomie – zwei Beispiele

Systemdesign in der Diamantherstellung

Issachar Gilad

Missachtung ergonomischer Gestaltungsprinzipien: Tschernobyl

Wladimir M. Munipov

Tische

Klicken Sie unten auf einen Link, um die Tabelle im Artikelkontext anzuzeigen.

1. Grundlegende anthropometrische Kernliste

2. Ermüdung und Erholung abhängig vom Aktivitätsniveau

3. Regeln der Kombinationswirkung zweier Stressfaktoren auf die Belastung

4. Es wird zwischen mehreren negativen Folgen psychischer Belastung unterschieden

5. Arbeitsorientierte Prinzipien zur Produktionsgestaltung

6. Partizipation im organisatorischen Kontext

7. Benutzerbeteiligung am Technologieprozess

8. Unregelmäßige Arbeitszeiten und Schlafentzug

9. Aspekte von Früh-, Anker- und Verzögerungsschlaf

10 Kontrollieren Sie Bewegungen und erwartete Effekte

11 Steuerungs-Wirkungs-Beziehungen gängiger Handsteuerungen

12 Regeln für die Anordnung von Kontrollen

Zahlen

Zeigen Sie auf eine Miniaturansicht, um die Bildunterschrift anzuzeigen, klicken Sie, um die Abbildung im Artikelkontext anzuzeigen.

30. Arbeitshygiene (6)

30. Arbeitshygiene

Kapitel-Editor: Robert F. Herrick

Inhaltsverzeichnis

Tabellen und Abbildungen

Ziele, Definitionen und allgemeine Informationen

Berenice I. Ferrari Goelzer

Gefahren erkennen

Linnea Lillienberg

Bewertung der Arbeitsumgebung

Lori A. Todd

Arbeitshygiene: Expositionskontrolle durch Intervention

James Stewart

Die biologische Grundlage für die Expositionsbewertung

Dick Heederik

Arbeitsplatzgrenzwerte

Dennis J. Pausenbach

Tische

1. Gefahren durch Chemikalien; biologische und physikalische Wirkstoffe

2. Arbeitsplatzgrenzwerte (OELs) – verschiedene Länder

Zahlen

31. Personenschutz (7)

31. Persönlicher Schutz

Kapitel-Editor: Robert F. Herrick

Inhaltsverzeichnis

Tabellen und Abbildungen

Überblick und Philosophie des Personenschutzes

Robert F. Herrick

Augen- und Gesichtsschutz

Kikuzi Kimura

Fuß- und Beinschutz

Toyohiko Miura

Kopfschutz

Isabelle Balty und Alain Mayer

Gehörschutz

John R. Franks und Elliott H. Berger

Schutzkleidung

S.Zack Mansdorf

Atemschutz

Thomas J. Nelson

Tische

Klicken Sie unten auf einen Link, um die Tabelle im Artikelkontext anzuzeigen.

1. Transmissionsanforderungen (ISO 4850-1979)

2. Schutzmaßstäbe - Gasschweißen & Lötschweißen

3. Schutzwaage - Sauerstoffschneiden

4. Schutzmaßstäbe - Plasmalichtbogenschneiden

5. Schutzwaagen - Lichtbogenschweißen oder Fugenhobeln

6. Schutzmaßstäbe - Plasma-Lichtbogen-Direktschweißen

7. Schutzhelm: ISO-Norm 3873-1977

8. Geräuschreduzierungsbewertung eines Gehörschutzes

9. Berechnung der A-bewerteten Rauschunterdrückung

10 Beispiele für Hautgefahrenkategorien

11 Physikalische, chemische und biologische Leistungsanforderungen

12 Sachgefahren im Zusammenhang mit bestimmten Tätigkeiten

13 Zugewiesene Schutzfaktoren aus ANSI Z88 2 (1992)

Zahlen

Zeigen Sie auf eine Miniaturansicht, um die Bildunterschrift anzuzeigen, klicken Sie, um die Abbildung im Artikelkontext anzuzeigen.

32. Aufzeichnungssysteme und Überwachung (9)

32. Aufzeichnungssysteme und Überwachung

Kapitel-Editor: Steven D. Stellman

Inhaltsverzeichnis

Tabellen und Abbildungen

Überwachungs- und Meldesysteme für Berufskrankheiten

Steven B. Markowitz

Überwachung von Arbeitsgefahren

David H. Wegman und Steven D. Stellman

Überwachung in Entwicklungsländern

David Koh und Kee-Seng Chia

Entwicklung und Anwendung eines Klassifizierungssystems für Arbeitsunfälle und Berufskrankheiten

Elyce Biddle

Risikoanalyse von nicht tödlichen Verletzungen und Krankheiten am Arbeitsplatz

John W. Ruser

Fallstudie: Arbeitnehmerschutz und Statistiken zu Unfällen und Berufskrankheiten - HVBG, Deutschland

Martin Butz und Burkhard Hoffmann

Fallstudie: Wismut – Eine Neuauflage der Uranexposition

Heinz Otten und Horst Schulz

Messstrategien und -techniken für die berufsbedingte Expositionsabschätzung in der Epidemiologie

Frank Bochmann und Helmut Blome

Fallstudie: Arbeitsmedizinische Erhebungen in China

Tische

Klicken Sie unten auf einen Link, um die Tabelle im Artikelkontext anzuzeigen.

1. Angiosarkom der Leber - Weltregister

2. Berufskrankheit, USA, 1986 versus 1992

3. US-Todesfälle durch Pneumokoniose und Pleuramesotheliom

4. Musterliste meldepflichtiger Berufskrankheiten

5. Codestruktur für die Meldung von Krankheiten und Verletzungen, USA

6. Nichttödliche Arbeitsunfälle und Berufskrankheiten, USA 1993

7. Risiko von Arbeitsunfällen und Berufskrankheiten

8. Relatives Risiko für sich wiederholende Bewegungszustände

9. Arbeitsunfälle, Deutschland, 1981-93

10 Schleifmaschinen bei Unfällen in der Metallverarbeitung, Deutschland, 1984-93

11 Berufskrankheit, Deutschland, 1980-93

12 Infektionskrankheiten, Deutschland, 1980-93

13 Strahlenbelastung in den Wismut-Bergwerken

14 Berufskrankheiten im Wismuter Uranbergwerk 1952-90

Zahlen

Zeigen Sie auf eine Miniaturansicht, um die Bildunterschrift anzuzeigen, klicken Sie, um die Abbildung im Artikelkontext anzuzeigen.

33. Toxikologie (21)

33. Toxikologie

Kapitelherausgeberin: Ellen K. Silbergeld

Inhaltsverzeichnis

Tabellen und Abbildungen

Einleitung

Ellen K. Silbergeld, Kapitelredakteurin

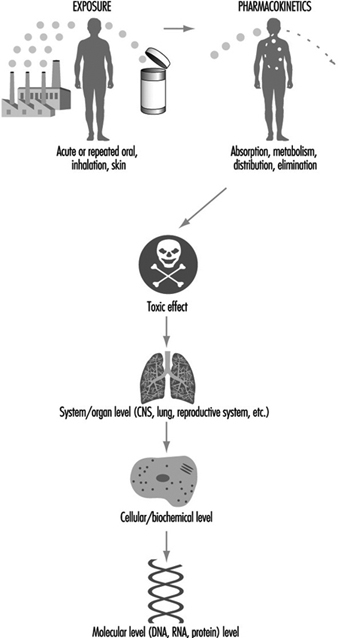

Allgemeine Prinzipien der Toxikologie

Definitionen und Konzepte

Bo Holmberg, Johan Hogberg und Gunnar Johanson

Toxikokinetik

Dušan Djuric

Zielorgan und kritische Wirkungen

Marek Jakubowski

Auswirkungen von Alter, Geschlecht und anderen Faktoren

Spomenka Telisman

Genetische Determinanten der toxischen Reaktion

Daniel W. Nebert und Ross A. McKinnon

Mechanismen der Toxizität

Einführung und Konzepte

Philip G. Watanabe

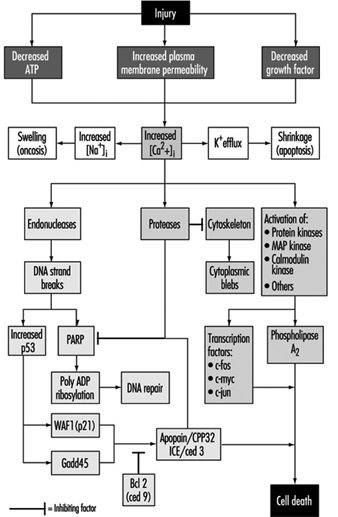

Zellschädigung und Zelltod

Benjamin F. Trump und Irene K. Berezesky

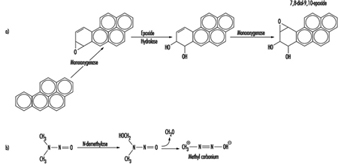

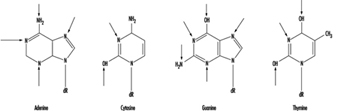

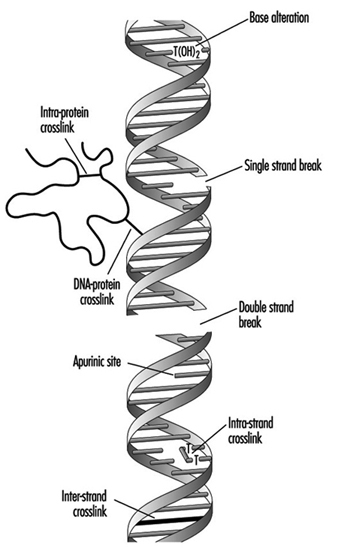

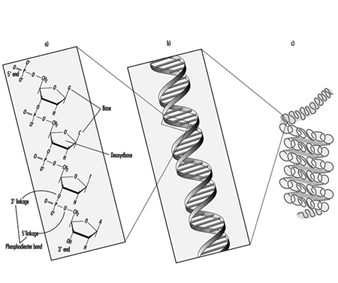

Genetische Toxikologie

R. Rita Misra und Michael P. Waalkes

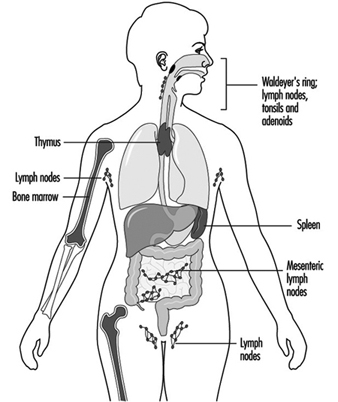

Immuntoxikologie

Joseph G. Vos und Henk van Loveren

Zielorgan-Toxikologie

Ellen K. Silbergeld

Toxikologische Testmethoden

Biomarker

Philipp Grandjean

Bewertung der genetischen Toxizität

David M. DeMarini und James Huff

In-vitro-Toxizitätstest

Joanne Zürlo

Aktivitätsbeziehungen strukturieren

Ellen K. Silbergeld

Regulatorische Toxikologie

Toxikologie in der Gesundheits- und Sicherheitsverordnung

Ellen K. Silbergeld

Prinzipien der Gefahrenidentifizierung - Der japanische Ansatz

Masayuki Ikeda

Der Ansatz der Vereinigten Staaten zur Risikobewertung von reproduktionstoxischen und neurotoxischen Wirkstoffen

Ellen K. Silbergeld

Ansätze zur Gefahrenidentifizierung - IARC

Harri Vainio und Julian Wilbourn

Anhang – Gesamtbewertungen der Karzinogenität beim Menschen: IARC-Monographien, Bände 1–69 (836)

Karzinogen-Risikobewertung: Andere Ansätze

Cees A. van der Heijden

Tische

Klicken Sie unten auf einen Link, um die Tabelle im Artikelkontext anzuzeigen.

- Beispiele für kritische Organe und kritische Effekte

- Grundlegende Wirkungen möglicher Mehrfachwechselwirkungen von Metallen

- Hämoglobinaddukte bei Arbeitern, die Anilin und Acetanilid ausgesetzt waren

- Erbliche, krebsanfällige Erkrankungen und Defekte in der DNA-Reparatur

- Beispiele für Chemikalien, die in menschlichen Zellen genotoxisch wirken

- Klassifizierung von Tests für Immunmarker

- Beispiele für Biomarker der Exposition

- Vor- und Nachteile von Methoden zur Identifizierung von Krebsrisiken beim Menschen

- Vergleich von In-vitro-Systemen für Hepatotoxizitätsstudien

- Vergleich von SAR- und Testdaten: OECD/NTP-Analysen

- Regulierung chemischer Stoffe durch Gesetze, Japan

- Prüfgegenstände gemäß dem Gesetz zur Kontrolle chemischer Substanzen, Japan

- Chemische Substanzen und das Gesetz zur Kontrolle chemischer Substanzen

- Ausgewählte größere Neurotoxizitätsvorfälle

- Beispiele für spezialisierte Tests zur Messung der Neurotoxizität

- Endpunkte in der Reproduktionstoxikologie

- Vergleich von Niedrigdosis-Extrapolationsverfahren

- Häufig zitierte Modelle zur Charakterisierung des Karzinogenrisikos

Zahlen

Zeigen Sie auf eine Miniaturansicht, um die Bildunterschrift anzuzeigen, klicken Sie, um die Abbildung im Artikelkontext anzuzeigen.

Pestizide

Einleitung

Die Exposition des Menschen gegenüber Pestiziden weist unterschiedliche Merkmale auf, je nachdem, ob sie während der industriellen Produktion oder Verwendung auftritt (Tabelle 1). Die Formulierung kommerzieller Produkte (durch Mischen von Wirkstoffen mit anderen Beistoffen) hat einige Expositionsmerkmale gemeinsam mit der Verwendung von Pestiziden in der Landwirtschaft. Da die Formulierung typischerweise von kleinen Industrien durchgeführt wird, die viele verschiedene Produkte in aufeinanderfolgenden Arbeitsgängen herstellen, sind die Arbeiter für kurze Zeit jedem von mehreren Pestiziden ausgesetzt. Im öffentlichen Gesundheitswesen und in der Landwirtschaft ist die Verwendung einer Vielzahl von Verbindungen im Allgemeinen die Regel, obwohl in einigen spezifischen Anwendungen (z. B. Baumwollentlaubung oder Malariakontrollprogramme) ein einziges Produkt verwendet werden kann.

Tabelle 1. Vergleich der Expositionseigenschaften bei der Herstellung und Verwendung von Pestiziden

|

Exposition gegenüber der Produktion |

Exposition bei der Verwendung |

|

|

Dauer der Exposition |

Kontinuierlich und verlängert |

Variabel und intermittierend |

|

Grad der Exposition |

Ziemlich konstant |

Extrem variabel |

|

Art der Exposition |

Zu einer oder wenigen Verbindungen |

Zu zahlreichen Verbindungen entweder nacheinander oder gleichzeitig |

|

Aufnahme durch die Haut |

Einfach zu kontrollieren |

Variabel je nach Arbeitsablauf |

|

Umgebungsüberwachung |

Nützlich |

Selten informativ |

|

Biologische Überwachung |

Ergänzend zur Umgebungsüberwachung |

Sehr nützlich, wenn verfügbar |

Quelle: WHO 1982a, modifiziert.

Die Messung biologischer Expositionsindikatoren ist besonders nützlich für Pestizidanwender, bei denen die herkömmlichen Techniken der Expositionsbewertung durch Überwachung der Umgebungsluft kaum anwendbar sind. Die meisten Pestizide sind fettlösliche Substanzen, die in die Haut eindringen. Das Auftreten einer perkutanen (Haut-)Absorption macht die Verwendung von biologischen Indikatoren sehr wichtig bei der Beurteilung des Expositionsniveaus unter diesen Umständen.

Organophosphat-Insektizide

Biologische Wirkungsindikatoren:

Cholinesterasen sind die Zielenzyme, die für die Toxizität von Organophosphaten (OP) gegenüber Insekten- und Säugetierspezies verantwortlich sind. Es gibt zwei Haupttypen von Cholinesterasen im menschlichen Organismus: Acetylcholinesterase (ACHE) und Plasmacholinesterase (PCHE). OP verursacht beim Menschen toxische Wirkungen durch die Hemmung der synaptischen Acetylcholinesterase im Nervensystem. Acetylcholinesterase kommt auch in roten Blutkörperchen vor, deren Funktion unbekannt ist. Plasmacholinesterase ist ein allgemeiner Begriff, der eine inhomogene Gruppe von Enzymen umfasst, die in Gliazellen, Plasma, Leber und einigen anderen Organen vorhanden sind. PCHE wird durch OPs gehemmt, aber seine Hemmung erzeugt keine bekannten funktionellen Störungen.

Die Hemmung der ACHE- und PCHE-Aktivität im Blut korreliert stark mit der Intensität und Dauer der OP-Exposition. Blut-ACHE, das dasselbe molekulare Ziel wie dasjenige ist, das für die akute OP-Toxizität im Nervensystem verantwortlich ist, ist ein spezifischerer Indikator als PCHE. Die Empfindlichkeit von Blut-ACHE und PCHE gegenüber OP-Hemmung variiert jedoch zwischen den einzelnen OP-Verbindungen: bei der gleichen Blutkonzentration hemmen einige mehr ACHE und andere mehr PCHE.

Es besteht eine vernünftige Korrelation zwischen der ACHE-Aktivität im Blut und den klinischen Anzeichen einer akuten Toxizität (Tabelle 2). Die Korrelation ist tendenziell besser, da die Hemmungsrate schneller ist. Wenn die Hemmung langsam eintritt, wie bei chronischen Expositionen auf niedrigem Niveau, kann die Korrelation mit Krankheit gering oder gar nicht vorhanden sein. Es muss beachtet werden, dass die Hemmung von Blut-ACHE keine Vorhersage für chronische oder verzögerte Wirkungen ist.

Tabelle 2. Schweregrad und Prognose der akuten OP-Toxizität bei verschiedenen Graden der ACHE-Hemmung

|

SCHMERZEN Hemmung (%) |

Mechanisierungsgrad Vergiftung |

Klinische Symptome |

Prognose |

|

50-60 |

Mild |

Schwäche, Kopfschmerzen, Schwindel, Übelkeit, Speichelfluss, Tränenfluss, Miosis, mäßiger Bronchialkrampf |

Rekonvaleszenz in 1-3 Tagen |

|

60-90 |

Moderat |

Plötzliche Schwäche, Sehstörungen, übermäßiger Speichelfluss, Schwitzen, Erbrechen, Durchfall, Bradykardie, Hypertonie, Zittern der Hände und des Kopfes, Gangstörungen, Miosis, Brustschmerzen, Zyanose der Schleimhäute |

Rekonvaleszenz in 1-2 Wochen |

|

90-100 |

Schwer |

Abruptes Zittern, generalisierte Krämpfe, psychische Störungen, intensive Zyanose, Lungenödem, Koma |

Tod durch Atem- oder Herzversagen |

Variationen der ACHE- und PCHE-Aktivitäten wurden bei gesunden Menschen und bei bestimmten physiopathologischen Zuständen beobachtet (Tabelle 3). Somit kann die Sensitivität dieser Tests bei der Überwachung der OP-Exposition erhöht werden, indem individuelle Präexpositionswerte als Referenz verwendet werden. Die Cholinesterase-Aktivitäten nach der Exposition werden dann mit den individuellen Ausgangswerten verglichen. Referenzwerte für die Populationscholinesteraseaktivität sollten nur verwendet werden, wenn die Cholinesterasespiegel vor der Exposition nicht bekannt sind (Tabelle 4).

Tabelle 3. Variationen der ACHE- und PCHE-Aktivitäten bei gesunden Menschen und bei ausgewählten physiopathologischen Zuständen

|

Anforderungen |

ACHE-Aktivität |

PCHE-Aktivität |

|

Gesunde Menschen |

||

|

Interindividuelle Variation1 |

10-18% |

15-25% |

|

Intraindividuelle Variation1 |

3-7% |

6% |

|

Geschlechtsunterschiede |

Nein |

10–15 % höher bei Männern |

|

Alter |

Bis 6 Monate reduziert |

|

|

Körpermasse |

Positive Korrelation |

|

|

Serum Cholesterin |

Positive Korrelation |

|

|

Saisonale Unterschiede |

Nein |

Nein |

|

Zirkadiane Variation |

Nein |

Nein |

|

Menstruation |

Verringert |

|

|

Schwangerschaft |

Verringert |

|

|

Pathologische Zustände |

||

|

Reduzierte Aktivität |

Leukämie, Neubildung |

Leber erkrankung; Urämie; Krebs; Herzfehler; allergische Reaktionen |

|

Erhöhte Aktivität |

Polyzythämie; Thalassämie; andere angeborene Blutdyskrasie |

Hyperthyreose; andere Zustände mit hoher Stoffwechselrate |

1 Quelle: Augustinsson 1955 und Gage 1967.

Tabelle 4. Mit ausgewählten Methoden gemessene Cholinesterase-Aktivitäten von gesunden Menschen ohne OP-Exposition

|

Versandart |

Geschlecht |

SCHMERZEN* |

PCE* |

|

Michel1 (DpH/h) |

männlich weiblich |

0.77 0.08 ± 0.75 0.08 ± |

0.95 0.19 ± 0.82 0.19 ± |

|

Titrimetrisch1 (mmol/min ml) |

männlich Weiblich |

13.2 0.31 ± |

4.90 0.02 ± |

|

Ellman ist modifiziert2 (UI/ml) |

männlich weiblich |

4.01 0.65 ± 3.45 0.61 ± |

3.03 0.66 ± 3.03 0.68 ± |

* Mittelwert, ± Standardabweichung.

Quelle: 1 Gesetze 1991. 2 Alciniet al. 1988.

Blutproben sollten vorzugsweise innerhalb von zwei Stunden nach der Exposition entnommen werden. Die Venenpunktion wird der Entnahme von Kapillarblut aus einem Finger oder Ohrläppchen vorgezogen, da die Entnahmestelle mit Pestiziden kontaminiert sein kann, die sich bei exponierten Personen auf der Haut befinden. Es werden drei aufeinanderfolgende Proben empfohlen, um für jeden Arbeiter vor der Exposition einen normalen Ausgangswert festzulegen (WHO 1982b).

Zur Bestimmung von ACHE und PCHE im Blut stehen mehrere Analysemethoden zur Verfügung. Als Referenzmethode soll laut WHO die spektrophotometrische Methode nach Ellman (Ellman et al. 1961) dienen.

Biologische Expositionsindikatoren.

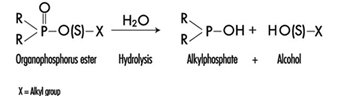

Die Bestimmung von Metaboliten im Urin, die von der Alkylphosphateinheit des OP-Moleküls stammen, oder von Rückständen, die durch die Hydrolyse der P-X-Bindung entstehen (Abbildung 1), wurde zur Überwachung der OP-Exposition verwendet.

Abbildung 1. Hydrolyse von OP-Insektiziden

Alkylphosphat-Metaboliten.

Die im Urin nachweisbaren Alkylphosphat-Metaboliten und die Hauptausgangsverbindung, von der sie abstammen können, sind in Tabelle 5 aufgeführt. Alkylphosphate im Urin sind empfindliche Indikatoren für die Exposition gegenüber OP-Verbindungen: Die Ausscheidung dieser Metaboliten im Urin ist normalerweise bei einer Expositionshöhe von nachweisbar welche Hemmung der Plasma- oder Erythrozyten-Cholinesterase nicht nachweisbar ist. Die Urinausscheidung von Alkylphosphaten wurde für verschiedene Expositionsbedingungen und für verschiedene OP-Verbindungen gemessen (Tabelle 6). Die Existenz einer Beziehung zwischen externen Dosen von OP und Alkylphosphat-Konzentrationen im Urin wurde in einigen Studien festgestellt. In einigen Studien wurde auch ein signifikanter Zusammenhang zwischen Cholinesterase-Aktivität und Alkylphosphatspiegeln im Urin nachgewiesen.

Tabelle 5. Im Urin nachweisbare Alkylphosphate als Metaboliten von OP-Pestiziden

|

Metabolite |

Abkürzung |

Hauptstammverbindungen |

|

Monomethylphosphat |

MMP |

Malathion, Parathion |

|

Dimethylphosphat |

DMP |

Dichlorvos, Trichlorfon, Mevinphos, Malaoxon, Dimethoat, Fenchlorphos |

|

Diethylphosphat |

DEP |

Paraoxon, Demeton-Oxon, Diazinon-Oxon, Dichlorfenthion |

|

Dimethylthiophosphat |

DMTP |

Fenitrothion, Fenchlorphos, Malathion, Dimethoat |

|

Diethylthiophosphat |

DETP |

Diazinon, Demethon, Parathion, Fenchlorphos |

|

Dimethyldithiophosphat |

DMDTP |

Malathion, Dimethoat, Azinphos-methyl |

|

Diethyldithiophosphat |

DEDTP |

Disulfoton, Phorat |

|

Phenylphosphorsäure |

Leptophos, EPN |

Tabelle 6. Beispiele für Konzentrationen von Alkylphosphaten im Urin, gemessen unter verschiedenen OP-Expositionsbedingungen

|

Compounds |

Bedingung der Exposition |

Expositionsweg |

Metabolitenkonzentrationen1 (mg/L) |

|

Parathion2 |

Nicht tödliche Vergiftung |

Mündlich |

DEP = 0.5 DETP = 3.9 |

|

Disulfoton2 |

Formulierer |

Dermal/Inhalation |

DEP = 0.01-4.40 DETP = 0.01–1.57 DEDTP = <0.01-05 |

|

Phorate2 |

Formulierer |

Dermal/Inhalation |

DEP = 0.02-5.14 DETP = 0.08–4.08 DEDTP = <0.01–0.43 |

|

Malathion3 |

Pflanzenschutzspritzen |

dermal |

DMDTP = <0.01 |

|

Fenitrothion3 |

Pflanzenschutzspritzen |

dermal |

DMP = 0.01-0.42 DMTP = 0.02–0.49 |

|

Monocrotophos4 |

Pflanzenschutzspritzen |

Dermal/Inhalation |

DMP = < 0.04–6.3/24 h |

1 Abkürzungen siehe Tabelle 27.12 [BMO12TE].

2 Dillon und Ho 1987.

3 Richter 1993.

4 van Sittert und Dumas 1990.

Alkylphosphate werden in der Regel innerhalb kurzer Zeit mit dem Urin ausgeschieden. Zur Metabolitenbestimmung eignen sich Proben, die kurz nach Feierabend entnommen werden.

Die Messung von Alkylphosphaten im Urin erfordert ein ziemlich ausgeklügeltes analytisches Verfahren, basierend auf der Derivatisierung der Verbindungen und dem Nachweis durch Gas-Flüssigkeits-Chromatographie (Shafik et al. 1973a; Reid und Watts 1981).

Hydrolyserückstände.

p-Nitrophenol (PNP) ist der phenolische Metabolit von Parathion, Methylparathion und Ethylparathion, EPN. Die Messung von PNP im Urin (Cranmer 1970) ist weit verbreitet und hat sich bei der Bewertung der Exposition gegenüber Parathion als erfolgreich erwiesen. PNP im Urin korreliert gut mit der absorbierten Dosis von Parathion. Bei PNP-Konzentrationen im Urin von bis zu 2 mg/l verursacht die Resorption von Parathion keine Symptome, und es wird eine geringe oder keine Verringerung der Cholinesterase-Aktivitäten beobachtet. Die Ausscheidung von PNP erfolgt schnell und die PNP-Spiegel im Urin werden 48 Stunden nach der Exposition unbedeutend. Daher sollten Urinproben bald nach der Exposition gesammelt werden.

Carbamate

Biologische Wirkungsindikatoren.

Carbamat-Pestizide umfassen Insektizide, Fungizide und Herbizide. Die Toxizität von insektiziden Carbamaten beruht auf der Hemmung von synaptischem Schmerz, während bei herbiziden und fungiziden Carbamaten andere Toxizitätsmechanismen beteiligt sind. Somit kann nur die Exposition gegenüber Carbamat-Insektiziden durch den Assay der Cholinesterase-Aktivität in roten Blutkörperchen (ACHE) oder Plasma (PCHE) überwacht werden. ACHE ist normalerweise empfindlicher gegenüber Carbamat-Inhibitoren als PCHE. Cholinerge Symptome wurden gewöhnlich bei Carbamat-exponierten Arbeitern mit einer ACHE-Aktivität im Blut von weniger als 70 % des individuellen Ausgangswertes beobachtet (WHO 1982a).

Die Hemmung von Cholinesterasen durch Carbamate ist schnell reversibel. Daher können falsch negative Ergebnisse erhalten werden, wenn zwischen Exposition und biologischer Probenahme oder zwischen Probenahme und Analyse zu viel Zeit vergeht. Um solche Probleme zu vermeiden, wird empfohlen, Blutproben innerhalb von vier Stunden nach der Exposition zu entnehmen und zu analysieren. Den Analysemethoden, die die Bestimmung der Cholinesterase-Aktivität unmittelbar nach der Blutentnahme ermöglichen, ist der Vorzug zu geben, wie für Organophosphate diskutiert.

Biologische Expositionsindikatoren.

Die Messung der Urinausscheidung von Carbamat-Metaboliten als Methode zur Überwachung der Exposition des Menschen wurde bisher nur auf wenige Verbindungen und in begrenzten Studien angewendet. Tabelle 7 fasst die relevanten Daten zusammen. Da Carbamate zeitnah mit dem Urin ausgeschieden werden, eignen sich zeitnah nach Expositionsende entnommene Proben zur Metabolitenbestimmung. Analytische Verfahren zur Messung von Carbamat-Metaboliten im Urin wurden von Dawson et al. (1964); DeBernardinis und Wargin (1982) und Verberk et al. (1990).

Tabelle 7. In Feldstudien gemessene Konzentrationen von Carbamat-Metaboliten im Urin

|

Compounds |

Biologische Kennzahl |

Bedingung der Exposition |

Umweltkonzentrationen |

Die Ergebnisse |

Bibliographie |

|

Carbaryl |

a-Naphthol a-Naphthol a-Naphthol |

Formulierer Mischer/Applikatoren nicht exponierte Bevölkerung |

0.23–0.31 mg/mXNUMX3 |

x = 18.5 mg/l1 , max. Ausscheidungsrate = 80 mg/Tag x = 8.9 mg/l, Bereich = 0.2–65 mg/l Bereich = 1.5–4 mg/l |

WER 1982a |

|

Pirimicarb |

Metaboliten I2 und V3 |

Applikatoren |

Bereich = 1–100 mg/l |

Verberk et al. 1990 |

1 Systemische Vergiftungen wurden gelegentlich berichtet.

2 2-Dimethylamino-4-hydroxy-5,6-dimethylpyrimidin.

3 2-Methylamino-4-hydroxy-5,6-dimethylpyrimidin.

x = Standardabweichung.

Dithiocarbamate

Biologische Expositionsindikatoren.

Dithiocarbamate (DTC) sind weit verbreitete Fungizide, die chemisch in drei Klassen eingeteilt werden: Thiurame, Dimethyldithiocarbamate und Ethylen-bis-dithiocarbamate.

Schwefelkohlenstoff (CS2) und sein Hauptmetabolit 2-Thiothiazolidin-4-Carbonsäure (TTCA) sind Metaboliten, die fast allen DTC gemeinsam sind. Ein signifikanter Anstieg der Urinkonzentrationen dieser Verbindungen wurde bei verschiedenen Expositionsbedingungen und bei verschiedenen DTC-Pestiziden beobachtet. Ethylenthioharnstoff (ETU) ist ein wichtiger Harnmetabolit von Ethylen-bis-dithiocarbamaten. Es kann auch als Verunreinigung in Marktformulierungen vorhanden sein. Da festgestellt wurde, dass ETU bei Ratten und anderen Arten teratogen und karzinogen ist und mit Schilddrüsentoxizität in Verbindung gebracht wurde, wurde es in großem Umfang zur Überwachung der Ethylen-bis-dithiocarbamat-Exposition eingesetzt. ETU ist nicht verbindungsspezifisch, da es von Maneb, Mancozeb oder Zineb abgeleitet sein kann.

Die Messung der im DTC vorhandenen Metalle wurde als alternativer Ansatz zur Überwachung der DTC-Exposition vorgeschlagen. Bei Mancozeb-exponierten Arbeitern wurde eine erhöhte Manganausscheidung im Urin beobachtet (Tabelle 8).

Tabelle 8. In Feldstudien gemessene Konzentrationen von Dithiocarbamat-Metaboliten im Urin

|

Compounds |

Biologische Kennzahl |

Zustand von Belichtung |

Umweltkonzentrationen* ± Standardabweichung |

Ergebnisse ± Standardabweichung |

Bibliographie |

|

Ziram |

Schwefelkohlenstoff (CS2) TTCA1 |

Formulierer Formulierer |

1.03 ± 0.62 mg/mXNUMX3 |

3.80 ± 3.70 mg/l 0.45 ± 0.37 mg/l |

Maroniet al. 1992 |

|

Maneb/Mancozeb |

ETU2 |

Applikatoren |

Bereich = < 0.2–11.8 mg/l |

Kurttio et al. 1990 |

|

|

Mancozeb |

Mangan |

Applikatoren |

57.2 mg/m3 |

Präexposition: 0.32 ± 0.23 mg/g Kreatinin; nach Exposition: 0.53 ± 0.34 mg/g Kreatinin |

Canossaet al. 1993 |

* Mittleres Ergebnis nach Maroni et al. 1992.

1 TTCA = 2-Thiothiazolidin-4-Carbonsäure.

2 ETU = Ethylenthioharnstoff.

CS2, TTCA und Mangan werden häufig im Urin nicht exponierter Personen gefunden. Daher wird die Messung der Urinspiegel dieser Verbindungen vor der Exposition empfohlen. Urinproben sollten morgens nach Beendigung der Exposition gesammelt werden. Analytische Methoden für die Messung von CS2, TTCA und ETU wurden von Maroni et al. (1992).

Synthetische Pyrethroide

Biologische Expositionsindikatoren.

Synthetische Pyrethroide sind den natürlichen Pyrethrinen ähnliche Insektizide. Metaboliten im Urin, die für die Anwendung bei der biologischen Expositionsüberwachung geeignet sind, wurden durch Studien mit freiwilligen Probanden identifiziert. Der saure Metabolit 3-(2,2'-Dichlor-vinyl)-2,2'-dimethyl-cyclopropancarbonsäure (Cl2CA) wird sowohl von Personen ausgeschieden, denen Permethrin und Cypermethrin oral verabreicht wurden, als auch von dem Bromanalog (Br2CA) von mit Deltamethrin behandelten Probanden. Bei den mit Cypermethrin behandelten Probanden wurde auch ein Phenoxymetabolit, 4-Hydroxyphenoxybenzoesäure (4-HPBA), identifiziert. Diese Tests wurden jedoch wegen der erforderlichen komplexen Analysetechniken nicht oft zur Überwachung beruflicher Expositionen eingesetzt (Eadsforth, Bragt und van Sittert 1988; Kolmodin-Hedman, Swensson und Akerblom 1982). Bei Anwendern, die Cypermethrin ausgesetzt waren, lagen die Urinspiegel von Cl2Es wurde festgestellt, dass CA im Bereich von 0.05 bis 0.18 mg/l liegt, während bei Formulierern, die a-Cypermethrin ausgesetzt waren, 4-HPBA-Konzentrationen im Urin unter 0.02 mg/l liegen.

Für Metabolitenbestimmungen wird eine 24-stündige Urinsammelperiode empfohlen, die nach Expositionsende beginnt.

Organochlore

Biologische Expositionsindikatoren.

Organochlorinsektizide (OC) wurden in den 1950er und 1960er Jahren weit verbreitet eingesetzt. Anschließend wurde die Verwendung vieler dieser Verbindungen in vielen Ländern wegen ihrer Persistenz und der daraus resultierenden Kontamination der Umwelt eingestellt.

Ein biologisches Monitoring der OC-Exposition kann durch die Bestimmung von intakten Pestiziden oder deren Metaboliten im Blut oder Serum erfolgen (Dale, Curley und Cueto 1966; Barquet, Morgade und Pfaffenberger 1981). Nach der Resorption wird Aldrin schnell zu Dieldrin metabolisiert und kann als Dieldrin im Blut gemessen werden. Endrin hat im Blut eine sehr kurze Halbwertszeit. Daher ist die Endrin-Blutkonzentration nur zur Bestimmung der jüngsten Expositionswerte von Nutzen. Auch die Bestimmung des Urinmetaboliten Anti-12-hydroxy-endrin hat sich zur Überwachung der Endrin-Exposition bewährt (van Sittert und Tordoir 1987) .

Für einige OC-Verbindungen wurden signifikante Korrelationen zwischen der Konzentration biologischer Indikatoren und dem Einsetzen toxischer Wirkungen nachgewiesen. Fälle von Toxizität aufgrund einer Aldrin- und Dieldrin-Exposition wurden mit Dieldrin-Konzentrationen im Blut über 200 μg/l in Verbindung gebracht. Als oberer kritischer Wert für neurologische Symptome wurde eine Lindankonzentration im Blut von 20 µg/l angegeben. Bei Arbeitern mit Blutendrinkonzentrationen unter 50 μg/l wurden keine akuten Nebenwirkungen berichtet. Das Fehlen früher Nebenwirkungen (Induktion von mikrosomalen Leberenzymen) wurde bei wiederholter Exposition gegenüber Endrin bei anti-12-Hydroxy-Endrin-Konzentrationen im Urin unter 130 μg/g Kreatinin und bei wiederholter Exposition gegenüber DDT bei DDT- oder DDE-Serumkonzentrationen unter 250 gezeigt μg/l.

OC kann in geringen Konzentrationen im Blut oder Urin der Allgemeinbevölkerung gefunden werden. Beispiele für beobachtete Werte sind: Lindan-Blutkonzentrationen bis 1 μg/l, Dieldrin bis 10 μg/l, DDT oder DDE bis 100 μg/l und Anti-12-hydroxy-endrin bis 1 μg/g Kreatinin. Daher wird eine Ausgangsbeurteilung vor der Exposition empfohlen.

Bei exponierten Personen sollten Blutproben unmittelbar nach dem Ende einer einzelnen Exposition entnommen werden. Bei Langzeitexposition ist der Zeitpunkt der Entnahme der Blutprobe nicht kritisch. Am Ende der Exposition sollten Urinproben zur Metabolitenbestimmung im Urin entnommen werden.

Triazine

Biologische Expositionsindikatoren.

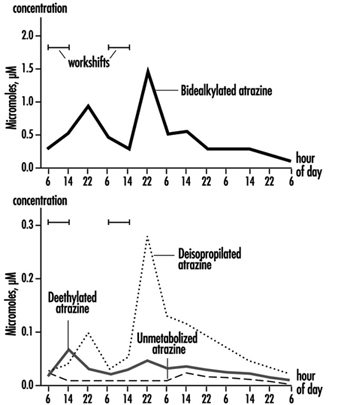

Die Messung der Urinausscheidung von Triazin-Metaboliten und der unmodifizierten Ausgangsverbindung wurde in begrenzten Studien an Probanden durchgeführt, die Atrazin ausgesetzt waren. Abbildung 2 zeigt die Ausscheidungsprofile von Atrazin-Metaboliten im Urin eines Arbeiters in der Produktion mit einer dermalen Exposition gegenüber Atrazin im Bereich von 174 bis 275 μmol/Arbeitsschicht (Catenacci et al. 1993). Da andere Chlortriazine (Simazin, Propazin, Terbuthylazin) dem gleichen Biotransformationsweg wie Atrazin folgen, können die Konzentrationen von dealkylierten Triazin-Metaboliten bestimmt werden, um die Exposition gegenüber allen Chlortriazin-Herbiziden zu überwachen.

Abbildung 2. Urinausscheidungsprofile von Atrazin-Metaboliten

Die Bestimmung nicht modifizierter Verbindungen im Urin kann als qualitative Bestätigung der Art der Verbindung, die die Exposition verursacht hat, nützlich sein. Für die Metabolitenbestimmung wird eine 24-Stunden-Urinsammelperiode empfohlen, die zu Beginn der Exposition beginnt.

Kürzlich wurde unter Verwendung eines enzymgebundenen Immunadsorptionstests (ELISA-Test) ein Mercaptursäurekonjugat von Atrazin als sein Hauptmetabolit im Urin bei exponierten Arbeitern identifiziert. Diese Verbindung wurde in Konzentrationen gefunden, die mindestens zehnmal höher sind als die aller dealkylierten Produkte. Ein Zusammenhang zwischen der kumulativen dermalen und inhalativen Exposition und der Gesamtmenge des über einen Zeitraum von 10 Tagen ausgeschiedenen Mercaptursäure-Konjugats wurde beobachtet (Lucas et al. 10).

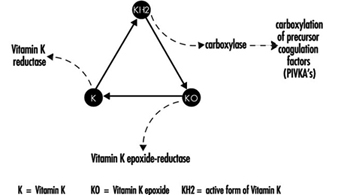

Cumarin-Derivate

Biologische Wirkungsindikatoren.

Cumarin-Rodentizide hemmen die Aktivität der Enzyme des Vitamin-K-Zyklus in der Leber von Säugetieren einschließlich des Menschen (Abbildung 3) und bewirken so eine dosisabhängige Verringerung der Synthese von Vitamin-K-abhängigen Gerinnungsfaktoren, nämlich Faktor II (Prothrombin) , VII, IX und X. Antikoagulatorische Wirkungen treten auf, wenn die Plasmaspiegel der Gerinnungsfaktoren unter etwa 20 % des Normalwerts gefallen sind.

Abbildung 3. Vitamin-K-Zyklus

Diese Vitamin-K-Antagonisten wurden in Verbindungen der sogenannten „ersten Generation“ (z. B. Warfarin) und der „zweiten Generation“ (z. B. Brodifacoum, Difenacoum) eingeteilt, wobei letztere durch eine sehr lange biologische Halbwertszeit (100 bis 200 Tage) gekennzeichnet sind ).

Die Bestimmung der Prothrombinzeit wird häufig zur Überwachung der Exposition gegenüber Cumarinen verwendet. Dieser Test reagiert jedoch nur auf eine Abnahme des Gerinnungsfaktors um etwa 20 % der normalen Plasmaspiegel. Der Test ist nicht geeignet, um frühe Wirkungen einer Exposition zu erkennen. Zu diesem Zweck wird die Bestimmung der Prothrombinkonzentration im Plasma empfohlen.

Diese Tests könnten in Zukunft durch die Bestimmung von Gerinnungsfaktorvorläufern (PIVKA) ersetzt werden, also Substanzen, die nur bei einer Blockade des Vitamin-K-Kreislaufs durch Cumarine im Blut nachweisbar sind.

Bei längerer Exposition ist der Zeitpunkt der Blutentnahme nicht kritisch. Bei akuter Überexposition sollte wegen der Latenz der gerinnungshemmenden Wirkung ein biologisches Monitoring für mindestens fünf Tage nach dem Ereignis durchgeführt werden. Um die Sensitivität dieser Tests zu erhöhen, wird die Messung der Ausgangswerte vor der Exposition empfohlen.

Biologische Expositionsindikatoren.

Die Messung von unmodifizierten Cumarinen im Blut wurde als Test zur Überwachung der menschlichen Exposition vorgeschlagen. Die Erfahrung mit der Anwendung dieser Indizes ist jedoch sehr begrenzt, hauptsächlich weil die analytischen Techniken viel komplexer (und weniger standardisiert) sind im Vergleich zu denen, die zur Überwachung der Auswirkungen auf das Gerinnungssystem erforderlich sind (Chalermchaikit, Felice und Murphy 1993).

Phenoxy-Herbizide

Biologische Expositionsindikatoren.

Phenoxy-Herbizide werden in Säugetieren kaum biotransformiert. Beim Menschen werden mehr als 95 % einer Dosis von 2,4-Dichlorphenoxyessigsäure (2,4-D) innerhalb von fünf Tagen unverändert im Urin ausgeschieden, und 2,4,5-Trichlorphenoxyessigsäure (2,4,5-T) und 4-Chlor-2-methylphenoxyessigsäure (MCPA) werden innerhalb weniger Tage nach oraler Aufnahme ebenfalls größtenteils unverändert über den Urin ausgeschieden. Die Messung unveränderter Verbindungen im Urin wurde zur Überwachung der beruflichen Exposition gegenüber diesen Herbiziden angewendet. In Feldstudien wurden Werte im Urin von exponierten Arbeitern im Bereich von 0.10 bis 8 μg/l für 2,4-D, von 0.05 bis 4.5 μg/l für 2,4,5-T und von unter 0.1 μg/l gefunden auf 15 μg/l für MCPA. Für die Bestimmung unveränderter Verbindungen wird eine 24-stündige Urinsammlung ab Expositionsende empfohlen. Analytische Verfahren zur Messung von Phenoxy-Herbiziden im Urin wurden von Draper (1982) beschrieben.

Quartäre Ammoniumverbindungen

Biologische Expositionsindikatoren.

Diquat und Paraquat sind vom menschlichen Organismus kaum biotransformierbare Herbizide. Aufgrund ihrer hohen Wasserlöslichkeit werden sie ohne Weiteres unverändert im Urin ausgeschieden. Bei Paraquat-exponierten Arbeitern wurden häufig Urinkonzentrationen unterhalb der analytischen Nachweisgrenze (0.01 μg/l) beobachtet; während in tropischen Ländern nach unsachgemäßem Umgang mit Paraquat Konzentrationen bis zu 0.73 μg/l gemessen wurden. Diquat-Konzentrationen im Urin unter der analytischen Nachweisgrenze (0.047 μg/l) wurden bei Personen mit dermaler Exposition von 0.17 bis 1.82 μg/h und inhalativer Exposition von weniger als 0.01 μg/h berichtet. Idealerweise sollte eine 24-Stunden-Urinprobenahme am Ende der Exposition für die Analyse verwendet werden. Wenn dies nicht praktikabel ist, kann eine Stichprobe am Ende des Arbeitstages verwendet werden.

Die Bestimmung des Paraquat-Spiegels im Serum ist für prognostische Zwecke im Falle einer akuten Vergiftung nützlich: Patienten mit Serum-Paraquat-Spiegeln von bis zu 0.1 μg/l XNUMX Stunden nach der Einnahme werden wahrscheinlich überleben.

Die analytischen Methoden zur Bestimmung von Paraquat und Diquat wurden von Summers (1980) zusammengefasst.

Verschiedene Pestizide

4,6-Dinitro-o-kresol (DNOC).

DNOC ist ein Herbizid, das 1925 eingeführt wurde, aber die Verwendung dieser Verbindung wurde aufgrund ihrer hohen Toxizität für Pflanzen und Menschen zunehmend verringert. Da die Blut-DNOC-Konzentrationen bis zu einem gewissen Grad mit der Schwere gesundheitlicher Beeinträchtigungen korrelieren, wurde die Messung von unverändertem DNOC im Blut zur Überwachung beruflicher Expositionen und zur Beurteilung des klinischen Verlaufs von Vergiftungen vorgeschlagen.

Pentachlorphenol.

Pentachlorphenol (PCP) ist ein Breitbandbiozid mit pestizider Wirkung gegen Unkräuter, Insekten und Pilze. Messungen von unverändertem PCP im Blut oder Urin wurden als geeignete Indizes zur Überwachung beruflicher Expositionen empfohlen (Colosio et al. 1993), da diese Parameter signifikant mit der PCP-Körperbelastung korrelieren. Bei Arbeitern mit längerer PCP-Exposition ist der Zeitpunkt der Blutentnahme nicht kritisch, während Urinfleckproben am Morgen nach der Exposition entnommen werden sollten.

Eine Methode mit mehreren Rückständen zur Messung von halogenierten und nitrophenolischen Pestiziden wurde von Shafik et al. (1973b) beschrieben.

Andere Tests, die für die biologische Überwachung der Pestizidexposition vorgeschlagen werden, sind in Tabelle 9 aufgeführt.

Tabelle 9. Andere in der Literatur vorgeschlagene Indizes für die biologische Überwachung der Pestizidexposition

|

Compounds |

Biologische Kennzahl |

|

|

Urin |

Blut |

|

|

Bromophos |

Bromophos |

Bromophos |

|

Captan |

Tetrahydrophthalimid |

|

|

Carbofuran |

3-Hydroxycarbofuran |

|

|

Chlordimeform |

4-Chlor-o-Toluidinderivate |

|

|

Chlorbenzilat |

p,p-1-Dichlorbenzophenon |

|

|

Dichlorpropen |

Mercaptursäure-Metabolite |

|

|

Fenitrothion |

p-Nitrokresol |

|

|

Ferbam |

Thirami |

|

|

Fluazifop-Butyl |

Fluazifop |

|

|

Flufenoxuron |

Flufenoxuron |

|

|

Glyphosat |

Glyphosat |

|

|

Malathion |

Malathion |

Malathion |

|

Organozinnverbindungen |

Zinn |

Zinn |

|

Trifenomorph |

Morpholin, Triphenylcarbinol |

|

|

Ziram |

Thirami |

|

Schlussfolgerungen

Biologische Indikatoren zur Überwachung der Pestizidexposition wurden in einer Reihe von experimentellen und Feldstudien angewendet.

Einige Tests, wie die für Cholinesterase im Blut oder für ausgewählte unmodifizierte Pestizide im Urin oder Blut, wurden durch umfangreiche Erfahrung validiert. Für diese Tests wurden Grenzwerte für die biologische Exposition vorgeschlagen (Tabelle 10). Andere Tests, insbesondere solche für Metabolite aus Blut oder Urin, unterliegen größeren Einschränkungen aufgrund von analytischen Schwierigkeiten oder aufgrund von Einschränkungen bei der Interpretation der Ergebnisse.

Tabelle 10. Empfohlene biologische Grenzwerte (Stand 1996)

|

Compounds |

Biologische Kennzahl |

BEI1 |

BAT2 |

HBBL3 |

BLV4 |

|

ACHE-Hemmer |

SCHMERZ im Blut |

70% |

70% |

70%, |

|

|

DNOC |

DNOC im Blut |

20mg/l, |

|||

|

Lindan |

Lindan im Blut |

0.02mg / l |

0.02mg / l |

||

|

Parathion |

PNP im Urin |

0.5mg / l |

0.5mg / l |

||

|

Pentachlorphenol (PCP) |

PCP im Urin PCP im Plasma |

2 mg / l 5 mg / l |

0.3mg / l 1 mg / l |

||

|

Dieldrin/Aldrin |

Dieldrin im Blut |

100 mg / l |

|||

|

Endrin |

Anti-12-Hydroxy-Endrin im Urin |

130 mg / l |

|||

|

DDT |

DDT- und DDEin-Serum |

250 mg / l |

|||

|

Cumarine |

Prothrombinzeit im Plasma Prothrombinkonzentration im Plasma |

10 % über dem Ausgangswert 60 % der Basis |

|||

|

MCPA |

MCPA im Urin |

0.5 mg / l |

|||

|

2,4-D |

2,4-D im Urin |

0.5 mg / l |

1 Biologische Expositionsindizes (BEIs) werden von der American Conference of Governmental Industrial Hygienists (ACGIH 1995) empfohlen.

2 Biologische Toleranzwerte (BVT) werden von der Deutschen Kommission zur Untersuchung gesundheitsgefährdender Arbeitsstoffe (DFG 1992) empfohlen.

3 Health-based Biological Limits (HBBLs) werden von einer WHO-Studiengruppe empfohlen (WHO 1982a).

4 Biologische Grenzwerte (BLVs) werden von einer Studiengruppe des Wissenschaftlichen Ausschusses für Pestizide der Internationalen Kommission für Arbeitsmedizin vorgeschlagen (Tordoir et al. 1994). Wird dieser Wert überschritten, ist eine Bewertung der Arbeitsbedingungen erforderlich.

Dieser Bereich befindet sich in einer rasanten Entwicklung, und angesichts der enormen Bedeutung der Verwendung biologischer Indikatoren zur Bewertung der Exposition gegenüber diesen Stoffen werden ständig neue Tests entwickelt und validiert.

Epidemiologische Methode für Arbeitssicherheit und Gesundheitsschutz

Epidemiologie

Die Epidemiologie ist sowohl als wissenschaftliche Grundlage der Präventivmedizin als auch als Grundlage für den Prozess der öffentlichen Gesundheitspolitik anerkannt. Es wurden mehrere operative Definitionen der Epidemiologie vorgeschlagen. Die einfachste ist, dass Epidemiologie die Untersuchung des Auftretens von Krankheiten oder anderen gesundheitsbezogenen Merkmalen in Menschen- und Tierpopulationen ist. Epidemiologen untersuchen nicht nur die Häufigkeit von Krankheiten, sondern ob sich die Häufigkeit zwischen Personengruppen unterscheidet; dh sie untersuchen die Ursache-Wirkungs-Beziehung zwischen Exposition und Krankheit. Krankheiten treten nicht zufällig auf; sie haben Ursachen – sehr oft menschengemachte Ursachen – die vermeidbar sind. So könnten viele Krankheiten verhindert werden, wenn die Ursachen bekannt wären. Die Methoden der Epidemiologie waren entscheidend für die Identifizierung vieler ursächlicher Faktoren, die wiederum zu einer Gesundheitspolitik geführt haben, die darauf abzielt, Krankheiten, Verletzungen und vorzeitigen Tod zu verhindern.

Welche Aufgabe hat die Epidemiologie und wo liegen ihre Stärken und Schwächen, wenn Definitionen und Konzepte der Epidemiologie auf den betrieblichen Gesundheitsschutz übertragen werden? Dieses Kapitel befasst sich mit diesen Fragen und den Möglichkeiten, wie arbeitsbedingte Gesundheitsgefahren mit epidemiologischen Methoden untersucht werden können. Dieser Artikel stellt die Ideen vor, die in aufeinanderfolgenden Artikeln in diesem Kapitel zu finden sind.

Berufsepidemiologie

Berufsepidemiologie ist definiert als die Untersuchung der Auswirkungen von Expositionen am Arbeitsplatz auf die Häufigkeit und Verbreitung von Krankheiten und Verletzungen in der Bevölkerung. Sie ist damit eine expositionsorientierte Disziplin mit Bezügen sowohl zur Epidemiologie als auch zur Arbeitsmedizin (Checkoway et al. 1989). Als solche verwendet sie Methoden, die denen der Epidemiologie im Allgemeinen ähneln.

Das Hauptziel der Arbeitsepidemiologie ist die Prävention durch die Ermittlung der gesundheitlichen Folgen von Expositionen am Arbeitsplatz. Dies unterstreicht den präventiven Fokus der Arbeitsepidemiologie. Tatsächlich sollte jede Forschung auf dem Gebiet des Arbeitsschutzes präventiven Zwecken dienen. Daher kann und sollte epidemiologisches Wissen leicht umsetzbar sein. Während das Interesse der öffentlichen Gesundheit immer das Hauptanliegen der epidemiologischen Forschung sein sollte, können Interessengruppen Einfluss nehmen, und es muss darauf geachtet werden, diesen Einfluss auf die Formulierung, Durchführung und/oder Interpretation von Studien zu minimieren (Soskolne 1985; Soskolne 1989).

Ein zweites Ziel der Berufsepidemiologie ist es, Ergebnisse aus spezifischen Settings zu nutzen, um Gefährdungen in der Bevölkerung insgesamt zu reduzieren oder zu eliminieren. Daher spielen die Ergebnisse aus berufsepidemiologischen Studien nicht nur Informationen über die gesundheitlichen Auswirkungen von Expositionen am Arbeitsplatz, sondern auch eine Rolle bei der Einschätzung des Risikos, das mit denselben Expositionen verbunden ist, jedoch auf dem niedrigeren Niveau, das die allgemeine Bevölkerung allgemein erfährt. Umweltverschmutzung durch industrielle Prozesse und Produkte würde normalerweise zu geringeren Expositionsniveaus führen als am Arbeitsplatz.

Die Anwendungsebenen der Berufsepidemiologie sind:

- Überwachung, um das Auftreten von Krankheiten in verschiedenen Kategorien von Arbeitnehmern zu beschreiben und so Frühwarnsignale für unerkannte Berufsgefahren zu liefern

- Generierung und Prüfung einer Hypothese, dass eine bestimmte Exposition schädlich sein kann, und die Quantifizierung einer Wirkung

- Bewertung einer Intervention (z. B. einer vorbeugenden Maßnahme wie der Reduzierung von Expositionswerten) durch Messung der Veränderungen des Gesundheitszustands einer Bevölkerung im Laufe der Zeit.

Die ursächliche Rolle, die berufsbedingte Expositionen bei der Entstehung von Krankheiten, Verletzungen und vorzeitigem Tod spielen können, wurde schon vor langer Zeit erkannt und ist Teil der Geschichte der Epidemiologie. Hinzuweisen ist auf Bernardino Ramazzini, Begründer der Arbeitsmedizin und einer der ersten, der die hippokratische Tradition der Abhängigkeit der Gesundheit von identifizierbaren natürlichen äußeren Faktoren wiederbelebte und ergänzte. Im Jahr 1700 schrieb er in seinem „De Morbis Artificum Diatriba“ (Ramazzini 1705; Saracci 1995):

Der Arzt muss den Patienten viele Fragen stellen. Hippokrates erklärt in De Affectionibus: „Wenn Sie einem Kranken gegenüberstehen, sollten Sie ihn fragen, woran er leidet, aus welchem Grund, seit wie vielen Tagen, was er isst und wie sein Stuhlgang ist. Zu all diesen Fragen sollte noch eine hinzugefügt werden: ‚Welche Arbeit macht er?‘.“

Dieses Wiedererwachen der klinischen Beobachtung und der Aufmerksamkeit für die Umstände des Auftretens von Krankheiten veranlasste Ramazzini, viele Berufskrankheiten zu identifizieren und zu beschreiben, die später von Arbeitsmedizinern und Epidemiologen untersucht wurden.

Mit diesem Ansatz berichtete Pott erstmals 1775 (Pott 1775) über die mögliche Verbindung zwischen Krebs und Beruf (Clayson 1962). Seine Beobachtungen zum Hodensackkrebs bei Schornsteinfegern begannen mit einer Beschreibung der Krankheit und setzten sich fort:

Das Schicksal dieser Menschen scheint einzigartig hart: In ihrer frühen Kindheit werden sie am häufigsten mit großer Brutalität behandelt und vor Kälte und Hunger fast ausgehungert; sie werden in enge und manchmal heiße Schornsteine geschoben, wo sie verletzt, verbrannt und fast erstickt werden; und wenn sie die Pubertät erreichen, werden sie besonders anfällig für eine höchst lästige, schmerzhafte und tödliche Krankheit.

Über diesen letzten Umstand gibt es nicht den geringsten Zweifel, obgleich vielleicht nicht ausreichend darauf geachtet wurde, um ihn allgemein bekannt zu machen. Andere Menschen haben Krebs der gleichen Teile; und so haben andere, außer Bleiarbeitern, die Poitou-Kolik und die daraus resultierende Lähmung; aber es ist dennoch eine Krankheit, für die sie besonders anfällig sind; und Schornsteinfeger zu Hoden- und Hodenkrebs.

Die Krankheit scheint bei diesen Menschen ihren Ursprung in einer Rußablagerung in der Hodensackfalte zu haben und zunächst keine Gewohnheitskrankheit zu sein … aber hier sind die Probanden jung, im Allgemeinen zumindest bei guter Gesundheit zunaechst; die Krankheit, die ihnen durch ihren Beruf zugefügt wurde, und aller Wahrscheinlichkeit nach lokal; welcher letzte Umstand kann, denke ich, ziemlich davon ausgegangen werden, dass er immer dieselben Teile ergreift; All dies macht es (zunächst) zu einem ganz anderen Fall als ein Krebs, der bei einem älteren Mann auftritt.

Dieser erste Bericht über einen Berufskrebs bleibt immer noch ein Musterbeispiel an Klarheit. Die Art der Krankheit, der betroffene Beruf und der wahrscheinliche Erreger sind klar definiert. Es wird eine erhöhte Inzidenz von Hodenkrebs bei Schornsteinfegern festgestellt, obwohl keine quantitativen Daten zur Untermauerung dieser Behauptung vorgelegt werden.

Weitere fünfzig Jahre vergingen, bis Ayrton-Paris 1822 (Ayrton-Paris 1822) die häufige Entwicklung von Hodenkrebs bei den Kupfer- und Zinnhütten von Cornwall bemerkte und vermutete, dass Arsendämpfe die Ursache sein könnten. Von Volkmann berichtete 1874 von Hauttumoren bei Paraffinarbeitern in Sachsen, und kurz darauf schlug Bell 1876 vor, dass Schieferöl für Hautkrebs verantwortlich sei (Von Volkmann 1874; Bell 1876). Berichte über die berufliche Entstehung von Krebs wurden dann relativ häufiger (Clayson 1962).

Zu den frühen Beobachtungen von Berufskrankheiten gehörte das vermehrte Auftreten von Lungenkrebs bei Schneeberger Bergleuten (Harting und Hesse 1879). Es ist bemerkenswert (und tragisch), dass eine aktuelle Fallstudie zeigt, dass die Lungenkrebsepidemie in Schneeberg mehr als ein Jahrhundert nach der ersten Beobachtung im Jahr 1879 immer noch ein großes Problem für die öffentliche Gesundheit darstellt. Ein Ansatz zur Identifizierung einer „Zunahme“ von Krankheiten und sogar zu quantifizieren, war in der Geschichte der Arbeitsmedizin präsent. Wie beispielsweise Axelson (1994) betonte, untersuchte WA Guy 1843 die „Lungenschwindsucht“ bei Buchdruckern und fand ein höheres Risiko bei Setzern als bei Druckern; Dies geschah durch Anwendung eines dem Fall-Kontroll-Ansatz ähnlichen Designs (Lilienfeld und Lilienfeld 1979). Dennoch begann sich die moderne Berufsepidemiologie und ihre Methodik erst in den frühen 1950er Jahren zu entwickeln. Wichtige Beiträge zu dieser Entwicklung waren die Studien über Blasenkrebs bei Färbereiarbeitern (Case und Hosker 1954) und Lungenkrebs bei Gasarbeitern (Doll 1952).

Probleme der Berufsepidemiologie

Die Artikel in diesem Kapitel stellen sowohl die Philosophie als auch die Werkzeuge der epidemiologischen Untersuchung vor. Sie konzentrieren sich auf die Bewertung der Expositionserfahrung von Arbeitnehmern und auf die Krankheiten, die in diesen Bevölkerungsgruppen auftreten. Probleme beim Ziehen gültiger Schlussfolgerungen über mögliche ursächliche Zusammenhänge auf dem Weg von der Exposition gegenüber gefährlichen Stoffen bis zur Entstehung von Krankheiten werden in diesem Kapitel behandelt.

Den Kern der Berufsepidemiologie bildet die Erhebung der individuellen Expositionserfahrung im Arbeitsleben. Die Aussagekraft einer epidemiologischen Studie hängt in erster Linie von der Qualität und dem Umfang der verfügbaren Expositionsdaten ab. Zweitens müssen die gesundheitlichen Auswirkungen (oder die Krankheiten), die für den Berufsepidemiologen von Belang sind, für eine klar definierte und zugängliche Gruppe von Arbeitnehmern genau bestimmbar sein. Schließlich sollten dem Epidemiologen Daten über andere potenzielle Einflüsse auf die interessierende Krankheit zur Verfügung stehen, damit alle aus der Studie ermittelten Wirkungen der beruflichen Exposition der beruflichen Exposition zugeschrieben werden können an sich eher als auf andere bekannte Ursachen der betreffenden Krankheit. In einer Gruppe von Arbeitnehmern, die möglicherweise mit einer Chemikalie arbeiten, von der vermutet wird, dass sie Lungenkrebs verursacht, haben einige Arbeitnehmer möglicherweise auch eine Vorgeschichte des Tabakrauchens, einer weiteren Ursache für Lungenkrebs. In der letzteren Situation müssen Arbeitsepidemiologen feststellen, welche Exposition (oder welcher Risikofaktor – die Chemikalie oder der Tabak oder sogar beides in Kombination) für eine Erhöhung des Lungenkrebsrisikos in der Gruppe der Arbeitnehmer verantwortlich ist studiert.

Expositionsabschätzung

Wenn eine Studie nur Zugriff auf die Tatsache hat, dass ein Arbeitnehmer in einer bestimmten Branche beschäftigt war, können die Ergebnisse einer solchen Studie gesundheitliche Auswirkungen nur mit dieser Branche in Verbindung bringen. Auch wenn für die Berufe der Arbeitnehmer Kenntnisse über die Exposition vorliegen, können nur in Bezug auf die Berufe direkt Rückschlüsse gezogen werden. Es können indirekte Rückschlüsse auf chemische Expositionen gezogen werden, aber ihre Zuverlässigkeit muss von Situation zu Situation bewertet werden. Wenn eine Studie jedoch Zugang zu Informationen über die Abteilung und/oder Berufsbezeichnung jedes Arbeitnehmers hat, können Rückschlüsse auf diese feinere Ebene der Arbeitsplatzerfahrung gezogen werden. Wenn dem Epidemiologen (in Zusammenarbeit mit einem Industriehygieniker) Informationen über die tatsächlichen Substanzen bekannt sind, mit denen eine Person arbeitet, dann wäre dies die beste verfügbare Ebene von Expositionsinformationen, da selten verfügbare Dosimetrien fehlen. Darüber hinaus können die Ergebnisse solcher Studien der Industrie nützlichere Informationen zur Schaffung sicherer Arbeitsplätze liefern.

Die Epidemiologie war bisher eine Art „Black Box“-Disziplin, weil sie die Beziehung zwischen Exposition und Krankheit (den beiden Extremen der Kausalkette) untersuchte, ohne die mechanistischen Zwischenschritte zu berücksichtigen. Dieser Ansatz war trotz seines offensichtlichen Mangels an Verfeinerung äußerst nützlich: Tatsächlich wurden beispielsweise alle bekannten Ursachen von Krebs beim Menschen mit den Werkzeugen der Epidemiologie entdeckt.

Die epidemiologische Methode basiert auf verfügbaren Aufzeichnungen – Fragebögen, Berufsbezeichnungen oder anderen „Proxies“ der Exposition; dies macht die Durchführung epidemiologischer Studien und die Interpretation ihrer Ergebnisse relativ einfach.

Die Grenzen des groberen Ansatzes zur Expositionsbewertung sind jedoch in den letzten Jahren deutlich geworden, da Epidemiologen vor komplexeren Problemen stehen. Beschränken wir unsere Betrachtung auf die berufliche Krebsepidemiologie, so wurden die meisten bekannten Risikofaktoren aufgrund der hohen Exposition in der Vergangenheit entdeckt; eine begrenzte Anzahl von Aufnahmen für jeden Job; große Populationen exponierter Arbeiter; und eine eindeutige Übereinstimmung zwischen „Proxy“-Informationen und Expositionen gegenüber Chemikalien (z. B. Schuharbeiter und Benzol, Werften und Asbest usw.). Heutzutage ist die Situation wesentlich anders: Die Expositionsniveaus sind in den westlichen Ländern erheblich niedriger (diese Einschränkung sollte immer betont werden); Arbeitnehmer sind in derselben Berufsbezeichnung vielen verschiedenen Chemikalien und Mischungen ausgesetzt (z. B. Landarbeiter); homogene Populationen exponierter Arbeitnehmer sind schwieriger zu finden und in der Regel zahlenmäßig klein; und die Übereinstimmung zwischen „Proxy“-Informationen und tatsächlicher Exposition wird zunehmend schwächer. In diesem Zusammenhang haben die Werkzeuge der Epidemiologie aufgrund der Fehlklassifizierung der Exposition eine reduzierte Sensitivität.

Darüber hinaus hat sich die Epidemiologie in den meisten Kohortenstudien auf „harte“ Endpunkte wie den Tod verlassen. Arbeitnehmer ziehen es jedoch möglicherweise vor, etwas anderes als „Körperzahlen“ zu sehen, wenn die potenziellen gesundheitlichen Auswirkungen beruflicher Expositionen untersucht werden. Daher hätte die Verwendung direkterer Indikatoren sowohl für die Exposition als auch für die frühe Reaktion einige Vorteile. Biologische Marker können nur ein Werkzeug sein.

Biologische Marker

Die Verwendung von biologischen Markern, wie beispielsweise Bleiwerten in Blut- oder Leberfunktionstests, ist in der Arbeitsepidemiologie nicht neu. Der Einsatz molekularer Techniken in epidemiologischen Studien hat jedoch die Verwendung von Biomarkern zur Bewertung der Exposition gegenüber Zielorganen, zur Bestimmung der Anfälligkeit und zur Feststellung früher Erkrankungen ermöglicht.

Einsatzmöglichkeiten von Biomarkern im Rahmen der Berufsepidemiologie sind:

- Expositionsbewertung in Fällen, in denen traditionelle epidemiologische Instrumente nicht ausreichen (insbesondere bei niedrigen Dosen und niedrigen Risiken)

- die ursächliche Rolle einzelner chemischer Agenzien oder Substanzen bei Mehrfachexposition oder Mischungen zu entwirren

- Abschätzung der Gesamtbelastung durch Chemikalien mit demselben mechanistischen Ziel

- Untersuchung pathogenetischer Mechanismen

- Untersuchung der individuellen Anfälligkeit (z. B. metabolische Polymorphismen, DNA-Reparatur) (Vineis 1992)

- Exposition und/oder Krankheit genauer zu klassifizieren und damit die Aussagekraft der Statistik zu erhöhen.

In der wissenschaftlichen Gemeinschaft ist große Begeisterung über diese Verwendungen entstanden, aber, wie oben erwähnt, sollte die methodische Komplexität der Verwendung dieser neuen „molekularen Werkzeuge“ dazu dienen, vor übermäßigem Optimismus zu warnen. Biomarker für chemische Belastungen (wie DNA-Addukte) haben mehrere Mängel:

- Sie spiegeln in der Regel aktuelle Expositionen wider und sind daher in Fall-Kontroll-Studien von begrenztem Nutzen, während sie für die Verwendung in Kohortenuntersuchungen wiederholte Probenahmen über längere Zeiträume erfordern.

- Obwohl sie sehr spezifisch sein können und somit die Fehleinstufung der Exposition verbessern, bleiben die Ergebnisse oft schwer zu interpretieren.

- Wenn komplexe chemische Belastungen untersucht werden (z. B. Luftverschmutzung oder Tabakrauch in der Umwelt), ist es möglich, dass der Biomarker eine bestimmte Komponente des Gemischs widerspiegelt, während die biologische Wirkung auf eine andere zurückzuführen sein könnte.

- In vielen Situationen ist nicht klar, ob ein Biomarker eine relevante Exposition, ein Korrelat der relevanten Exposition, eine individuelle Anfälligkeit oder ein frühes Krankheitsstadium widerspiegelt, wodurch kausale Rückschlüsse eingeschränkt werden.

- Die Bestimmung der meisten Biomarker erfordert einen teuren Test oder ein invasives Verfahren oder beides, wodurch Einschränkungen für eine angemessene Studiengröße und statistische Aussagekraft entstehen.

- Ein Biomarker der Exposition ist nur ein Stellvertreter für das eigentliche Ziel einer epidemiologischen Untersuchung, die in der Regel auf eine vermeidbare Umweltexposition abzielt (Trichopoulos 1995; Pearce et al. 1995).

Noch wichtiger als die methodischen Mängel ist die Überlegung, dass molekulare Techniken uns dazu veranlassen könnten, unseren Fokus von der Identifizierung von Risiken in der exogenen Umgebung auf die Identifizierung von Personen mit hohem Risiko umzulenken und dann personalisierte Risikobewertungen durch Messung von Phänotyp, Adduktbelastung und erworbenen Mutationen vorzunehmen. Dies würde unseren Fokus, wie von McMichael angemerkt, auf eine Form der klinischen Bewertung lenken, anstatt auf eine Epidemiologie der öffentlichen Gesundheit. Die Konzentration auf Einzelpersonen könnte uns von dem wichtigen Ziel der öffentlichen Gesundheit ablenken, eine weniger gefährliche Umgebung zu schaffen (McMichael 1994).

Zwei weitere wichtige Fragen ergeben sich in Bezug auf die Verwendung von Biomarkern:

- Der Einsatz von Biomarkern in der Berufsepidemiologie muss von einer klaren Politik der informierten Einwilligung begleitet werden. Der Arbeitnehmer kann mehrere Gründe haben, die Zusammenarbeit abzulehnen. Ein sehr praktischer Grund ist, dass die Identifizierung von beispielsweise einer Veränderung eines frühen Reaktionsmarkers wie Schwesterchromatidaustausch die Möglichkeit einer Diskriminierung durch Kranken- und Lebensversicherer und durch Arbeitgeber impliziert, die den Arbeitnehmer möglicherweise meiden, weil er oder sie möglicherweise anfälliger ist zu Krankheit. Ein zweiter Grund betrifft das genetische Screening: Da die Verteilung von Genotypen und Phänotypen je nach ethnischer Gruppe unterschiedlich ist, könnten die Beschäftigungsmöglichkeiten für Minderheiten durch das genetische Screening behindert werden. Drittens können Zweifel an der Vorhersagbarkeit von Gentests geäußert werden: Da der Vorhersagewert von der Prävalenz der Erkrankung abhängt, die der Test identifizieren soll, ist der Vorhersagewert gering, wenn letztere selten ist, und der praktische Nutzen des Screenings Test wird fraglich sein. Bisher wurde keiner der genetischen Screening-Tests als im Feld anwendbar beurteilt (Ashford et al. 1990).

- Vor dem Einsatz von Biomarkern müssen ethische Grundsätze beachtet werden. Diese Grundsätze wurden von einer interdisziplinären Arbeitsgruppe des Technischen Büros der Europäischen Gewerkschaften mit Unterstützung der Kommission der Europäischen Gemeinschaften für Biomarker zur Identifizierung individueller Krankheitsanfälligkeit evaluiert (Van Damme et al. 1995); Ihr Bericht hat die Ansicht bekräftigt, dass Tests nur mit dem Ziel durchgeführt werden können, Krankheiten bei einer Belegschaft vorzubeugen. Unter anderem müssen Tests verwendet werden hört niemals .

- dienen als Mittel zur „Auswahl der Stärksten“

- verwendet werden, um die Umsetzung wirksamer Präventivmaßnahmen zu vermeiden, wie z. B. die Identifizierung und Substitution von Risikofaktoren oder Verbesserungen der Bedingungen am Arbeitsplatz

- soziale Ungleichheit schaffen, bestätigen oder verstärken

- eine Kluft zwischen den am Arbeitsplatz befolgten ethischen Grundsätzen und den ethischen Grundsätzen schaffen, die in einer demokratischen Gesellschaft aufrechterhalten werden müssen

- eine Person, die eine Stelle sucht, dazu verpflichten, personenbezogene Daten offenzulegen, die nicht unbedingt für die Erlangung der Stelle erforderlich sind.

Schließlich mehren sich die Hinweise darauf, dass die metabolische Aktivierung oder Inaktivierung gefährlicher Substanzen (insbesondere von Karzinogenen) in menschlichen Populationen sehr unterschiedlich und teilweise genetisch bedingt ist. Darüber hinaus kann die interindividuelle Variabilität der Anfälligkeit gegenüber Karzinogenen bei geringer beruflicher und umweltbedingter Exposition besonders wichtig sein (Vineis et al. 1994). Solche Erkenntnisse können Regulierungsentscheidungen stark beeinflussen, die den Risikobewertungsprozess auf die anfälligsten Personen konzentrieren (Vineis und Martone 1995).

Studiendesign und Validität

Hernbergs Artikel über epidemiologische Studiendesigns und ihre Anwendung in der Arbeitsmedizin konzentriert sich auf das Konzept der „Studienbasis“, definiert als die Morbiditätserfahrung (in Bezug auf eine bestimmte Exposition) einer Bevölkerung, während sie im Laufe der Zeit verfolgt wird. Die Untersuchungsgrundlage ist also nicht nur eine Population (also eine Personengruppe), sondern die Erfahrung des Krankheitsgeschehens dieser Population in einem bestimmten Zeitraum (Miettinen 1985, Hernberg 1992). Wenn dieses vereinheitlichende Konzept einer Studienbasis übernommen wird, ist es wichtig zu erkennen, dass die unterschiedlichen Studiendesigns (z. B. Fall-Kontroll- und Kohortendesigns) einfach unterschiedliche Arten der „Ernte“ von Informationen sowohl über die Exposition als auch über die Krankheit aus derselben Studie sind Base; es handelt sich nicht um diametral unterschiedliche Ansätze.

Der Artikel zur Validität im Studiendesign von Sasco befasst sich mit Definitionen und der Bedeutung von Confounding. Studienforscher müssen bei berufsbezogenen Studien immer die Möglichkeit von Confounding berücksichtigen, und es kann nie genug betont werden, dass die Identifizierung potenziell verwirrender Variablen ein integraler Bestandteil jedes Studiendesigns und jeder Analyse ist. Zwei Aspekte des Confounding müssen in der Berufsepidemiologie adressiert werden:

- Negative Confounding sollte untersucht werden: Beispielsweise sind einige industrielle Bevölkerungsgruppen aufgrund eines rauchfreien Arbeitsplatzes nur gering mit lebensstilbedingten Risikofaktoren konfrontiert; Glasbläser neigen dazu, weniger zu rauchen als die allgemeine Bevölkerung.

- Wenn Confounding in Betracht gezogen wird, sollte eine Schätzung seiner Richtung und seiner potenziellen Auswirkung bewertet werden. Dies gilt insbesondere dann, wenn die Daten zur Kontrolle des Confounding spärlich sind. Beispielsweise ist Rauchen ein wichtiger Confounder in der Berufsepidemiologie und sollte immer berücksichtigt werden. Wenn jedoch keine Daten zum Rauchen verfügbar sind (was häufig in Kohortenstudien der Fall ist), ist es unwahrscheinlich, dass das Rauchen einen großen Risikoüberschuss erklären kann, der in einer Berufsgruppe gefunden wird. Dies wird in einem Artikel von Axelson (1978) schön beschrieben und von Greenland (1987) weiter diskutiert. Als in der Literatur detaillierte Daten sowohl zum Beruf als auch zum Rauchen verfügbar waren, schien Confounding die Schätzungen zum Zusammenhang zwischen Lungenkrebs und Beruf nicht stark zu verzerren (Vineis und Simonato 1991). Darüber hinaus führt eine vermutete Verwechslung nicht immer zu ungültigen Assoziationen. Da die Forscher auch Gefahr laufen, durch andere unentdeckte Beobachtungs- und Auswahlverzerrungen in die Irre geführt zu werden, sollten diese beim Design einer Studie ebenso viel Gewicht erhalten wie die Frage der Verwirrung (Stellman 1987).

Zeitliche und zeitbezogene Variablen wie Risikoalter, Kalenderzeitraum, Zeit seit Einstellung, Zeit seit erster Exposition, Expositionsdauer und deren Behandlung in der Analysephase gehören zu den komplexesten methodischen Fragestellungen der Arbeitsepidemiologie. Sie werden in diesem Kapitel nicht behandelt, aber es wird auf zwei relevante und neuere methodische Referenzen hingewiesen (Pearce 1992; Robins et al. 1992).

Statistiken

Der statistische Artikel von Biggeri und Braga sowie der Titel dieses Kapitels weisen darauf hin, dass statistische Methoden nicht von epidemiologischer Forschung getrennt werden können. Dies liegt daran, dass: (a) ein solides Verständnis der Statistik wertvolle Einblicke in das richtige Design einer Untersuchung liefern kann und (b) Statistik und Epidemiologie ein gemeinsames Erbe teilen und die gesamte quantitative Grundlage der Epidemiologie auf dem Begriff der Wahrscheinlichkeit basiert ( Clayton 1992; Clayton und Hills 1993). In vielen der folgenden Artikel werden empirische Beweise und Beweise für hypothetische kausale Zusammenhänge mit probabilistischen Argumenten und geeigneten Studiendesigns bewertet. Beispielsweise wird der Schwerpunkt auf die Schätzung des Risikomaßes von Interesse gelegt, wie Zinssätze oder relative Risiken, und auf die Konstruktion von Konfidenzintervallen um diese Schätzungen herum, anstatt statistische Wahrscheinlichkeitstests durchzuführen (Poole 1987; Gardner und Altman 1989; Greenland 1990 ). Es wird eine kurze Einführung in das statistische Denken unter Verwendung der Binomialverteilung gegeben. Statistik sollte ein Begleiter des wissenschaftlichen Denkens sein. Aber es ist wertlos, wenn es an richtig konzipierter und durchgeführter Forschung mangelt. Statistiker und Epidemiologen sind sich bewusst, dass die Wahl der Methoden bestimmt, was und in welchem Umfang wir Beobachtungen machen. Die wohlüberlegte Auswahl der Gestaltungsmöglichkeiten ist daher von grundlegender Bedeutung, um valide Beobachtungen zu gewährleisten.

Ethik

Der letzte Artikel von Vineis befasst sich mit ethischen Fragen in der epidemiologischen Forschung. Die in dieser Einführung zu erwähnenden Punkte beziehen sich auf die Epidemiologie als eine Disziplin, die per Definition präventive Maßnahmen impliziert. Spezifische ethische Aspekte im Hinblick auf den Schutz der Arbeitnehmer und der Bevölkerung insgesamt erfordern die Anerkennung, dass:

- Epidemiologische Studien im betrieblichen Umfeld sollten Präventionsmaßnahmen am Arbeitsplatz keinesfalls verzögern.

- Berufsepidemiologie bezieht sich nicht auf Lebensstilfaktoren, sondern auf Situationen, in denen bei der Wahl der Exposition normalerweise keine oder nur eine geringe persönliche Rolle gespielt wird. Dies impliziert ein besonderes Engagement für eine wirksame Prävention und die unverzügliche Übermittlung von Informationen an die Arbeitnehmer und die Öffentlichkeit.

- Forschung deckt Gesundheitsgefahren auf und liefert das Wissen für vorbeugende Maßnahmen. Die ethischen Probleme, wenn es möglich ist, keine Forschung durchzuführen, sollten berücksichtigt werden.

- Die Benachrichtigung der Arbeitnehmer über die Ergebnisse epidemiologischer Studien ist sowohl ein ethisches als auch ein methodisches Problem in der Risikokommunikation. Der Forschung zur Bewertung der potenziellen Auswirkungen und Wirksamkeit der Benachrichtigung sollte hohe Priorität eingeräumt werden (Schulte et al. 1993).

Ausbildung in Berufsepidemiologie

In die Spezialisierung Berufsepidemiologie finden Menschen mit unterschiedlichsten Hintergründen den Weg. Medizin, Krankenpflege und Statistik sind einige der wahrscheinlicheren Hintergründe, die unter Fachleuten auf diesem Gebiet zu finden sind. In Nordamerika hat etwa die Hälfte aller ausgebildeten Epidemiologen einen naturwissenschaftlichen Hintergrund, während die andere Hälfte den Weg zum Doktor der Medizin eingeschlagen hat. In Ländern außerhalb Nordamerikas haben die meisten Spezialisten für Berufsepidemiologie den Doktortitel erreicht. In Nordamerika werden Menschen mit medizinischer Ausbildung eher als „Inhaltsexperten“ betrachtet, während diejenigen, die auf dem wissenschaftlichen Weg ausgebildet wurden, als „methodische Experten“ gelten. Oft ist es für einen Inhaltsexperten von Vorteil, sich mit einem Methodenexperten zusammenzuschließen, um die bestmögliche Studie zu konzipieren und durchzuführen.

Für das Fach Berufsepidemiologie sind nicht nur Kenntnisse in epidemiologischen Methoden, Statistiken und Computern erforderlich, sondern auch Kenntnisse in Toxikologie, Arbeitshygiene und Krankheitsregistern (Merletti und Comba 1992). Da große Studien eine Verknüpfung mit Krankheitsregistern erfordern können, ist die Kenntnis von Quellen für Bevölkerungsdaten hilfreich. Auch Kenntnisse der Arbeits- und Unternehmensorganisation sind wichtig. Diplomarbeiten auf Master-Ebene und Dissertationen auf Doktorats-Ausbildungsebene statten die Studierenden mit dem Wissen aus, das für die Durchführung umfangreicher datensatzbasierter und interviewbasierter Studien unter Arbeitnehmern erforderlich ist.

Anteil der berufsbedingten Erkrankungen

Der Anteil der Erkrankungen, der entweder bei einer Gruppe exponierter Arbeitnehmer oder in der Allgemeinbevölkerung auf berufliche Expositionen zurückzuführen ist, wird zumindest im Hinblick auf Krebs in einem anderen Teil davon erfasst Enzyklopädie. Hier sollten wir bedenken, dass, wenn eine Schätzung berechnet wird, diese für eine bestimmte Krankheit (und einen bestimmten Ort im Fall von Krebs), einen bestimmten Zeitraum und ein bestimmtes geografisches Gebiet gelten sollte. Darüber hinaus sollte es auf genauen Messungen des Anteils exponierter Personen und des Expositionsgrads beruhen. Dies impliziert, dass der Anteil der berufsbedingten Erkrankungen von sehr niedrig oder null in bestimmten Bevölkerungsgruppen bis zu sehr hoch in anderen in Industriegebieten reichen kann, wo beispielsweise bis zu 40 % der Lungenkrebsfälle auf berufliche Exposition zurückzuführen sind (Vineis und Simonato 1991). Schätzungen, die nicht auf einer detaillierten Überprüfung gut konzipierter epidemiologischer Studien beruhen, können bestenfalls als fundierte Vermutungen angesehen werden und sind von begrenztem Wert.

Übertragung gefährlicher Industrien

Die meisten epidemiologischen Forschungen werden in den Industrieländern durchgeführt, wo die Regulierung und Kontrolle bekannter Berufsgefahren das Krankheitsrisiko in den letzten Jahrzehnten verringert hat. Gleichzeitig fand jedoch eine große Verlagerung gefährlicher Industrien in die Entwicklungsländer statt (Jeyaratnam 1994). Chemikalien, die zuvor in den Vereinigten Staaten oder Europa verboten waren, werden jetzt in Entwicklungsländern hergestellt. Beispielsweise wurde die Asbestzerkleinerung von den USA nach Mexiko verlagert und die Benzidinproduktion aus europäischen Ländern in das ehemalige Jugoslawien und nach Korea (Simonato 1986; LaDou 1991; Pearce et al. 1994).