Kinder Kategorien

27. Biologische Überwachung (6)

27. Biologische Überwachung

Kapitelherausgeber: Robert Lauwerys

Inhaltsverzeichnis

Tabellen und Abbildungen

Allgemeine Grundsätze

Vito Foà und Lorenzo Alessio

Qualitätssicherung

D. Gompertz

Metalle und metallorganische Verbindungen

P. Hoet und Robert Lauwerys

Organische Lösungsmittel

Masayuki Ikeda

Genotoxische Chemikalien

Marja Sorsa

Pestizide

Marco Maroni und Adalberto Ferioli

Tische

Klicken Sie unten auf einen Link, um die Tabelle im Artikelkontext anzuzeigen.

1. ACGIH, DFG & andere Grenzwerte für Metalle

2. Beispiele für Chemikalien- und biologisches Monitoring

3. Biologische Überwachung auf organische Lösungsmittel

4. Genotoxizität von Chemikalien, bewertet von IARC

5. Biomarker und einige Zell-/Gewebeproben und Genotoxizität

6. Menschliche Karzinogene, berufliche Exposition und zytogenetische Endpunkte

8. Exposition durch Produktion und Verwendung von Pestiziden

9. Akute OP-Toxizität bei verschiedenen Graden der ACHE-Hemmung

10 Variationen von ACHE & PCHE & ausgewählten Gesundheitszuständen

11 Cholinesterase-Aktivitäten von nicht exponierten gesunden Menschen

12 Alkylphosphate im Urin und OP-Pestizide

13 Alkylphosphatmessungen im Urin & OP

14 Carbamat-Metaboliten im Urin

15 Dithiocarbamat-Metaboliten im Urin

16 Vorgeschlagene Indizes für die biologische Überwachung von Pestiziden

17 Empfohlene biologische Grenzwerte (Stand 1996)

Zahlen

Zeigen Sie auf eine Miniaturansicht, um die Bildunterschrift anzuzeigen, klicken Sie, um die Abbildung im Artikelkontext anzuzeigen.

28. Epidemiologie und Statistik (12)

28. Epidemiologie und Statistik

Kapitel-Editoren: Franco Merletti, Colin L. Soskolne und Paolo Vineis

Inhaltsverzeichnis

Tabellen und Abbildungen

Epidemiologische Methode für Arbeitssicherheit und Gesundheitsschutz

Franco Merletti, Colin L. Soskolne und Paolo Vineis

Expositionsbewertung

M. Gerald Ott

Zusammenfassung der Expositionsmaßnahmen im Arbeitsleben

Colin L. Soskolne

Messung der Auswirkungen von Expositionen

Shelia Hoar Zahm

Fallbeispiel: Maßnahmen

Franco Merletti, Colin L. Soskolne und Paola Vineis

Optionen im Studiendesign

Sven Herberg

Validitätsprobleme im Studiendesign

Annie J. Sasco

Einfluss zufälliger Messfehler

Paolo Vineis und Colin L. Soskolne

Statistische Methoden

Annibale Biggeri und Mario Braga

Kausalitätsbewertung und Ethik in der epidemiologischen Forschung

Paolo Vineis

Fallstudien zur Veranschaulichung methodischer Probleme bei der Überwachung von Berufskrankheiten

Jung-Der Wang

Fragebögen in der epidemiologischen Forschung

Steven D. Stellman und Colin L. Soskolne

Asbest Historische Perspektive

Laurent Garfinkel

Tische

Klicken Sie unten auf einen Link, um die Tabelle im Artikelkontext anzuzeigen.

1. Fünf ausgewählte zusammenfassende Maßnahmen zur Exposition im Berufsleben

2. Maße für das Auftreten von Krankheiten

3. Assoziationsmaße für eine Kohortenstudie

4. Assoziationsmaße für Fall-Kontroll-Studien

5. Allgemeines Häufigkeitstabellenlayout für Kohortendaten

6. Musterlayout von Fallkontrolldaten

7. Layout-Fallkontrolldaten – eine Kontrolle pro Fall

8. Hypothetische Kohorte von 1950 Individuen zu T2

9. Indizes der zentralen Tendenz und Streuung

10 Ein binomiales Experiment & Wahrscheinlichkeiten

11 Mögliche Ergebnisse eines binomialen Experiments

12 Binomialverteilung, 15 Erfolge/30 Versuche

13 Binomialverteilung, p = 0.25; 30 Versuche

14 Fehler XNUMX. Art & Leistung; x = 12, n = 30, a = 0.05

15 Fehler XNUMX. Art & Leistung; x = 12, n = 40, a = 0.05

16 632 Arbeitnehmer, die 20 Jahre oder länger Asbest ausgesetzt waren

17 O/E Zahl der Todesfälle unter 632 Asbestarbeitern

Zahlen

Zeigen Sie auf eine Miniaturansicht, um die Bildunterschrift anzuzeigen, klicken Sie, um die Abbildung im Artikelkontext anzuzeigen.

29. Ergonomie (27)

29. Ergonomie

Kapitel-Editoren: Wolfgang Laurig und Joachim Vedder

Inhaltsverzeichnis

Tabellen und Abbildungen

Überblick

Wolfgang Laurig und Joachim Vedder

Ziele, Prinzipien und Methoden

Wesen und Ziele der Ergonomie

William T. Singleton

Analyse von Aktivitäten, Aufgaben und Arbeitssystemen

Véronique De Keyser

Ergonomie und Standardisierung

Friedhelm Nachreiner

Prüflisten

Pranab Kumar Nag

Physikalische und physiologische Aspekte

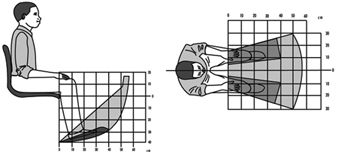

Anthropometrie

Melchiorre Masali

Muskelarbeit

Juhani Smolander und Veikko Louhevaara

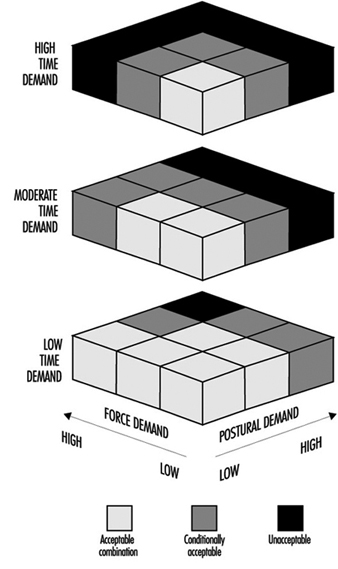

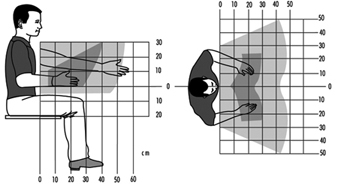

Körperhaltungen bei der Arbeit

Ilkka Kurinka

Biomechanik

Frank Darby

Allgemeine Müdigkeit

Etienne Grandjean

Müdigkeit und Erholung

Rolf Helbig und Walter Rohmert

Psychologische Aspekte

Geistige Arbeitsbelastung

Winfried Hacker

Wachsamkeit

Herbert Heuer

Geistige Müdigkeit

Peter Richter

Organisatorische Aspekte der Arbeit

Arbeitsorganisation

Eberhard Ulich und Gudela Grote

Schlafentzug

Kazutaka Kogi

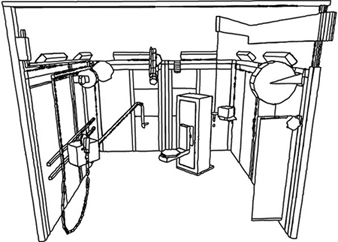

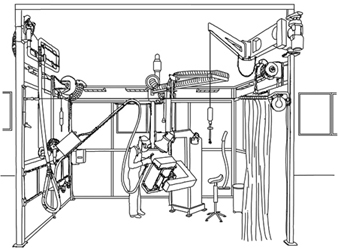

Gestaltung von Arbeitssystemen

Workstations

Roland Kadefors

Tools

TM Fraser

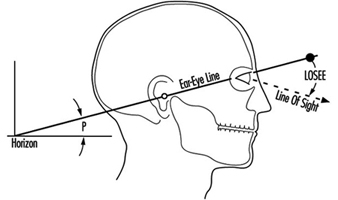

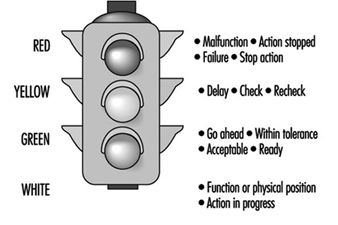

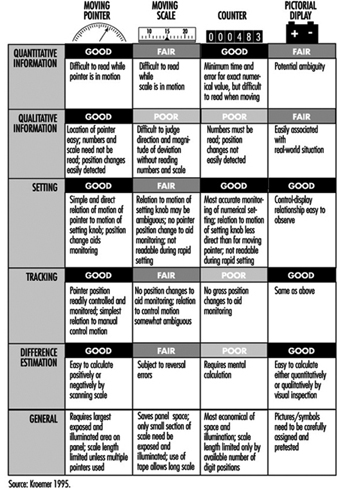

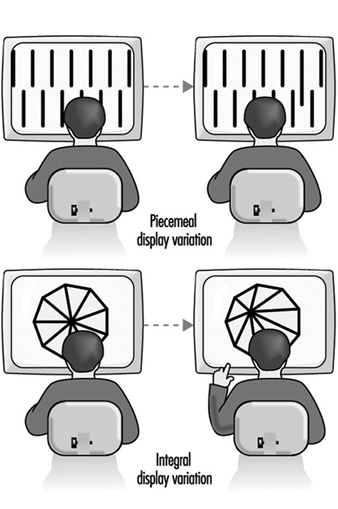

Bedienelemente, Anzeigen und Bedienfelder

Karl HE Kroemer

Informationsverarbeitung und Design

Andries F. Sanders

Designen für alle

Entwerfen für bestimmte Gruppen

Witz H. Grady-van den Nieuwboer

Fallstudie: Die internationale Klassifikation der Funktionseinschränkung beim Menschen

Kulturelle Unterschiede

Houshang Shahnavaz

Ältere Arbeitnehmer

Antoine Laville und Serge Volkoff

Arbeitnehmer mit besonderen Bedürfnissen

Witz H. Grady-van den Nieuwboer

Vielfalt und Bedeutung der Ergonomie – zwei Beispiele

Systemdesign in der Diamantherstellung

Issachar Gilad

Missachtung ergonomischer Gestaltungsprinzipien: Tschernobyl

Wladimir M. Munipov

Tische

Klicken Sie unten auf einen Link, um die Tabelle im Artikelkontext anzuzeigen.

1. Grundlegende anthropometrische Kernliste

2. Ermüdung und Erholung abhängig vom Aktivitätsniveau

3. Regeln der Kombinationswirkung zweier Stressfaktoren auf die Belastung

4. Es wird zwischen mehreren negativen Folgen psychischer Belastung unterschieden

5. Arbeitsorientierte Prinzipien zur Produktionsgestaltung

6. Partizipation im organisatorischen Kontext

7. Benutzerbeteiligung am Technologieprozess

8. Unregelmäßige Arbeitszeiten und Schlafentzug

9. Aspekte von Früh-, Anker- und Verzögerungsschlaf

10 Kontrollieren Sie Bewegungen und erwartete Effekte

11 Steuerungs-Wirkungs-Beziehungen gängiger Handsteuerungen

12 Regeln für die Anordnung von Kontrollen

Zahlen

Zeigen Sie auf eine Miniaturansicht, um die Bildunterschrift anzuzeigen, klicken Sie, um die Abbildung im Artikelkontext anzuzeigen.

30. Arbeitshygiene (6)

30. Arbeitshygiene

Kapitel-Editor: Robert F. Herrick

Inhaltsverzeichnis

Tabellen und Abbildungen

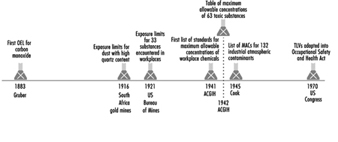

Ziele, Definitionen und allgemeine Informationen

Berenice I. Ferrari Goelzer

Gefahren erkennen

Linnea Lillienberg

Bewertung der Arbeitsumgebung

Lori A. Todd

Arbeitshygiene: Expositionskontrolle durch Intervention

James Stewart

Die biologische Grundlage für die Expositionsbewertung

Dick Heederik

Arbeitsplatzgrenzwerte

Dennis J. Pausenbach

Tische

1. Gefahren durch Chemikalien; biologische und physikalische Wirkstoffe

2. Arbeitsplatzgrenzwerte (OELs) – verschiedene Länder

Zahlen

31. Personenschutz (7)

31. Persönlicher Schutz

Kapitel-Editor: Robert F. Herrick

Inhaltsverzeichnis

Tabellen und Abbildungen

Überblick und Philosophie des Personenschutzes

Robert F. Herrick

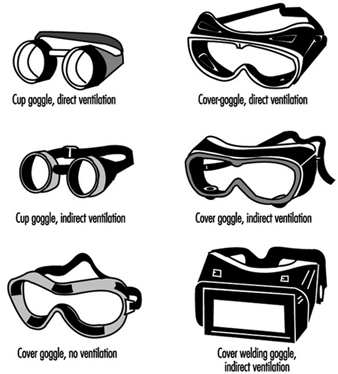

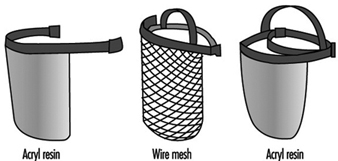

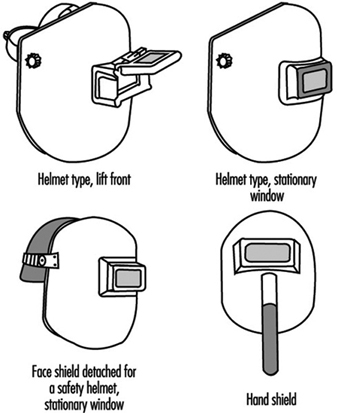

Augen- und Gesichtsschutz

Kikuzi Kimura

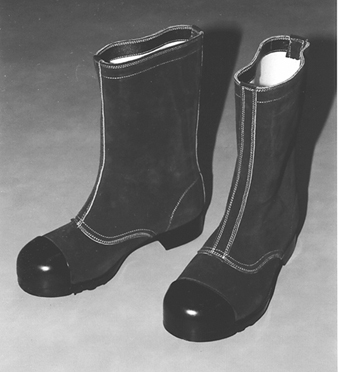

Fuß- und Beinschutz

Toyohiko Miura

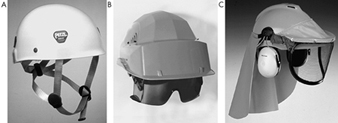

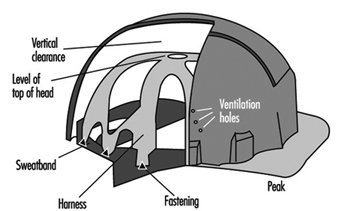

Kopfschutz

Isabelle Balty und Alain Mayer

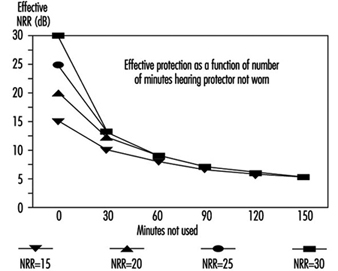

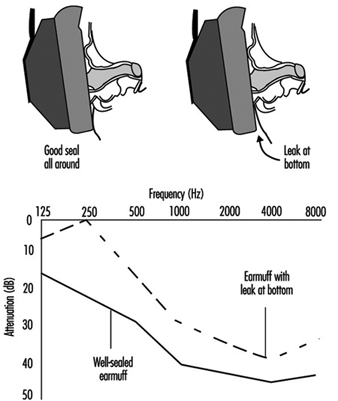

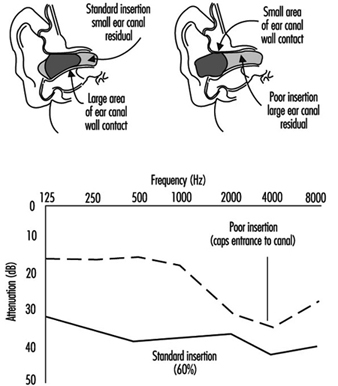

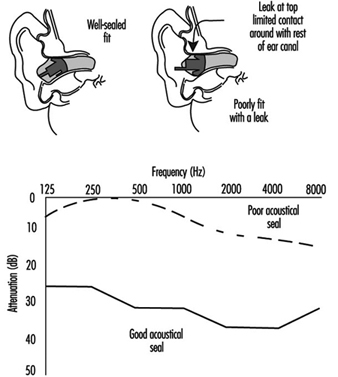

Gehörschutz

John R. Franks und Elliott H. Berger

Schutzkleidung

S.Zack Mansdorf

Atemschutz

Thomas J. Nelson

Tische

Klicken Sie unten auf einen Link, um die Tabelle im Artikelkontext anzuzeigen.

1. Transmissionsanforderungen (ISO 4850-1979)

2. Schutzmaßstäbe - Gasschweißen & Lötschweißen

3. Schutzwaage - Sauerstoffschneiden

4. Schutzmaßstäbe - Plasmalichtbogenschneiden

5. Schutzwaagen - Lichtbogenschweißen oder Fugenhobeln

6. Schutzmaßstäbe - Plasma-Lichtbogen-Direktschweißen

7. Schutzhelm: ISO-Norm 3873-1977

8. Geräuschreduzierungsbewertung eines Gehörschutzes

9. Berechnung der A-bewerteten Rauschunterdrückung

10 Beispiele für Hautgefahrenkategorien

11 Physikalische, chemische und biologische Leistungsanforderungen

12 Sachgefahren im Zusammenhang mit bestimmten Tätigkeiten

13 Zugewiesene Schutzfaktoren aus ANSI Z88 2 (1992)

Zahlen

Zeigen Sie auf eine Miniaturansicht, um die Bildunterschrift anzuzeigen, klicken Sie, um die Abbildung im Artikelkontext anzuzeigen.

32. Aufzeichnungssysteme und Überwachung (9)

32. Aufzeichnungssysteme und Überwachung

Kapitel-Editor: Steven D. Stellman

Inhaltsverzeichnis

Tabellen und Abbildungen

Überwachungs- und Meldesysteme für Berufskrankheiten

Steven B. Markowitz

Überwachung von Arbeitsgefahren

David H. Wegman und Steven D. Stellman

Überwachung in Entwicklungsländern

David Koh und Kee-Seng Chia

Entwicklung und Anwendung eines Klassifizierungssystems für Arbeitsunfälle und Berufskrankheiten

Elyce Biddle

Risikoanalyse von nicht tödlichen Verletzungen und Krankheiten am Arbeitsplatz

John W. Ruser

Fallstudie: Arbeitnehmerschutz und Statistiken zu Unfällen und Berufskrankheiten - HVBG, Deutschland

Martin Butz und Burkhard Hoffmann

Fallstudie: Wismut – Eine Neuauflage der Uranexposition

Heinz Otten und Horst Schulz

Messstrategien und -techniken für die berufsbedingte Expositionsabschätzung in der Epidemiologie

Frank Bochmann und Helmut Blome

Fallstudie: Arbeitsmedizinische Erhebungen in China

Tische

Klicken Sie unten auf einen Link, um die Tabelle im Artikelkontext anzuzeigen.

1. Angiosarkom der Leber - Weltregister

2. Berufskrankheit, USA, 1986 versus 1992

3. US-Todesfälle durch Pneumokoniose und Pleuramesotheliom

4. Musterliste meldepflichtiger Berufskrankheiten

5. Codestruktur für die Meldung von Krankheiten und Verletzungen, USA

6. Nichttödliche Arbeitsunfälle und Berufskrankheiten, USA 1993

7. Risiko von Arbeitsunfällen und Berufskrankheiten

8. Relatives Risiko für sich wiederholende Bewegungszustände

9. Arbeitsunfälle, Deutschland, 1981-93

10 Schleifmaschinen bei Unfällen in der Metallverarbeitung, Deutschland, 1984-93

11 Berufskrankheit, Deutschland, 1980-93

12 Infektionskrankheiten, Deutschland, 1980-93

13 Strahlenbelastung in den Wismut-Bergwerken

14 Berufskrankheiten im Wismuter Uranbergwerk 1952-90

Zahlen

Zeigen Sie auf eine Miniaturansicht, um die Bildunterschrift anzuzeigen, klicken Sie, um die Abbildung im Artikelkontext anzuzeigen.

33. Toxikologie (21)

33. Toxikologie

Kapitelherausgeberin: Ellen K. Silbergeld

Inhaltsverzeichnis

Tabellen und Abbildungen

Einleitung

Ellen K. Silbergeld, Kapitelredakteurin

Allgemeine Prinzipien der Toxikologie

Definitionen und Konzepte

Bo Holmberg, Johan Hogberg und Gunnar Johanson

Toxikokinetik

Dušan Djuric

Zielorgan und kritische Wirkungen

Marek Jakubowski

Auswirkungen von Alter, Geschlecht und anderen Faktoren

Spomenka Telisman

Genetische Determinanten der toxischen Reaktion

Daniel W. Nebert und Ross A. McKinnon

Mechanismen der Toxizität

Einführung und Konzepte

Philip G. Watanabe

Zellschädigung und Zelltod

Benjamin F. Trump und Irene K. Berezesky

Genetische Toxikologie

R. Rita Misra und Michael P. Waalkes

Immuntoxikologie

Joseph G. Vos und Henk van Loveren

Zielorgan-Toxikologie

Ellen K. Silbergeld

Toxikologische Testmethoden

Biomarker

Philipp Grandjean

Bewertung der genetischen Toxizität

David M. DeMarini und James Huff

In-vitro-Toxizitätstest

Joanne Zürlo

Aktivitätsbeziehungen strukturieren

Ellen K. Silbergeld

Regulatorische Toxikologie

Toxikologie in der Gesundheits- und Sicherheitsverordnung

Ellen K. Silbergeld

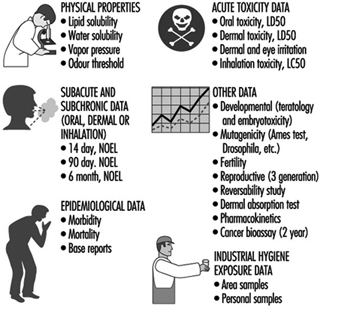

Prinzipien der Gefahrenidentifizierung - Der japanische Ansatz

Masayuki Ikeda

Der Ansatz der Vereinigten Staaten zur Risikobewertung von reproduktionstoxischen und neurotoxischen Wirkstoffen

Ellen K. Silbergeld

Ansätze zur Gefahrenidentifizierung - IARC

Harri Vainio und Julian Wilbourn

Anhang – Gesamtbewertungen der Karzinogenität beim Menschen: IARC-Monographien, Bände 1–69 (836)

Karzinogen-Risikobewertung: Andere Ansätze

Cees A. van der Heijden

Tische

Klicken Sie unten auf einen Link, um die Tabelle im Artikelkontext anzuzeigen.

- Beispiele für kritische Organe und kritische Effekte

- Grundlegende Wirkungen möglicher Mehrfachwechselwirkungen von Metallen

- Hämoglobinaddukte bei Arbeitern, die Anilin und Acetanilid ausgesetzt waren

- Erbliche, krebsanfällige Erkrankungen und Defekte in der DNA-Reparatur

- Beispiele für Chemikalien, die in menschlichen Zellen genotoxisch wirken

- Klassifizierung von Tests für Immunmarker

- Beispiele für Biomarker der Exposition

- Vor- und Nachteile von Methoden zur Identifizierung von Krebsrisiken beim Menschen

- Vergleich von In-vitro-Systemen für Hepatotoxizitätsstudien

- Vergleich von SAR- und Testdaten: OECD/NTP-Analysen

- Regulierung chemischer Stoffe durch Gesetze, Japan

- Prüfgegenstände gemäß dem Gesetz zur Kontrolle chemischer Substanzen, Japan

- Chemische Substanzen und das Gesetz zur Kontrolle chemischer Substanzen

- Ausgewählte größere Neurotoxizitätsvorfälle

- Beispiele für spezialisierte Tests zur Messung der Neurotoxizität

- Endpunkte in der Reproduktionstoxikologie

- Vergleich von Niedrigdosis-Extrapolationsverfahren

- Häufig zitierte Modelle zur Charakterisierung des Karzinogenrisikos

Zahlen

Zeigen Sie auf eine Miniaturansicht, um die Bildunterschrift anzuzeigen, klicken Sie, um die Abbildung im Artikelkontext anzuzeigen.

Ansätze zur Gefahrenidentifizierung: IARC

Die Identifizierung krebserzeugender Risiken für den Menschen war das Ziel der IARC-Monographien zur Bewertung krebserzeugender Risiken für den Menschen seit 1971. Bis heute sind 69 Bände Monographien mit Bewertungen zur Kanzerogenität von 836 Stoffen oder Expositionsumständen erschienen oder im Druck (siehe Anhang).

Diese qualitativen Bewertungen des krebserzeugenden Risikos für den Menschen entsprechen der Phase der Gefahrenidentifizierung im inzwischen allgemein anerkannten Schema der Risikobewertung, die die Identifizierung der Gefahren, die Dosis-Wirkungs-Bewertung (einschließlich Extrapolation außerhalb der Beobachtungsgrenzen), die Expositionsbewertung und die Risikobeschreibung umfasst .

Das Ziel der IARC-Monographien Ziel war es, durch internationale Zusammenarbeit in Form von Expertenarbeitskreisen kritische qualitative Bewertungen zur Kanzerogenität von Arbeitsstoffen (Chemikalien, Chemikaliengruppen, komplexe Gemische, physikalische oder biologische Faktoren) oder Expositionsumständen (berufliche Expositionen, kulturelle Gewohnheiten) für den Menschen zu veröffentlichen . Die Arbeitsgruppen erstellen Monographien über eine Reihe von einzelnen Agenten oder Expositionen, und jeder Band wird veröffentlicht und weit verbreitet. Jede Monographie besteht aus einer kurzen Beschreibung der physikalischen und chemischen Eigenschaften des Mittels; Methoden zu seiner Analyse; eine Beschreibung, wie es produziert wird, wie viel produziert wird und wie es verwendet wird; Daten zu Vorkommen und menschlicher Exposition; Zusammenfassungen von Fallberichten und epidemiologischen Studien zu Krebs beim Menschen; Zusammenfassungen experimenteller Kanzerogenitätstests; eine kurze Beschreibung anderer relevanter biologischer Daten, wie z. B. Toxizität und genetische Wirkungen, die auf einen möglichen Wirkungsmechanismus hinweisen können; und eine Bewertung seiner Karzinogenität. Der erste Teil dieses allgemeinen Schemas wird entsprechend angepasst, wenn es sich um andere Stoffe als Chemikalien oder Chemikaliengemische handelt.

Die Leitprinzipien für die Bewertung von Karzinogenen wurden von verschiedenen Ad-hoc-Expertengruppen erarbeitet und sind in der Präambel des Monographien (IARC 1994a).

Werkzeuge zur qualitativen Identifizierung krebserzeugender Risiken (Gefahren).

Assoziationen werden hergestellt, indem die verfügbaren Daten aus Studien an exponierten Menschen, die Ergebnisse von Bioassays an Versuchstieren und Studien zu Exposition, Metabolismus, Toxizität und genetischen Wirkungen sowohl bei Menschen als auch bei Tieren untersucht werden.

Studien zu Krebs beim Menschen

Drei Arten von epidemiologischen Studien tragen zur Beurteilung der Karzinogenität bei: Kohortenstudien, Fall-Kontroll-Studien und Korrelationsstudien (oder ökologische Studien). Fallberichte über Krebs können ebenfalls überprüft werden.

Kohorten- und Fall-Kontroll-Studien setzen die untersuchten individuellen Expositionen mit dem Auftreten von Krebs bei Einzelpersonen in Beziehung und liefern eine Schätzung des relativen Risikos (Verhältnis der Inzidenz bei den Exponierten zur Inzidenz bei den Nicht-Exponierten) als Hauptmaß für den Zusammenhang.

In Korrelationsstudien ist die Untersuchungseinheit normalerweise ganze Bevölkerungsgruppen (z. B. bestimmte geografische Gebiete) und die Krebshäufigkeit wird mit einem zusammenfassenden Maß der Exposition der Bevölkerung gegenüber dem Wirkstoff in Beziehung gesetzt. Da die individuelle Exposition nicht dokumentiert wird, lässt sich aus solchen Studien weniger leicht auf einen kausalen Zusammenhang schließen als aus Kohorten- und Fall-Kontroll-Studien. Fallberichte entstehen in der Regel aus dem auf klinischer Erfahrung basierenden Verdacht, dass das Zusammentreffen zweier Ereignisse – also eine bestimmte Exposition und das Auftreten einer Krebserkrankung – eher häufiger vorgekommen ist, als zufällig zu erwarten wäre. Die Unsicherheiten bei der Interpretation von Fallberichten und Korrelationsstudien machen sie, außer in seltenen Fällen, ungeeignet, um die alleinige Grundlage für den Schluss auf einen kausalen Zusammenhang zu bilden.

Bei der Interpretation epidemiologischer Studien ist es notwendig, die mögliche Rolle von Bias und Confounding zu berücksichtigen. Unter Voreingenommenheit versteht man das Wirken von Faktoren im Studiendesign oder in der Durchführung, die fälschlicherweise zu einer stärkeren oder schwächeren Assoziation führen, als tatsächlich zwischen einer Krankheit und einem Agens besteht. Mit Confounding ist eine Situation gemeint, in der die Beziehung zu einer Krankheit als Ergebnis einer Assoziation zwischen dem offensichtlichen kausalen Faktor und einem anderen Faktor, der entweder mit einer Zunahme oder Abnahme der Inzidenz verbunden ist, stärker oder schwächer erscheint, als sie tatsächlich ist die Krankheit.

Bei der Bewertung der epidemiologischen Studien deutet eine starke Assoziation (dh ein großes relatives Risiko) eher auf eine Kausalität hin als eine schwache Assoziation, obwohl anerkannt wird, dass relative Risiken geringer Größenordnung keine fehlende Kausalität implizieren und wichtig sein können wenn die Krankheit häufig ist. Assoziationen, die in mehreren Studien mit gleichem Design oder mit unterschiedlichen epidemiologischen Ansätzen oder unter unterschiedlichen Expositionsbedingungen repliziert werden, stellen eher einen kausalen Zusammenhang dar als isolierte Beobachtungen aus einzelnen Studien. Ein Anstieg des Krebsrisikos mit zunehmender Exposition gilt als starker Hinweis auf Kausalität, obwohl das Fehlen einer abgestuften Reaktion nicht unbedingt gegen einen kausalen Zusammenhang spricht. Auch der Nachweis eines Risikorückgangs nach Beendigung oder Reduktion der Exposition bei einzelnen Personen oder ganzen Populationen unterstützt eine kausale Interpretation der Befunde.

Wenn mehrere epidemiologische Studien wenig oder keinen Hinweis auf einen Zusammenhang zwischen einer Exposition und Krebs zeigen, kann gefolgert werden, dass sie insgesamt Hinweise auf eine fehlende Karzinogenität liefern. Die Möglichkeit, dass Verzerrungen, Verwechslungen oder Fehlklassifizierungen der Exposition oder des Ergebnisses die beobachteten Ergebnisse erklären könnten, muss in Betracht gezogen und mit hinreichender Sicherheit ausgeschlossen werden. Belege aus mehreren epidemiologischen Studien, die auf mangelnde Karzinogenität hindeuten, können nur für die untersuchte(n) Krebsart(en), Dosisniveaus und Intervalle zwischen der ersten Exposition und der Beobachtung der Erkrankung gelten. Bei einigen Krebsarten beim Menschen beträgt der Zeitraum zwischen der ersten Exposition und der Entwicklung einer klinischen Erkrankung selten weniger als 20 Jahre; Latenzzeiten, die wesentlich kürzer als 30 Jahre sind, können keinen Hinweis auf fehlende Kanzerogenität liefern.

Die für die Kanzerogenität relevanten Hinweise aus Studien am Menschen werden in eine der folgenden Kategorien eingeordnet:

Ausreichende Hinweise auf Karzinogenität. Es wurde ein kausaler Zusammenhang zwischen der Exposition gegenüber dem Stoff, dem Gemisch oder den Expositionsumständen und Krebs beim Menschen festgestellt. Das heißt, in Studien, in denen Zufall, Bias und Confounding mit hinreichender Sicherheit ausgeschlossen werden konnten, wurde ein positiver Zusammenhang zwischen der Exposition und Krebs beobachtet.

Begrenzter Hinweis auf Karzinogenität. Es wurde ein positiver Zusammenhang zwischen der Exposition gegenüber dem Wirkstoff, dem Gemisch oder den Expositionsumständen und Krebs beobachtet, für den eine kausale Interpretation als glaubwürdig erachtet wird, aber Zufall, Verzerrung oder Verwechslung kann nicht mit hinreichender Sicherheit ausgeschlossen werden.

Unzureichender Nachweis der Karzinogenität. Die verfügbaren Studien sind von unzureichender Qualität, Konsistenz oder statistischer Aussagekraft, um auf das Vorliegen oder Fehlen eines kausalen Zusammenhangs schließen zu können, oder es liegen keine Daten zu Krebserkrankungen beim Menschen vor.

Hinweise auf mangelnde Karzinogenität. Es gibt mehrere adäquate Studien, die das gesamte Spektrum der Expositionsniveaus abdecken, denen Menschen bekanntermaßen ausgesetzt sind, die übereinstimmend darin sind, dass sie bei keinem beobachteten Expositionsniveau einen positiven Zusammenhang zwischen der Exposition gegenüber dem Wirkstoff und dem untersuchten Krebs zeigen. Die Schlussfolgerung „Hinweise auf fehlende Karzinogenität“ beschränkt sich zwangsläufig auf die von den verfügbaren Studien abgedeckten Krebsorte, -bedingungen und -niveaus sowie die Beobachtungsdauer.

Die Anwendbarkeit einer Bewertung der Kanzerogenität eines Gemisches, Verfahrens, Berufes oder Industriezweiges auf der Grundlage von Erkenntnissen aus epidemiologischen Studien ist zeit- und ortsabhängig. Es sollte nach der spezifischen Exposition, dem Prozess oder der Aktivität gesucht werden, die am wahrscheinlichsten für ein übermäßiges Risiko verantwortlich ist, und die Bewertung sollte so eng wie möglich ausgerichtet werden. Die lange Latenzzeit von Krebs beim Menschen erschwert die Interpretation epidemiologischer Studien. Eine weitere Komplikation ist die Tatsache, dass Menschen gleichzeitig einer Vielzahl von Chemikalien ausgesetzt sind, die miteinander interagieren können, um das Risiko für Neoplasien entweder zu erhöhen oder zu verringern.

Untersuchungen zur Kanzerogenität bei Versuchstieren

Studien, in denen Versuchstiere (normalerweise Mäuse und Ratten) potenziellen Karzinogenen ausgesetzt und auf Anzeichen von Krebs untersucht wurden, wurden vor etwa 50 Jahren mit dem Ziel eingeführt, einen wissenschaftlichen Ansatz für die Untersuchung der chemischen Karzinogenese einzuführen und einige der Nachteile zu vermeiden unter ausschließlicher Verwendung epidemiologischer Daten beim Menschen. Im IARC-Monographien alle verfügbaren, veröffentlichten Studien zur Kanzerogenität an Tieren werden zusammengefasst und der Grad der Evidenz der Kanzerogenität wird dann in eine der folgenden Kategorien eingeteilt:

Ausreichende Hinweise auf Karzinogenität. Es wurde ein kausaler Zusammenhang zwischen dem Mittel oder dem Gemisch und einem erhöhten Auftreten von bösartigen Neubildungen oder einer geeigneten Kombination von gutartigen und bösartigen Neubildungen bei zwei oder mehr Tierarten oder in zwei oder mehr unabhängigen Studien bei einer Art, die zu unterschiedlichen Zeiten durchgeführt wurden, festgestellt oder in verschiedenen Labors oder unter verschiedenen Protokollen. Ausnahmsweise kann eine einzelne Studie an einer Tierart als ausreichender Beweis für die Karzinogenität angesehen werden, wenn bösartige Neubildungen in ungewöhnlichem Ausmaß in Bezug auf Inzidenz, Ort, Art des Tumors oder Alter bei Ausbruch auftreten.

Begrenzter Hinweis auf Karzinogenität. Die Daten deuten auf eine krebserzeugende Wirkung hin, sind jedoch für eine endgültige Bewertung begrenzt, da beispielsweise (a) der Nachweis der krebserzeugenden Wirkung auf einen einzigen Versuch beschränkt ist; oder (b) es gibt einige ungelöste Fragen bezüglich der Angemessenheit des Designs, der Durchführung oder der Interpretation der Studie; oder (c) das Mittel oder Gemisch erhöht nur das Auftreten von gutartigen Neoplasmen oder Läsionen mit ungewissem neoplastischem Potenzial oder von bestimmten Neoplasmen, die bei bestimmten Stämmen spontan mit hoher Inzidenz auftreten können.

Unzureichender Nachweis der Karzinogenität. Die Studien können aufgrund erheblicher qualitativer oder quantitativer Einschränkungen nicht dahingehend interpretiert werden, dass sie eine krebserzeugende Wirkung zeigen oder nicht, oder es liegen keine Daten zu Krebs bei Versuchstieren vor.

Hinweise auf mangelnde Karzinogenität. Es liegen geeignete Studien mit mindestens zwei Arten vor, die zeigen, dass der Stoff oder das Gemisch im Rahmen der verwendeten Tests nicht krebserzeugend ist. Eine Schlussfolgerung aus Hinweisen auf mangelnde Karzinogenität ist zwangsläufig auf die untersuchten Arten, Tumorstellen und Expositionsniveaus beschränkt.

Andere Daten, die für eine Bewertung der Karzinogenität relevant sind

Daten zu biologischen Wirkungen beim Menschen, die von besonderer Relevanz sind, umfassen toxikologische, kinetische und metabolische Überlegungen sowie Hinweise auf DNA-Bindung, Persistenz von DNA-Läsionen oder genetische Schäden bei exponierten Menschen. Toxikologische Informationen, wie die zur Zytotoxizität und Regeneration, zur Rezeptorbindung und zu hormonellen und immunologischen Wirkungen, sowie Daten zur Kinetik und zum Metabolismus bei Versuchstieren werden zusammengefasst, wenn sie für den möglichen Mechanismus der krebserzeugenden Wirkung des Mittels relevant sind. Die Ergebnisse der Tests auf genetische und verwandte Wirkungen werden für ganze Säugetiere einschließlich Menschen, kultivierte Säugetierzellen und Nicht-Säugetiersysteme zusammengefasst. Struktur-Wirkungs-Beziehungen werden erwähnt, wenn relevant.

Für den zu bewertenden Stoff, das Gemisch oder die Expositionssituation werden die verfügbaren Daten zu Endpunkten oder anderen Phänomenen, die für Mechanismen der Karzinogenese relevant sind, aus Studien an Menschen, Versuchstieren und Gewebe- und Zelltestsystemen innerhalb einer oder mehrerer der folgenden beschreibenden Dimensionen zusammengefasst :

- Hinweise auf Genotoxizität (dh strukturelle Veränderungen auf der Ebene des Gens): zum Beispiel Struktur-Aktivitäts-Erwägungen, Adduktbildung, Mutagenität (Wirkung auf bestimmte Gene), Chromosomenmutation oder Aneuploidie

- Hinweise auf Auswirkungen auf die Expression relevanter Gene (dh funktionelle Veränderungen auf intrazellulärer Ebene): zum Beispiel Veränderungen der Struktur oder Menge des Produkts eines Proto-Onkogens oder Tumorsuppressorgens, Veränderungen der metabolischen Aktivierung, Inaktivierung oder DNA Reparatur

- Hinweise auf relevante Wirkungen auf das Zellverhalten (d. h. morphologische oder Verhaltensänderungen auf Zell- oder Gewebeebene): z. B. Induktion von Mitogenese, kompensatorische Zellproliferation, Präneoplasie und Hyperplasie, Überleben von prämalignen oder malignen Zellen (Immortalisierung, Immunsuppression), Wirkungen auf Metastasierungspotential

- Hinweise aus Dosis- und Zeitverhältnissen auf krebserzeugende Wirkungen und Wechselwirkungen zwischen Wirkstoffen: z. B. frühes versus spätes Stadium, wie aus epidemiologischen Studien abgeleitet; Einleitung, Förderung, Progression oder maligne Umwandlung, wie in Tierversuchen zur Karzinogenität definiert; Toxikokinetik.

Diese Dimensionen schließen sich nicht gegenseitig aus, und ein Agent kann unter mehr als eine fallen. So könnte beispielsweise die Wirkung eines Agens auf die Expression relevanter Gene sowohl unter der ersten als auch der zweiten Dimension zusammengefasst werden, selbst wenn mit hinreichender Sicherheit bekannt wäre, dass diese Wirkungen auf Genotoxizität zurückzuführen sind.

Gesamtbewertungen

Schließlich wird die Beweislage als Ganzes betrachtet, um zu einer Gesamtbewertung der Karzinogenität eines Stoffes, einer Mischung oder eines Expositionsumstands für den Menschen zu gelangen. Eine Bewertung kann für eine Gruppe von Chemikalien vorgenommen werden, wenn unterstützende Daten darauf hindeuten, dass andere, verwandte Verbindungen, für die es keine direkten Beweise dafür gibt, dass sie bei Menschen oder Tieren Krebs hervorrufen können, ebenfalls karzinogen sein können, wobei eine Begründung für diese Schlussfolgerung enthalten ist der Bewertungserzählung hinzugefügt.

Der Stoff, das Gemisch oder die Expositionssituation wird gemäß dem Wortlaut einer der folgenden Kategorien beschrieben und die bezeichnete Gruppe angegeben. Die Kategorisierung eines Stoffs, Gemischs oder einer Expositionssituation ist eine Frage der wissenschaftlichen Beurteilung, die die Stärke der Beweise widerspiegelt, die aus Studien am Menschen und an Versuchstieren sowie aus anderen relevanten Daten stammen.

Gruppe 1

Der Stoff (das Gemisch) ist für den Menschen krebserzeugend. Der Expositionsfall beinhaltet Expositionen, die für den Menschen krebserzeugend sind.

Diese Kategorie wird verwendet, wenn ausreichende Hinweise auf Karzinogenität beim Menschen vorliegen. Ausnahmsweise kann ein Stoff (Gemisch) in diese Kategorie eingestuft werden, wenn der Nachweis beim Menschen nicht ausreicht, aber ausreichende Hinweise auf Karzinogenität bei Versuchstieren vorliegen und starke Hinweise bei exponierten Menschen vorliegen, dass der Stoff (das Gemisch) über einen relevanten Mechanismus der Karzinogenität wirkt .

Gruppe 2

In diese Kategorie fallen Arbeitsstoffe, Gemische und Expositionssituationen, für die einerseits der Beweisgrad der Kanzerogenität beim Menschen nahezu ausreichend ist, und andererseits solche, für die es keine Humandaten gibt, für die es aber Daten gibt Hinweise auf Karzinogenität bei Versuchstieren. Stoffe, Gemische und Expositionsumstände werden aufgrund epidemiologischer und experimenteller Hinweise auf Kanzerogenität und anderer relevanter Daten entweder der Gruppe 2A (wahrscheinlich krebserzeugend für den Menschen) oder der Gruppe 2B (möglicherweise krebserzeugend für den Menschen) zugeordnet.

Gruppe 2A. Der Stoff (das Gemisch) ist wahrscheinlich krebserzeugend für den Menschen. Der Expositionsfall bringt Expositionen mit sich, die wahrscheinlich krebserzeugend für den Menschen sind. Diese Kategorie wird verwendet, wenn begrenzte Hinweise auf Karzinogenität beim Menschen und ausreichende Hinweise auf Karzinogenität bei Versuchstieren vorliegen. In einigen Fällen kann ein Stoff (Gemisch) in diese Kategorie eingestuft werden, wenn es unzureichende Beweise für die Karzinogenität beim Menschen und ausreichende Beweise für die Karzinogenität bei Versuchstieren und starke Beweise dafür gibt, dass die Karzinogenese durch einen Mechanismus vermittelt wird, der auch beim Menschen funktioniert. Ausnahmsweise kann ein Stoff, ein Gemisch oder eine Expositionssituation nur aufgrund begrenzter Hinweise auf Karzinogenität beim Menschen in diese Kategorie eingestuft werden.

Gruppe 2B. Der Stoff (das Gemisch) ist möglicherweise krebserzeugend für den Menschen. Der Expositionsfall bringt Expositionen mit sich, die möglicherweise krebserzeugend für den Menschen sind. Diese Kategorie wird für Stoffe, Mischungen und Expositionsumstände verwendet, für die es begrenzte Hinweise auf eine Karzinogenität beim Menschen und weniger als ausreichende Hinweise auf eine Karzinogenität bei Versuchstieren gibt. Es kann auch verwendet werden, wenn es keine ausreichenden Beweise für die Karzinogenität beim Menschen gibt, aber ausreichende Beweise für die Karzinogenität bei Versuchstieren. In einigen Fällen können Stoffe, Gemische oder Expositionsumstände, für die unzureichende Beweise für die Karzinogenität beim Menschen, aber begrenzte Beweise für die Karzinogenität bei Versuchstieren zusammen mit unterstützenden Beweisen aus anderen relevanten Daten vorliegen, in diese Gruppe eingeordnet werden.

Gruppe 3

Der Stoff (Gemisch oder Expositionssituation) ist hinsichtlich seiner Karzinogenität für den Menschen nicht einstufbar. Diese Kategorie wird am häufigsten für Stoffe, Gemische und Expositionsumstände verwendet, für die der Nachweis der Karzinogenität beim Menschen unzureichend und bei Versuchstieren unzureichend oder begrenzt ist.

Ausnahmsweise können Stoffe (Gemische), deren Karzinogenität beim Menschen unzureichend, bei Versuchstieren jedoch ausreichend nachgewiesen ist, in diese Kategorie eingestuft werden, wenn starke Hinweise darauf vorliegen, dass der Mechanismus der Karzinogenität bei Versuchstieren beim Menschen nicht funktioniert.

Gruppe 4

Das Mittel (Gemisch) ist wahrscheinlich nicht krebserzeugend für den Menschen. Diese Kategorie wird für Stoffe oder Gemische verwendet, für die Hinweise auf mangelnde Karzinogenität beim Menschen und bei Versuchstieren vorliegen. In einigen Fällen können Stoffe oder Gemische, für die unzureichende Beweise für die Karzinogenität beim Menschen vorliegen, die jedoch Hinweise auf eine fehlende Karzinogenität bei Versuchstieren vermuten lassen, die durchgängig und stark durch eine breite Palette anderer relevanter Daten gestützt werden, in diese Gruppe eingeordnet werden.

Von Menschen gemachte Klassifikationssysteme sind nicht perfekt genug, um alle komplexen Entitäten der Biologie zu erfassen. Sie sind jedoch als Leitprinzipien nützlich und können modifiziert werden, wenn sich neue Erkenntnisse über die Karzinogenese fester etablieren. Bei der Einstufung eines Stoffs, Gemischs oder Expositionsfalls ist es unerlässlich, sich auf wissenschaftliche Urteile der Expertengruppe zu stützen.

Bisherige Ergebnisse

Bisher 69 Bände von IARC-Monographien erschienen oder im Druck sind, in denen für 836 Stoffe oder Expositionssituationen Bewertungen der Kanzerogenität für den Menschen vorgenommen wurden. 1 Stoffe oder Expositionen wurden als krebserzeugend für den Menschen (Gruppe 56), 2 als wahrscheinlich krebserzeugend für den Menschen (Gruppe 225A), 2 als möglicherweise krebserzeugend für den Menschen (Gruppe 4B) und einer als wahrscheinlich nicht krebserzeugend für den Menschen (Gruppe 480) bewertet ). Für 3 Stoffe oder Expositionen erlaubten die verfügbaren epidemiologischen und experimentellen Daten keine Bewertung ihrer Karzinogenität für den Menschen (Gruppe XNUMX).

Bedeutung mechanistischer Daten

Die überarbeitete Präambel, die erstmals in Band 54 der IARC-Monographien, lässt die Möglichkeit zu, dass ein Stoff, für den epidemiologische Beweise für Krebs weniger als ausreichend sind, in Gruppe 1 eingestuft werden kann, wenn es ausreichende Hinweise auf Karzinogenität bei Versuchstieren und starke Hinweise bei exponierten Menschen gibt, dass der Stoff über einen relevanten Mechanismus der Karzinogenität wirkt. Umgekehrt kann ein Stoff, für den unzureichende Beweise für die Karzinogenität beim Menschen zusammen mit ausreichenden Beweisen bei Versuchstieren und starken Beweisen dafür vorliegen, dass der Mechanismus der Karzinogenese beim Menschen nicht funktioniert, in Gruppe 3 anstelle der normalerweise zugewiesenen Gruppe 2B eingestuft werden – möglicherweise krebserregend für Menschen – Kategorie.

Die Verwendung solcher Daten zu Mechanismen wurde kürzlich bei drei Gelegenheiten diskutiert:

Während allgemein anerkannt ist, dass Sonnenstrahlung für den Menschen krebserzeugend ist (Gruppe 1), liefern epidemiologische Studien zu Krebs beim Menschen für UVA- und UVB-Strahlung von Höhensonnen nur begrenzte Hinweise auf eine krebserzeugende Wirkung. Spezielle Tandem-Basensubstitutionen (GCTTT) wurden in p53-Tumorsuppressionsgenen in Plattenepitheltumoren an sonnenexponierten Stellen beim Menschen beobachtet. Obwohl UVR in einigen experimentellen Systemen ähnliche Übergänge induzieren kann und UVB, UVA und UVC bei Versuchstieren karzinogen sind, wurden die verfügbaren mechanistischen Daten als nicht stark genug erachtet, um es der Arbeitsgruppe zu ermöglichen, UVB, UVA und UVC höher als Gruppe 2A einzustufen (IARC 1992 ). In einer nach dem Treffen veröffentlichten Studie (Kress et al. 1992) wurden CCTTT-Übergänge in p53 in UVB-induzierten Hauttumoren bei Mäusen nachgewiesen, was darauf hindeuten könnte, dass UVB auch als krebserzeugend für den Menschen einzustufen ist (Gruppe 1).

Der zweite Fall, in dem die Möglichkeit in Erwägung gezogen wurde, einen Wirkstoff in Gruppe 1 einzustufen, wenn keine ausreichenden epidemiologischen Beweise vorliegen, war 4,4´-Methylen-bis(2-Chloranilin) (MOCA). MOCA ist bei Hunden und Nagetieren krebserregend und umfassend genotoxisch. Es bindet an DNA durch Reaktion mit N-Hydroxy-MOCA, und die gleichen Addukte, die in Zielgeweben für Karzinogenität bei Tieren gebildet werden, wurden in Urothelzellen einer kleinen Anzahl exponierter Menschen gefunden. Nach langen Diskussionen über die Möglichkeit einer Hochstufung hat die Arbeitsgruppe schließlich eine Gesamtbewertung der Gruppe 2A, wahrscheinlich krebserzeugend für den Menschen, vorgenommen (IARC 1993).

Während einer kürzlich durchgeführten Bewertung von Ethylenoxid (IARC 1994b) lieferten die verfügbaren epidemiologischen Studien begrenzte Hinweise auf eine Karzinogenität beim Menschen, und Studien an Versuchstieren lieferten ausreichende Hinweise auf eine Karzinogenität. Unter Berücksichtigung der anderen relevanten Daten, dass (1) Ethylenoxid einen empfindlichen, anhaltenden, dosisabhängigen Anstieg der Häufigkeit von Chromosomenaberrationen und Schwesterchromatid-Austauschen in peripheren Lymphozyten und Mikronuklei in Knochenmarkszellen von exponierten Arbeitern induziert; (2) es wurde sowohl bei Menschen als auch bei Versuchstieren mit bösartigen Erkrankungen des lymphatischen und hämatopoetischen Systems in Verbindung gebracht; (3) es induziert eine dosisabhängige Zunahme der Häufigkeit von Hämoglobin-Addukten bei exponierten Menschen und eine dosisabhängige Zunahme der Anzahl von Addukten sowohl in DNA als auch in Hämoglobin bei exponierten Nagetieren; (4) es induziert Genmutationen und vererbbare Translokationen in Keimzellen exponierter Nagetiere; und (5) es ist ein starkes Mutagen und Klastogen auf allen phylogenetischen Ebenen; Ethylenoxid wurde als krebserzeugend für den Menschen (Gruppe 1) eingestuft.

In dem Fall, in dem die Präambel die Möglichkeit zulässt, dass ein Stoff, für den es ausreichende Beweise für die Karzinogenität bei Tieren gibt, in Gruppe 3 eingestuft werden kann (anstelle von Gruppe 2B, in die er normalerweise eingestuft würde), wenn es starke Beweise dafür gibt, dass die Mechanismus der Kanzerogenität bei Tieren beim Menschen nicht funktioniert, wurde diese Möglichkeit bisher noch von keiner Arbeitsgruppe genutzt. Eine solche Möglichkeit hätte im Fall von in Betracht gezogen werden können d-Limonen hätte es genügend Beweise für seine Karzinogenität bei Tieren gegeben, da es Daten gibt, die darauf hindeuten, dass α2-Mikroglobulin-Produktion in männlichen Rattennieren ist mit den beobachteten Nierentumoren verbunden.

Unter den vielen Chemikalien, die im Dezember 1993 von einer Ad-hoc-Arbeitsgruppe als Prioritäten nominiert wurden, tauchten einige allgemein postulierte intrinsische Wirkungsmechanismen auf oder bestimmte Klassen von Wirkstoffen wurden auf der Grundlage ihrer biologischen Eigenschaften identifiziert. Die Arbeitsgruppe empfahl, dass vorab Bewertungen zu Wirkstoffen wie Peroxisom-Proliferatoren, Fasern, Stäuben und thyreostatischen Wirkstoffen vorgenommen werden Monographien Programms sollten spezielle Ad-hoc-Gruppen einberufen werden, um den neuesten Stand der Technik zu ihren besonderen Wirkungsmechanismen zu erörtern.

Die biologische Grundlage für die Expositionsbewertung

Die Expositionsbeurteilung am Arbeitsplatz befasst sich mit der Identifizierung und Bewertung von Stoffen, mit denen ein Arbeiter in Kontakt kommen kann, und Expositionsindizes können so konstruiert werden, dass sie die Menge eines Stoffs widerspiegeln, der in der allgemeinen Umgebung oder in der eingeatmeten Luft vorhanden ist, sowie die Menge von Wirkstoff, der tatsächlich eingeatmet, geschluckt oder anderweitig aufgenommen wird (die Einnahme). Andere Indizes umfassen die resorbierte Wirkstoffmenge (die Aufnahme) und die Exposition am Zielorgan. Dosis ist ein pharmakologischer oder toxikologischer Begriff, der verwendet wird, um die Menge einer Substanz anzugeben, die einem Subjekt verabreicht wird. Die Dosisrate ist die Menge, die pro Zeiteinheit verabreicht wird. Die Dosis einer Arbeitsplatzexposition ist in der Praxis schwer zu bestimmen, da physikalische und biologische Prozesse wie Einatmen, Aufnahme und Verteilung eines Arbeitsstoffs im menschlichen Körper dazu führen, dass Exposition und Dosis in komplexen, nichtlinearen Beziehungen stehen. Die Ungewissheit über die tatsächliche Höhe der Exposition gegenüber Arbeitsstoffen erschwert zudem die Quantifizierung von Zusammenhängen zwischen Exposition und gesundheitlichen Auswirkungen.

Für viele berufliche Expositionen gibt es a Zeitfenster während der die Exposition oder Dosis für die Entwicklung eines bestimmten gesundheitlichen Problems oder Symptoms am relevantesten ist. Daher wäre die biologisch relevante Exposition oder Dosis diejenige Exposition, die während des relevanten Zeitfensters auftritt. Es wird angenommen, dass einige Expositionen gegenüber berufsbedingten Karzinogenen ein solches relevantes Zeitfenster der Exposition haben. Krebs ist eine Krankheit mit einer langen Latenzzeit, und daher könnte es sein, dass die Exposition, die mit der endgültigen Entwicklung der Krankheit zusammenhängt, viele Jahre vor der tatsächlichen Manifestation des Krebses stattgefunden hat. Dieses Phänomen ist kontraintuitiv, da man erwartet hätte, dass die kumulative Exposition über ein Arbeitsleben der relevante Parameter gewesen wäre. Die Exposition zum Zeitpunkt der Manifestation der Krankheit ist möglicherweise nicht von besonderer Bedeutung.

Das Expositionsmuster – kontinuierliche Exposition, intermittierende Exposition und Exposition mit oder ohne scharfe Spitzen – kann ebenfalls relevant sein. Die Berücksichtigung von Expositionsmustern ist sowohl für epidemiologische Studien als auch für Umweltmessungen wichtig, die zur Überwachung der Einhaltung von Gesundheitsstandards oder zur Umweltkontrolle im Rahmen von Kontroll- und Präventionsprogrammen verwendet werden können. Wenn zum Beispiel eine gesundheitliche Auswirkung durch Spitzenbelastungen verursacht wird, müssen diese Spitzenwerte überwacht werden können, um kontrolliert werden zu können. Eine Überwachung, die nur Daten über langfristige durchschnittliche Expositionen liefert, ist nicht sinnvoll, da die Spitzenabweichungswerte durch die Mittelwertbildung möglicherweise überdeckt werden und sicherlich nicht während ihres Auftretens kontrolliert werden können.

Die biologisch relevante Exposition oder Dosis für einen bestimmten Endpunkt ist oft nicht bekannt, weil die Aufnahme-, Aufnahme-, Verteilungs- und Ausscheidungsmuster oder die Mechanismen der Biotransformation nicht ausreichend genau verstanden werden. Sowohl die Geschwindigkeit, mit der ein Stoff in den Körper eintritt und ihn verlässt (die Kinetik), als auch die biochemischen Prozesse zum Umgang mit dem Stoff (Biotransformation) helfen dabei, die Beziehungen zwischen Exposition, Dosis und Wirkung zu bestimmen.

Umweltüberwachung ist die Messung und Bewertung von Arbeitsstoffen am Arbeitsplatz, um die Umweltbelastung und die damit verbundenen Gesundheitsrisiken zu bewerten. Biologisches Monitoring ist die Messung und Bewertung von Arbeitsstoffen oder deren Metaboliten in Geweben, Sekreten oder Exkrementen, um die Exposition zu bewerten und Gesundheitsrisiken abzuschätzen. Manchmal Biomarker, wie DNA-Addukte, werden als Expositionsmaß verwendet. Biomarker können auch auf die Mechanismen des Krankheitsprozesses selbst hinweisen, aber dies ist ein komplexes Thema, das in diesem Kapitel ausführlicher behandelt wird Biologische Überwachung und später in der Diskussion hier.

Eine Vereinfachung des Grundmodells in der Expositions-Wirkungs-Modellierung lautet wie folgt:

Belichtung ![]() Aufnahme

Aufnahme ![]() Verteilung,

Verteilung,

Eliminierung, Umwandlung![]() Zieldosis

Zieldosis![]() Physiopathologie

Physiopathologie![]() bewirken

bewirken

Je nach Agens können Expositions-Aufnahme- und Expositions-Aufnahme-Beziehungen komplex sein. Für viele Gase lassen sich anhand der Konzentration des Arbeitsstoffes in der Luft im Laufe eines Arbeitstages und der eingeatmeten Luftmenge einfache Näherungswerte machen. Bei der Staubprobenahme hängen die Ablagerungsmuster auch von der Partikelgröße ab. Größenüberlegungen können auch zu einer komplexeren Beziehung führen. Das Kapitel Atmungssystem näher auf den Aspekt der Atemwegstoxizität ein.

Expositions- und Dosisabschätzung sind Elemente der quantitativen Risikoabschätzung. Methoden zur Bewertung von Gesundheitsrisiken bilden häufig die Grundlage, auf der Expositionsgrenzwerte für Emissionswerte von toxischen Stoffen in der Luft sowohl für Umwelt- als auch für Berufsstandards festgelegt werden. Die Gesundheitsrisikoanalyse liefert eine Schätzung der Wahrscheinlichkeit (Risiko) des Auftretens bestimmter gesundheitlicher Auswirkungen oder eine Schätzung der Anzahl der Fälle mit diesen gesundheitlichen Auswirkungen. Mittels Gesundheitsrisikoanalyse kann eine akzeptable Konzentration eines Giftstoffes in Luft, Wasser oder Lebensmitteln angegeben werden a priori gewählte akzeptable Größe des Risikos. Die quantitative Risikoanalyse hat eine Anwendung in der Krebsepidemiologie gefunden, was die starke Betonung der retrospektiven Expositionsbewertung erklärt. Aber Anwendungen ausgefeilterer Expositionsbewertungsstrategien können sowohl in der retrospektiven als auch in der prospektiven Expositionsbewertung gefunden werden, und die Prinzipien der Expositionsbewertung haben auch in Studien Anwendung gefunden, die sich auf andere Endpunkte konzentrierten, wie etwa gutartige Atemwegserkrankungen (Wegman et al. 1992; Post et al. 1994). Derzeit dominieren zwei Forschungsrichtungen. Die eine verwendet Dosisschätzungen aus Expositionsüberwachungsinformationen, die andere stützt sich auf Biomarker als Maß für die Exposition.

Expositionsüberwachung und Dosisvorhersage

Leider sind für viele Expositionen nur wenige quantitative Daten verfügbar, um das Risiko für die Entwicklung eines bestimmten Endpunkts vorherzusagen. Bereits 1924 postulierte Haber, dass die Schwere der gesundheitlichen Wirkung (H) proportional zum Produkt aus Expositionskonzentration (X) und Expositionszeit (T) ist:

H=X x T

Das so genannte Habersche Gesetz bildete die Grundlage für die Entwicklung des Konzepts, dass Expositionsmessungen mit zeitlich gewichtetem Durchschnitt (TWA) – dh über einen bestimmten Zeitraum durchgeführte und gemittelte Messungen – ein nützliches Maß für die Exposition wären. Diese Annahme über die Angemessenheit des zeitgewichteten Durchschnitts wird seit vielen Jahren in Frage gestellt. 1952 stellten Adams und Mitarbeiter fest, dass „es keine wissenschaftliche Grundlage für die Verwendung des zeitgewichteten Mittelwerts gibt, um unterschiedliche Expositionen zu integrieren …“ (in Atherly 1985). Das Problem ist, dass viele Beziehungen komplexer sind als die Beziehung, die das Habersche Gesetz darstellt. Es gibt viele Beispiele von Mitteln, bei denen die Wirkung stärker von der Konzentration als von der Zeitdauer bestimmt wird. Beispielsweise haben interessante Beweise aus Laborstudien gezeigt, dass bei Tetrachlorkohlenstoff ausgesetzten Ratten das Expositionsmuster (kontinuierlich versus intermittierend und mit oder ohne Spitzen) sowie die Dosis das beobachtete Risiko für die Entwicklung von Veränderungen des Leberenzymspiegels bei Ratten verändern können (Bogers et al. 1987). Ein weiteres Beispiel sind Bioaerosole wie das α-Amylase-Enzym, ein Teigverbesserer, der bei Beschäftigten in der Backindustrie allergische Erkrankungen hervorrufen kann (Houba et al. 1996). Es ist nicht bekannt, ob das Risiko, an einer solchen Krankheit zu erkranken, hauptsächlich von der Spitzenexposition, der durchschnittlichen Exposition oder der kumulativen Expositionshöhe bestimmt wird. (Wong 1987; Checkoway und Rice 1992). Informationen zu zeitlichen Mustern sind für die meisten Wirkstoffe nicht verfügbar, insbesondere nicht für Wirkstoffe mit chronischen Wirkungen.

Die ersten Versuche, Expositionsmuster zu modellieren und die Dosis abzuschätzen, wurden in den 1960er und 1970er Jahren von Roach (1966; 1977) veröffentlicht. Er zeigte, dass die Konzentration eines Agens am Rezeptor nach einer Exposition von unendlicher Dauer einen Gleichgewichtswert erreicht, weil die Elimination die Aufnahme des Agens ausgleicht. Bei einer achtstündigen Exposition kann ein Wert von 90 % dieses Gleichgewichtsniveaus erreicht werden, wenn die Halbwertszeit des Wirkstoffs am Zielorgan kleiner als etwa zweieinhalb Stunden ist. Dies verdeutlicht, dass bei Wirkstoffen mit kurzer Halbwertszeit die Dosis am Zielorgan durch eine Exposition von weniger als acht Stunden bestimmt wird. Die Dosis am Zielorgan ist bei Wirkstoffen mit langer Halbwertszeit eine Funktion des Produkts aus Einwirkzeit und Konzentration. Ein ähnlicher, aber ausgefeilterer Ansatz wurde von Rappaport (1985) angewandt. Er zeigte, dass die Variabilität der Exposition innerhalb eines Tages einen begrenzten Einfluss hat, wenn es um Wirkstoffe mit langen Halbwertszeiten geht. Er hat den Begriff eingeführt Dämpfung am Empfänger.

Die oben dargestellten Informationen wurden hauptsächlich verwendet, um Schlussfolgerungen zu angemessenen Mittelungszeiten für Expositionsmessungen für Konformitätszwecke zu ziehen. Seit den Veröffentlichungen von Roach ist allgemein bekannt, dass für Reizstoffe Stichproben mit kurzen Mittelungszeiten genommen werden müssen, während für Stoffe mit langen Halbwertszeiten, wie Asbest, der Langzeitdurchschnitt der kumulativen Exposition angenähert werden muss. Man sollte sich jedoch darüber im Klaren sein, dass die Dichotomisierung in Stichprobenstrategien und XNUMX-Stunden-Zeitdurchschnitts-Expositionsstrategien, wie sie in vielen Ländern für Compliance-Zwecke angenommen wird, eine äußerst grobe Übersetzung der oben diskutierten biologischen Prinzipien ist.

Ein Beispiel für die Verbesserung einer Expositionsbewertungsstrategie basierend auf pharmakokinetischen Prinzipien in der Epidemiologie findet sich in einem Artikel von Wegman et al. (1992). Sie wendeten eine interessante Strategie zur Expositionsbewertung an, indem sie kontinuierliche Überwachungsgeräte verwendeten, um die Spitzenwerte der persönlichen Staubexposition zu messen und diese mit akuten reversiblen Atemwegssymptomen in Beziehung zu setzen, die alle 15 Minuten auftreten. Ein konzeptionelles Problem bei dieser Art von Studie, das in ihrem Artikel ausführlich diskutiert wird, ist die Definition einer gesundheitsrelevanten Spitzenbelastung. Die Definition eines Peaks hängt wiederum von biologischen Erwägungen ab. Rappaport (1991) gibt zwei Voraussetzungen dafür, dass Spitzenbelastungen im Krankheitsprozess von ätiologischer Relevanz sind: (1) das Agens wird schnell aus dem Körper eliminiert und (2) es gibt eine nichtlineare Rate biologischer Schäden während einer Spitzenbelastung. Nichtlineare Raten biologischer Schäden können mit Änderungen der Aufnahme zusammenhängen, die wiederum mit Expositionsniveaus, Wirtsanfälligkeit, Synergie mit anderen Expositionen, Beteiligung anderer Krankheitsmechanismen bei höheren Expositionen oder Schwellenwerten für Krankheitsprozesse zusammenhängen.

Diese Beispiele zeigen auch, dass pharmakokinetische Ansätze anderswohin führen können als zu Dosisschätzungen. Die Ergebnisse der pharmakokinetischen Modellierung können auch verwendet werden, um die biologische Relevanz bestehender Expositionsindizes zu untersuchen und neue gesundheitsrelevante Expositionsbewertungsstrategien zu entwerfen.

Die pharmakokinetische Modellierung der Exposition kann auch Schätzungen der tatsächlichen Dosis am Zielorgan liefern. Beispielsweise wurden für Ozon, ein akutes Reizgas, Modelle entwickelt, die die Gewebekonzentration in den Atemwegen als Funktion der durchschnittlichen Ozonkonzentration im Luftraum der Lunge in einem bestimmten Abstand von der Luftröhre, dem Radius, vorhersagen der Atemwege, die durchschnittliche Luftgeschwindigkeit, die effektive Dispersion und der Ozonfluss von der Luft zur Lungenoberfläche (Menzel 1987; Miller und Overton 1989). Solche Modelle können verwendet werden, um die Ozondosis in einem bestimmten Bereich der Atemwege abhängig von Ozonkonzentrationen und Atmungsmustern in der Umgebung vorherzusagen.

In den meisten Fällen basieren Schätzungen der Zieldosis auf Informationen über das zeitliche Expositionsmuster, den beruflichen Werdegang und pharmakokinetische Informationen über Aufnahme, Verteilung, Elimination und Umwandlung des Wirkstoffs. Der gesamte Prozess kann durch einen mathematisch lösbaren Satz von Gleichungen beschrieben werden. Oft sind Informationen zu pharmakokinetischen Parametern für den Menschen nicht verfügbar, und Parameterschätzungen auf der Grundlage von Tierversuchen müssen verwendet werden. Inzwischen gibt es mehrere Beispiele für die Verwendung von pharmakokinetischen Expositionsmodellen zur Generierung von Dosisschätzungen. Die ersten Verweise auf die Modellierung von Expositionsdaten in Dosisschätzungen in der Literatur gehen auf die Arbeit von Jahr (1974) zurück.

Obwohl Dosisschätzungen im Allgemeinen nicht validiert sind und nur begrenzte Anwendung in epidemiologischen Studien gefunden haben, wird erwartet, dass die neue Generation von Expositions- oder Dosisindizes zu optimalen Expositions-Wirkungs-Analysen in epidemiologischen Studien führt (Smith 1985, 1987). Ein Problem, das bei der pharmakokinetischen Modellierung noch nicht angegangen wurde, besteht darin, dass große Unterschiede zwischen den Spezies in der Kinetik toxischer Wirkstoffe bestehen und daher die Auswirkungen der intra-individuellen Variation der pharmakokinetischen Parameter von Interesse sind (Droz 1992).

Biomonitoring und Biomarker der Exposition

Die biologische Überwachung bietet eine Dosisschätzung und wird daher der Umweltüberwachung oft als überlegen angesehen. Die intraindividuelle Variabilität von Biomonitoring-Indizes kann jedoch beträchtlich sein. Um eine akzeptable Abschätzung der Dosis eines Arbeiters abzuleiten, müssen wiederholte Messungen durchgeführt werden, und manchmal kann der Messaufwand größer werden als bei der Umweltüberwachung.

Dies zeigt eine interessante Studie über Arbeiter, die Boote aus glasfaserverstärktem Kunststoff herstellen (Rappaport et al. 1995). Die Variabilität der Styrolbelastung wurde durch wiederholte Messung von Styrol in Luft bewertet. Styrol in der ausgeatmeten Luft von exponierten Arbeitern wurde überwacht, ebenso wie Schwesterchromatid-Austausche (SCEs). Sie zeigten, dass eine epidemiologische Studie, die Styrol in der Luft als Expositionsmaß verwendet, hinsichtlich der Anzahl der erforderlichen Messungen effizienter wäre als eine Studie, die die anderen Expositionsindizes verwendet. Für Styrol in Luft waren drei Wiederholungen erforderlich, um die langfristige durchschnittliche Exposition mit einer gegebenen Genauigkeit abzuschätzen. Für Styrol in der ausgeatmeten Luft waren vier Wiederholungen pro Arbeiter erforderlich, während für die SCE 20 Wiederholungen erforderlich waren. Die Erklärung für diese Beobachtung ist das Signal-Rausch-Verhältnis, bestimmt durch die Expositionsvariabilität von Tag zu Tag und zwischen Arbeitern, das für Styrol in der Luft günstiger war als für die beiden Biomarker der Exposition. Obwohl die biologische Relevanz eines bestimmten Expositionssurrogats möglicherweise optimal ist, kann die Leistung in einer Expositions-Wirkungs-Analyse aufgrund eines begrenzten Signal-Rausch-Verhältnisses dennoch schlecht sein, was zu Fehlklassifizierungsfehlern führt.

Droz (1991) wendete pharmakokinetische Modelle an, um die Vorteile von Expositionsbewertungsstrategien auf der Grundlage von Luftproben im Vergleich zu Biomonitoring-Strategien in Abhängigkeit von der Halbwertszeit des Wirkstoffs zu untersuchen. Er zeigte, dass das biologische Monitoring auch stark von der biologischen Variabilität beeinflusst wird, die nicht mit der Variabilität des toxikologischen Tests zusammenhängt. Er schlug vor, dass es keinen statistischen Vorteil bei der Verwendung biologischer Indikatoren gibt, wenn die Halbwertszeit des betrachteten Mittels kleiner als etwa zehn Stunden ist.

Auch wenn man sich aufgrund der Variabilität der Messgröße eher für die Messung der Umweltexposition anstelle eines biologischen Indikators einer Wirkung entscheiden könnte, lassen sich zusätzliche Argumente für die Wahl eines Biomarkers finden, auch wenn dies zu einem größeren Messaufwand führen würde, wie z wenn eine erhebliche dermale Exposition vorliegt. Bei Stoffen wie Pestiziden und einigen organischen Lösungsmitteln kann die dermale Exposition von größerer Bedeutung sein als die Exposition über die Luft. Ein Expositions-Biomarker würde diesen Expositionsweg einschließen, während die Messung der dermalen Exposition komplex und die Ergebnisse nicht leicht interpretierbar sind (Boleij et al. 1995). Frühe Studien unter Landarbeitern, die „Pads“ zur Beurteilung der Hautbelastung verwendeten, zeigten bemerkenswerte Verteilungen von Pestiziden über die Körperoberfläche, abhängig von den Aufgaben des Arbeiters. Da jedoch nur wenige Informationen zur Hautaufnahme vorliegen, können Expositionsprofile noch nicht zur Abschätzung einer inneren Dosis verwendet werden.

Auch in der Krebsepidemiologie können Biomarker erhebliche Vorteile haben. Wenn ein Biomarker ein früher Marker für die Wirkung ist, könnte seine Verwendung zu einer Verkürzung des Nachbeobachtungszeitraums führen. Obwohl Validierungsstudien erforderlich sind, könnten Biomarker der Exposition oder der individuellen Anfälligkeit zu aussagekräftigeren epidemiologischen Studien und genaueren Risikoabschätzungen führen.

Zeitfensteranalyse

Parallel zur Entwicklung der pharmakokinetischen Modellierung haben Epidemiologen neue Ansätze in der Datenanalysephase untersucht, wie z. B. die „Zeitrahmenanalyse“, um relevante Expositionszeiträume mit Endpunkten in Beziehung zu setzen und Auswirkungen zeitlicher Muster bei der Exposition oder Expositionsspitzen in der beruflichen Krebsepidemiologie zu implementieren (Checkoway und Reis 1992). Konzeptionell ist diese Technik mit der pharmakokinetischen Modellierung verwandt, da die Beziehung zwischen Exposition und Ergebnis optimiert wird, indem unterschiedliche Expositionszeiträume, Expositionsmuster und Expositionsniveaus gewichtet werden. Bei der pharmakokinetischen Modellierung wird angenommen, dass diese Gewichte eine physiologische Bedeutung haben, und sie werden im Voraus geschätzt. Bei der Zeitrahmenanalyse werden die Gewichte anhand statistischer Kriterien aus den Daten geschätzt. Beispiele für diesen Ansatz werden von Hodgson und Jones (1990) gegeben, die die Beziehung zwischen Radongasbelastung und Lungenkrebs in einer Kohorte britischer Zinnminenarbeiter analysierten, und von Seixas, Robins und Becker (1993), die die Beziehung zwischen Staub analysierten Exposition und Gesundheit der Atemwege in einer Kohorte von US-Kohlenarbeitern. Eine sehr interessante Studie, die die Relevanz der Zeitfensteranalyse unterstreicht, ist die von Peto et al. (1982).

Sie zeigten, dass die Mesotheliom-Sterblichkeitsraten proportional zu einer gewissen Funktion der Zeit seit der ersten Exposition und der kumulativen Exposition in einer Kohorte von Isolierarbeitern zu sein schienen. Die Zeit seit der ersten Exposition war von besonderer Relevanz, da diese Variable eine Annäherung an die Zeit war, die eine Faser benötigt, um von ihrem Ablageort in der Lunge zum Brustfell zu wandern. Dieses Beispiel zeigt, wie die Kinetik der Ablagerung und Migration die Risikofunktion maßgeblich bestimmt. Ein potenzielles Problem bei der Zeitrahmenanalyse besteht darin, dass sie detaillierte Informationen über Expositionszeiträume und Expositionsniveaus erfordert, was ihre Anwendung in vielen Studien über die Folgen chronischer Krankheiten behindert.

Abschließende Bemerkungen

Zusammenfassend sind die zugrunde liegenden Prinzipien der pharmakokinetischen Modellierung und der Zeitrahmen- oder Zeitfensteranalyse weithin anerkannt. Das Wissen auf diesem Gebiet wurde hauptsächlich zur Entwicklung von Strategien zur Expositionsbewertung verwendet. Eine weitergehende Nutzung dieser Ansätze erfordert jedoch einen erheblichen Forschungsaufwand und muss entwickelt werden. Die Zahl der Bewerbungen ist daher noch begrenzt. Relativ einfache Anwendungen, wie die Entwicklung optimaler Strategien zur Expositionsbewertung in Abhängigkeit vom Endpunkt, haben eine breitere Anwendung gefunden. Ein wichtiges Thema bei der Entwicklung von Expositions- oder Wirkungs-Biomarkern ist die Validierung dieser Indizes. Oft wird angenommen, dass ein messbarer Biomarker das Gesundheitsrisiko besser vorhersagen kann als herkömmliche Methoden. Leider untermauern nur sehr wenige Validierungsstudien diese Annahme.

Anhang: Overall Evaluations of Carcinogenicity to Humans: IARC Monographs Volumes 1-69 (836)

Gruppe 1 – Karzinogen für den Menschen (74)

Agenten und Gruppen von Agenten

Aflatoxine [1402-68-2] (1993)

4-Aminobiphenyl [92-67-1]

Arsen [7440-38-2] und Arsenverbindungen2

Asbest [1332-21-4]

Azathioprin [446-86-6]

Benzol [71-43-2]

Benzidin [92-87-5]

Beryllium [7440-41-7] und Berylliumverbindungen (1993)3

Bis(2-chloroethyl)-2-naphthylamine (Chlornaphazine)[494-03-1]

Bis(chlormethyl)ether [542-88-1] und Chlormethylmethylether [107-30-2] (technisch)

1,4-Butandioldimethansulfonat (Myleran) [55-98-1]

Cadmium [7440-43-9] und Cadmiumverbindungen (1993)3

Chlorambucil [305-03-3]

1-(2-Chloroethyl)-3-(4-methylcyclohexyl)-1-nitrosourea (Methyl-CCNU; Semustine) [13909-09-6]

Chrom[VI]-Verbindungen (1990)3

Ciclosporin [79217-60-0] (1990)

Cyclophosphamide [50-18-0] [6055-19-2]

Diethylstilboöstrol [56-53-1]

Erionit [66733-21-9]

Ethylenoxid4 [75-21-8] (1994)

Helicobacter pylori (Infektion mit) (1994)

Hepatitis-B-Virus (chronische Infektion mit) (1993)

Hepatitis-C-Virus (chronische Infektion mit) (1993)

Humanes Papillomavirus Typ 16 (1995)

Humanes Papillomavirus Typ 18 (1995)

Humanes T-Zell-lymphotropes Virus Typ I (1996)

Melphalan [148-82-3]

8-Methoxypsoralen (Methoxsalen) [298-81-7] plus UV-A-Strahlung

MOPP und andere kombinierte Chemotherapien einschließlich Alkylanzien

Senfgas (Schwefelsenf) [505-60-2]

2-Naphthylamin [91-59-8]

Nickelverbindungen (1990)3

Östrogenersatztherapie

Östrogene, nichtsteroidal2

Östrogene, steroidal2

Opisthorchis viverrini (Infektion mit) (1994)

Orale Kontrazeptiva, kombiniert5

Orale Kontrazeptiva, sequentiell

Radon [10043-92-2] und seine Zerfallsprodukte (1988)

Schistosoma haematobium (Infektion mit) (1994)

Kieselsäure [14808-60-7] kristallin (inhaliert in Form von Quarz oder Cristobalit aus beruflichen Quellen)

Sonnenstrahlung (1992)

Talk, der asbestiforme Fasern enthält

Tamoxifen [10540-29-1]6

Thiotepa [52-24-4] (1990)

Treosulfan [299-75-2]

Vinylchlorid [75-01-4]

Mischungen

Alkoholische Getränke (1988)

Analgetische Mischungen, die Phenacetin enthalten

Betelpfand mit Tabak

Kohlenteerplätze [65996-93-2]

Kohlenteere [8007-45-2]

Mineralöle, unbehandelt und mild behandelt

Gesalzener Fisch (chinesischer Stil) (1993)

Schieferöle [68308-34-9]

Ruß

Tabakwaren, rauchfrei

Tabakrauch

Holzstaub

Expositionsumstände

Aluminiumproduktion

Auramin, Herstellung von

Herstellung und Reparatur von Stiefeln und Schuhen

Kohlevergasung

Cola-Produktion

Möbel- und Möbelbau

Hämatitabbau (Untertage) mit Radonbelastung

Eisen- und Stahlgießen

Isopropanolherstellung (Starksäureverfahren)

Magenta, Herstellung von (1993)

Maler (Ausbildung als A) (1989)

Gummiindustrie

Schwefelsäurehaltige Nebel starker anorganischer Säuren (berufliche Exposition gegenüber) (1992)

Gruppe 2A – Wahrscheinlich krebserregend für den Menschen (56)

Agenten und Gruppen von Agenten

Acrylamid [79-06-1] (1994)8

Acrylnitril [107-13-1]

Adriamycin8 [23214-92-8]

Androgene (anabole) Steroide

Azacitidin8 [320-67-2] (1990)

Benz[a]Anthracen8 [56-55-3]

Farbstoffe auf Benzidinbasis8

Benzo[a]Pyren8 [50-32-8]

Bischlorethylnitrosoharnstoff (BCNU) [154-93-8]

1,3-Butadiene [106-99-0] (1992)

Captafol [2425-06-1] (1991)

Chloramphenicol [56-75-7] (1990)

1-(2-Chlorethyl)-3-cyclohexyl-1-nitrosoharnstoff8 (CCNU)[13010-47-4]

p-Chlor-o-Toluidin [95-69-2] und seine Salze starker Säuren (1990)3

Chlorzotocin8 [54749-90-5] (1990)

Cisplatin8 [15663-27-1]

Clonorchis sinensis (Infektion mit)8 (1994)

Dibenz[Ah]Anthracen8 [53-70-3]

Diethylsulfat [64-67-5] (1992)

Dimethylcarbamoylchlorid8 [79-44-7]

Dimethylsulfat8 [77-78-1]

Epichlorhydrin8 [106-89-8]

Ethylendibromid8 [106-93-4]

N-Ethyl-N-Nitrosoharnstoff8 [759-73-9]

Formaldehyd [50-00-0])

IQ8 (2-Amino-3-methylimidazo[4,5-f]Chinolin) [76180-96-6] (1993)

5-Methoxypsoralen8 [484-20-8]

4,4´-Methylenbis(2-chloranilin) (MOCA)8 [101-14-4] (1993)

N-Methyl-N´-nitro-N-nitrosoguanidin8 (MNNG) [70-25-7]

N-Methyl-N-nitrosoharnstoff8 [684-93-5]

Stickstoffsenf [51-75-2]

N-Nitrosodiethylamin8 [55-18-5]

N-Nitrosodimethylamin 8 [62-75-9]

Phenacetin [62-44-2]

Procarbazinhydrochlorid8 [366-70-1]

Tetrachlorethylen [127-18-4]

Trichlorethylen [79-01-6]

Styrol-7,8-oxid8 [96-09-3] (1994)

Tris(2,3-dibrompropyl)phosphat8 [126-72-7]

Ultraviolette Strahlung A8 (1992)

UV-Strahlung B8 (1992)

Ultraviolette Strahlung C8 (1992)

Vinylbromid6 [593-60-2]

Vinylfluorid [75-02-5]

Mischungen

Kreosot [8001-58-9]

Dieselmotor-Auspuff (1989)

Heißer Kumpel (1991)

Arsenfreie Insektizide (berufliche Expositionen beim Versprühen und Ausbringen) (1991)

Polychlorierte Biphenyle [1336-36-3]

Expositionsumstände

Kunstglas, Glasbehälter und Pressware (Herstellung von) (1993)

Friseur oder Barbier (berufliche Exposition als a) (1993)

Erdölraffination (berufliche Expositionen in) (1989)

Höhensonne und Solarium (Nutzung) (1992)

Gruppe 2B – Möglicherweise krebserzeugend für den Menschen (225)

Agenten und Gruppen von Agenten

A–α–C (2-Amino-9H-Pyrido[2,3-b]Indol) [26148-68-5]

Acetaldehyd [75-07-0]

Acetamid [60-35-5]

AF-2 [2-(2-Furyl)-3-(5-nitro-2-furyl)acrylamide] [3688-53-7]

Aflatoxin M1 [6795-23-9] (1993)

p-Aminoazobenzol [60-09-3]

o-Aminoazotoluol [97-56-3]

2-Amino-5-(5-nitro-2-furyl)-1,3,4-thiadiazole [712-68-5]

Amitrol [61-82-5]

o-Anisidin [90-04-0]

Antimontrioxid [1309-64-4] (1989)

Aramit [140-57-8]

Atrazin9 [1912-24-9] (1991)

Auramin [492-80-8] (technische Qualität)

Azaserin [115-02-6]

Benzo[b]Fluoranthen [205-99-2]

Benzo[j]Fluoranthen [205-82-3]

Benzo[k]Fluoranthen [207-08-9]

Benzylviolett 4B [1694-09-3]

Bleomycine [11056-06-7]

Adlerfarn

Bromdichlormethan [75-27-4] (1991)

Butylhydroxyanisol (BHA) [25013-16-5]

β-Butyrolacton [3068-88-0]

Kaffeesäure [331-39-5] (1993)

Rußextrakte

Tetrachlorkohlenstoff [56-23-5]

Keramische Fasern

Chlordan [57-74-9] (1991)

Chlordecon (Kepon) [143-50-0]

Chlorensäure [115-28-6] (1990)

α-chlorierte Toluole (Benzylchlorid, Benzalchlorid, Benzotrichlorid)

p-Chloranilin [106-47-8] (1993)

Chloroform [67-66-3]

1-Chloro-2-methylpropene [513-37-1]

Chlorphenole

Chlorphenoxy-Herbizide

4-Chlor-o-Phenylendiamin [95-83-0]

CI Säurerot 114 [6459-94-5] (1993)

CI Basisrot 9 [569-61-9] (1993)

CI Direktblau 15 [2429-74-5] (1993)

Zitrusrot Nr. 2 [6358-53-8]

Kobalt [7440-48-4] und Kobaltverbindungen3 (1991)

p-Cresidin [120-71-8]

Cycasin [14901-08-7]

Dacarbazin [4342-03-4]

Dantron (Chrysazin; 1,8-Dihydroxyanthrachinon) [117-10-2] (1990)

Daunomycin [20830-81-3]

DDT´-DDT, 50-29-3] (1991)

N,N´-Diacetylbenzidin [613-35-4]

2,4-Diaminoanisol [615-05-4]

4,4´-Diaminodiphenylether [101-80-4]

2,4-Diaminotoluol [95-80-7]

Dibenz[Ah]Acridin [226-36-8]

Dibenz[ein,j]Acridin [224-42-0]

7H-Dibenzo[c, g]Carbazol [194-59-2]

Dibenzo[a, e]Pyren [192-65-4]

Dibenzo[Ah]Pyren [189-64-0]

Dibenzo[ein, ich]Pyren [189-55-9]

Dibenzo[a, l]Pyren [191-30-0]

1,2-Dibromo-3-chloropropane [96-12-8]

p-Dichlorbenzol [106-46-7]

3,3´-Dichlorbenzidin [91-94-1]

3,3´-Dichloro-4,4´-diaminodiphenyl ether [28434-86-8]

1,2-Dichlorethan [107-06-2]

Dichlormethan (Methylenchlorid) [75-09-2]

1,3-Dichlorpropen [542-75-6] (technische Qualität)

Dichlorvos [62-73-7] (1991)

Diepoxybutan [1464-53-5]

Di(2-ethylhexyl)phthalat [117-81-7]

1,2-Diethylhydrazin [1615-80-1]

Diglycidylresorcinether [101-90-6]

Dihydrosafrol [94-58-6]

Diisopropylsulfat [2973-10-6] (1992)

3,3´-Dimethoxybenzidin (o-Dianisidin) [119-90-4]

p-Dimethylaminoazobenzol [60-11-7]

trans-2-[(Dimethylamino)methylimino]-5-[2-(5-nitro-2-furyl)-vinyl]-1,3,4-oxadiazole [25962-77-0]

2,6-Dimethylanilin (2,6-Xylidin) [87-62-7] (1993)

3,3´-Dimethylbenzidin (o-Tolidin) [119-93-7]

Dimethylformamid [68-12-2] (1989)

1,1-Dimethylhydrazin [57-14-7]

1,2-Dimethylhydrazin [540-73-8]

3,7-Dinitrofluoranthen [105735-71-5]

3,9-Dinitrofluoranthen [22506-53-2]

1,6-Dinitropyrene [42397-64-8] (1989)

1,8-Dinitropyrene [42397-65-9] (1989)

2,4-Dinitrotoluol [121-14-2]

2,6-Dinitrotoluol [606-20-2]

1,4-Dioxan [123-91-1]

Blau zerstreuen 1 [2475-45-8] (1990)

Ethylacrylat [140-88-5]

Ethylenthioharnstoff [96-45-7]

Ethylmethansulfonat [62-50-0]

2-(2-Formylhydrazino)-4-(5-nitro-2-furyl)thiazole [3570-75-0]

Glaswolle (1988)

Glu-P-1 (2-Amino-6-methyldipyrido[1,2-a:3´,2´-d]Imidazol)[67730-11-4]

Glu-P-2 (2-Aminodipyrido[1,2-a:3´,2´-d]Imidazol) [67730-10-3]

Glycidaldehyd [765-34-4]

Griseofulvin [126-07-8]

HC Blau Nr. 1 [2784-94-3] (1993)

Heptachlor [76-44-8] (1991)

Hexachlorbenzol [118-74-1]

Hexachlorcyclohexane

Hexamethylphosphoramid [680-31-9]

Humanes Immunschwächevirus Typ 2 (Infektion mit) (1996)

Humane Papillomaviren: einige andere Typen als 16, 18, 31 und 33 (1995)

Hydrazin [302-01-2]

Indeno[1,2,3-cd]pyren [193-39-5]

Eisen-Dextran-Komplex [9004-66-4]

Isopren [78-79-5] (1994)

Lasiocarpin [303-34-4]

Blei [7439-92-1] und Bleiverbindungen, anorganisch3

Magenta [632-99-5] (enthält CI Basic Red 9) (1993)

MeA-α-C (2-Amino-3-methyl-9H-pyrido[2,3-b]Indol)[68006-83-7]

Medroxyprogesteronacetat [71-58-9]

MeIQ (2-Amino-3,4-dimethylimidazo[4,5-f]Chinolin)[77094-11-2] (1993)

MeIQx (2-Amino-3,8-dimethylimidazo[4,5-f]quinoxaline) [77500-04-0] (1993)

Merphalan [531-76-0]

2-Methylaziridin (Propylenimin) [75-55-8]

Methylazoxymethanolacetat [592-62-1]

5-Methylchrysen [3697-24-3]

4,4´-Methylene bis(2-methylaniline) [838-88-0]

4,4´-Methylendianilin [101-77-9]

Methylquecksilberverbindungen (1993)3

Methylmethansulfonat [66-27-3]

2-Methyl-1-nitroanthrachinon [129-15-7] (unsichere Reinheit)

N-Methyl-N-nitrosourethan [615-53-2]

Methylthiouracil [56-04-2]

Metronidazol [443-48-1]

Mirex [2385-85-5]

Mitomycin C [50-07-7]

Monocrotalin [315-22-0]

5-(Morpholinomethyl)-3-[(5-nitrofurfurylidene)amino]-2-oxazolidinone [3795-88-8]

Nafenopin [3771-19-5]

Nickel, metallisch [7440-02-0] (1990)

Niridazol [61-57-4]

Nitrilotriessigsäure [139-13-9] und ihre Salze (1990)3

5-Nitroacenaphthen [602-87-9]

2-Nitroanisole [91-23-6] (1996)

Nitrobenzol [98-95-3] (1996)

6-Nitrochrysene [7496-02-8] (1989)

Nitrofen [1836-75-5], technische Qualität

2-Nitrofluorene [607-57-8] (1989)

1-[(5-Nitrofurfurylidene)amino]-2-imidazolidinone [555-84-0]

N-[4-(5-Nitro-2-furyl)-2-thiazolyl]acetamide [531-82-8]

Stickstofflost-N-oxid [126-85-2]

2-Nitropropan [79-46-9]

1-Nitropyrene [5522-43-0] (1989)

4-Nitropyrene [57835-92-4] (1989)

N-Nitrosodi-n-Butylamin [924-16-3]

N-Nitrosodiethanolamin [1116-54-7]

N-Nitrosodi-n-Propylamin [621-64-7]

3-(N-Nitrosomethylamino)propionitril [60153-49-3]

4-(N-Nitrosomethylamino)-1-(3-pyridyl)-1-butanone (NNK) [64091-91-4]

N-Nitrosomethylethylamin [10595-95-6]

N-Nitrosomethylvinylamin [4549-40-0]

N-Nitrosomorpholin [59-89-2]

N'-Nitrosonornicotin [16543-55-8]

N-Nitrosopiperidin [100-75-4]

N-Nitrosopyrrolidin [930-55-2]

N-Nitrososarcosin [13256-22-9]

Ochratoxin A [303-47-9] (1993)

Ölorange SS [2646-17-5]

Oxazepam [604-75-1] (1996)

Palygorskit (Attapulgit) [12174-11-7] (lange Fasern, >>5 Mikrometer) (1997)

Panfuran S (enthält Dihydroxymethylfuratrizin [794-93-4])

Pentachlorphenol [87-86-5] (1991)

Phenazopyridinhydrochlorid [136-40-3]

Phenobarbital [50-06-6]

Phenoxybenzaminhydrochlorid [63-92-3]

Phenylglycidylether [122-60-1] (1989)

Phenytoin [57-41-0]

PhIP (2-Amino-1-methyl-6-phenylimidazo[4,5-b]Pyridin) [105650-23-5] (1993)

Ponceau MX [3761-53-3]

Ponceau 3R [3564-09-8]

Kaliumbromat [7758-01-2]

Progestine

1,3-Propansulton [1120-71-4]

β-Propiolacton [57-57-8]

Propylenoxid [75-56-9] (1994)

Propylthiouracil [51-52-5]

Steinwolle (1988)

Saccharin [81-07-2]

Safrol [94-59-7]

Schistosoma japonicum (Infektion mit) (1994)

Schlackenwolle (1988)

Natrium o-Phenylphenat [132-27-4]

Sterigmatocystin [10048-13-2]

Streptozotocin [18883-66-4]

Styrol [100-42-5] (1994)

Sulfallat [95-06-7]

Tetranitromethan [509-14-8] (1996)

Thioacetamid [62-55-5]

4,4´-Thiodianilin [139-65-1]

Thioharnstoff [62-56-6]

Toluoldiisocyanate [26471-62-5]

o-Toluidin [95-53-4]

Trichlormethin (Trimustinhydrochlorid) [817-09-4] (1990)

Trp-P-1 (3-Amino-1,4-dimethyl-5H-pyrido [4,3-b]Indol) [62450-06-0]

Trp-P-2 (3-Amino-1-methyl-5H-pyrido[4,3-b]indole) [62450-07-1]

Trypanblau [72-57-1]

Uracil-Senf [66-75-1]

Urethan [51-79-6]

Vinylacetat [108-05-4] (1995)

4-Vinylcyclohexene [100-40-3] (1994)

4-Vinylcyclohexendiepoxid [107-87-6] (1994)

Mischungen

Bitumen [8052-42-4], Extrakte aus Dampf- und Luftraffination

Carrageenan [9000-07-1], abgebaut

Chlorierte Paraffine mit mittlerer Kohlenstoffkettenlänge C12 und mittlerem Chlorierungsgrad ca. 60 % (1990)

Kaffee (Harnblase)9 (1991)

Dieselkraftstoff, Marine (1989)

Motorabgase, Benzin (1989)

Heizöle, Rückstand (schwer) (1989)

Benzin (1989)

Eingelegtes Gemüse (traditionell in Asien) (1993)

Polybromierte Biphenyle [Firemaster BP-6, 59536-65-1]

Toxaphen (polychlorierte Camphene) [8001-35-2]

Toxine abgeleitet von Fusarium moniliforme (1993)

Schweißrauch (1990)

Expositionsumstände

Zimmerei und Tischlerei

Chemische Reinigung (berufliche Expositionen in) (1995)

Druckverfahren (berufliche Aufnahmen in) (1996)

Textilindustrie (Arbeit in) (1990)

Gruppe 3 – Nicht klassifizierbar hinsichtlich Karzinogenität für den Menschen (480)

Agenten und Gruppen von Agenten

Acridinorange [494-38-2]

Acriflaviniumchlorid [8018-07-3]

Acrolein [107-02-8]

Acrylsäure [79-10-7]

Acrylfasern

Acrylnitril-Butadien-Styrol-Copolymere

Actinomycin D [50-76-0]

Aldicarb [116-06-3] (1991)

Aldrin [309-00-2]

Allylchlorid [107-05-1]

Allylisothiocyanat [57-06-7]

Allylisovalerat [2835-39-4]

Amaranth [915-67-3]

5-Aminoacenaphthen [4657-93-6]

2-Aminoanthrachinon [117-79-3]

p-Aminobenzoesäure [150-13-0]

1-Amino-2-methylanthraquinone [82-28-0]

2-Amino-4-nitrophenol [99-57-0] (1993)

2-Amino-5-nitrophenol [121-88-0] (1993)

4-Amino-2-nitrophenol [119-34-6]

2-Amino-5-nitrothiazole [121-66-4]

11-Aminoundecansäure [2432-99-7]

Ampicillin [69-53-4] (1990)

Anästhetika, flüchtig

Angelicin [523-50-2] plus ultraviolette A-Strahlung

Anilin [62-53-3]

p-Anisidin [104-94-9]

Anthanthren [191-26-4]

Anthracen [120-12-7]

Anthranilsäure [118-92-3]

Antimontrisulfid [1345-04-6] (1989)

Apholat [52-46-0]

p-Aramidfibrillen [24938-64-5] (1997)

Aurothioglucose [12192-57-3]

Aziridin [151-56-4]